Dreamactor M1

紹介 :

DreamActor-M1は、拡散トランスフォーマー(DiT)に基づいたヒューマンアニメーションフレームワークであり、きめ細やかな全体制御性、マルチスケール適応性、長期的な時間的一貫性を達成することを目指しています。本モデルは混合誘導によって、肖像画から全身アニメーションまで、様々なシーンに適用可能な、高表現力かつリアルなヒューマンビデオを生成できます。主な利点は高忠実度とアイデンティティ保持であり、ヒューマンビヘイビアアニメーションに新たな可能性をもたらします。

ターゲットユーザー :

「本製品は、アニメーション制作従事者、ゲーム開発者、高品質なヒューマンアニメーションを必要とするクリエイター向けです。強力な制御機能と多様な適用シーンにより、プロフェッショナルの高いアニメーション表現力と一貫性への要求を満たすことができます。」

使用シナリオ

アニメ映画制作において、DreamActor-M1を利用して高品質なヒューマンキャラクターアニメーションを生成します。

ゲーム開発において、このモデルを使用してゲームキャラクターに滑らかな動作表現を作成します。

ソーシャルメディアコンテンツ制作において、DreamActor-M1を使用して目を引く短編ビデオを生成します。

製品特徴

精細な制御:暗黙的な顔の表現、3Dヘッドボール、3Dボディスケルトンを組み合わせることで、顔の表情と体の動きを堅牢に制御します。

マルチスケール適応:段階的なトレーニング戦略を採用し、様々な体の姿勢と異なる解像度の画像を処理し、肖像画と全身ビューの変換をサポートします。

長期的な時間的一貫性:連続フレームの動きパターンと視覚的な参照を統合することで、複雑な動きにおける未観測領域の時間的一貫性を確保します。

顔アニメーションのサポート:音声駆動の顔アニメーションに拡張でき、多言語の口パク同期を実現します。

形状認識アニメーション:骨格の長さ調整技術により、形状に適応したアニメーション生成を実現します。

柔軟なモーション転送:顔の表情や頭の動きなど、一部の動きのみを転送できます。

多様なスタイルのサポート:様々なキャラクターや動きスタイルに堅牢です。

多様な視点のサポート:異なる頭の姿勢でアニメーション結果を生成できます。

使用チュートリアル

参照画像と駆動ビデオフレームを用意します。

参照画像とビデオフレームをモデルに入力してトレーニングします。

混合誘導パラメータを設定して、顔と体の動きを調整します。

モデルを実行して、目標アニメーションビデオを生成します。

必要に応じて、生成されたビデオを後処理および調整します。

おすすめAI製品

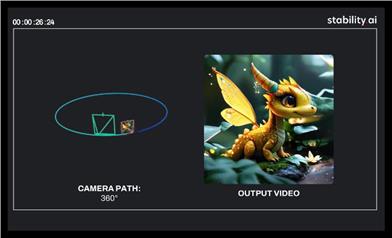

Stable Virtual Camera

Stable Virtual Cameraは、Stability AIが開発した13億パラメーターの汎用拡散モデルであり、Transformer画像からビデオへの変換モデルです。その重要性は、新しいビュー合成(NVS)に技術的なサポートを提供することであり、入力ビューとターゲットカメラに基づいて、3D整合性のある新しいシーンビューを生成できます。主な利点としては、ターゲットカメラの軌跡を自由に指定でき、大きな視点の変化と時間的に滑らかなサンプルを生成でき、追加のニューラル放射場(NeRF)蒸留なしで高い整合性を維持でき、さらに最長30秒の高品質でシームレスなループビデオを生成できることが挙げられます。このモデルは、研究および非商業目的でのみ無料で使用でき、研究者や非商業クリエイターに革新的な画像からビデオへの変換ソリューションを提供することを目的としています。

ビデオ アップデート

51.6K

ロングコンテキスト最適化(LCT)

ロングコンテキスト最適化(LCT)は、現在の単一生成能力と現実のナラティブビデオ制作とのギャップを解消することを目的としています。この技術は、データ駆動型のアプローチを使用してシーンレベルの一貫性を直接学習し、インタラクティブなマルチカメラ開発と合成生成をサポートしており、ビデオ制作のあらゆる側面に適用できます。

ビデオ アップデート

46.6K