Skyreels A2

紹介 :

SkyReels-A2は、動画拡散トランスフォーマーに基づくフレームワークであり、ユーザーは動画コンテンツの合成と生成を行うことができます。このモデルは深層学習技術を活用することで、柔軟な創作能力を提供し、アニメーションや特殊効果制作など、様々な動画生成アプリケーションに適しています。本製品の利点は、オープンソースであることと、効率的なモデル性能であり、研究者や開発者による使用に適しており、現在無料で提供されています。

ターゲットユーザー :

「本製品は、強力なツールを用いて動画コンテンツの生成と合成を行う必要がある研究者、開発者、クリエイターに適しています。ユーザーは、動画生成技術の可能性を自由に探求できるオープンな環境を提供します。」

使用シナリオ

研究者はSkyReels-A2を使用して動画合成実験を行い、新しい動画生成アルゴリズムを探求しています。

アニメーターは、このモデルを使用してアニメーション短編を生成し、作業効率を向上させています。

開発者はこれをアプリケーションに統合し、最終ユーザーに動画生成サービスを提供しています。

製品特徴

動画合成機能を提供し、ユーザーは入力画像または動画に基づいて新しい動画を生成できます。

マルチGPU推論をサポートし、推論速度を大幅に向上させます。

Gradioインターフェースを提供し、ユーザーインタラクション体験を向上させます。

A2-Bench評価とランキングをサポートし、性能比較を容易にします。

事前学習済みウェイトをダウンロードでき、簡単に使用を開始できます。

使用チュートリアル

1. コードリポジトリのクローン作成:コマンド`git clone https://github.com/SkyworkAI/SkyReels-A2.git`を使用します。

2. 環境の作成とアクティブ化:コマンド`conda create -n skyreels-a2 python=3.10`と`conda activate skyreels-a2`を使用します。

3. 依存関係のインストール:コマンド`pip install -r requirements.txt`を実行します。

4. 事前学習済みウェイトのダウンロード:HuggingFaceからダウンロードするか、手動で事前学習済みウェイトをダウンロードします。

5. モデルパスと参照画像パスを設定し、推論スクリプトを実行して動画を生成します。

おすすめAI製品

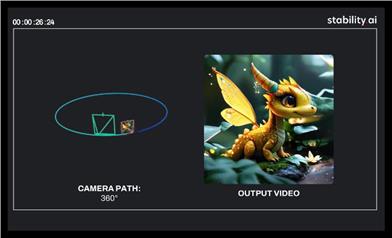

Stable Virtual Camera

Stable Virtual Cameraは、Stability AIが開発した13億パラメーターの汎用拡散モデルであり、Transformer画像からビデオへの変換モデルです。その重要性は、新しいビュー合成(NVS)に技術的なサポートを提供することであり、入力ビューとターゲットカメラに基づいて、3D整合性のある新しいシーンビューを生成できます。主な利点としては、ターゲットカメラの軌跡を自由に指定でき、大きな視点の変化と時間的に滑らかなサンプルを生成でき、追加のニューラル放射場(NeRF)蒸留なしで高い整合性を維持でき、さらに最長30秒の高品質でシームレスなループビデオを生成できることが挙げられます。このモデルは、研究および非商業目的でのみ無料で使用でき、研究者や非商業クリエイターに革新的な画像からビデオへの変換ソリューションを提供することを目的としています。

ビデオ アップデート

52.4K

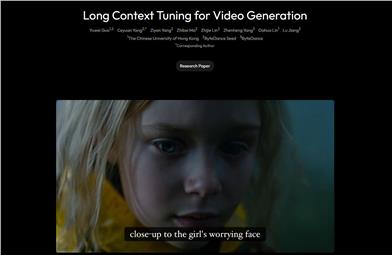

ロングコンテキスト最適化(LCT)

ロングコンテキスト最適化(LCT)は、現在の単一生成能力と現実のナラティブビデオ制作とのギャップを解消することを目的としています。この技術は、データ駆動型のアプローチを使用してシーンレベルの一貫性を直接学習し、インタラクティブなマルチカメラ開発と合成生成をサポートしており、ビデオ制作のあらゆる側面に適用できます。

ビデオ アップデート

48.0K