Meilleurmodèleia

MeilleurModèleIA は、最適な AI モデルを選んで自動的にユーザーに提供するツールです。ユーザーには複雑なモデルの詳細が意識されることなく、100以上の選択肢の中から適切なモデルが瞬時に決定されます。その主な利点は、 inteligentなモジュールルーティング、高度なパフォーマンス、専門知識が必要ないこと、そして簡単かつ迅速な使用法です。

AI モデル

37.5K

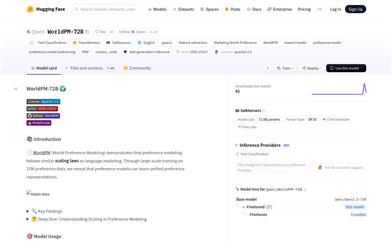

Worldpm 72B

WorldPM-72B は、大規模な学習によって得られた統合嗜好モデリングモデルであり、優れた汎用性と高い表現能力を持っています。このモデルは 1500 万件以上の嗜好データに基づいており、客観的な知識に関する嗜好認識において大きな可能性を示しています。より質の高いテキストコンテンツの生成に使用でき、特に執筆分野において重要な応用価値を持っています。

自然言語処理

37.3K

AI音楽ジェネレーター

AIラップジェネレーターは、テキストを音楽ラップに変換するツールであり、AI技術を利用しています。独特なラップ作品を迅速に生成することが可能です。その主な利点には、迅速な作成、クリエイティブブロックを克服し、無料で音楽を提供することなどが含まれます。

音楽生成

37.8K

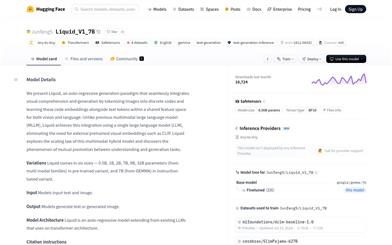

Liquid

Liquidは、画像を離散コードに分解し、テキストトークンと特徴空間を共有することで、視覚理解とテキスト生成のシームレスな統合を促進する自己回帰生成モデルです。このモデルの主な利点は、外部で事前にトレーニングされた視覚埋め込みを必要とせず、リソースへの依存を削減し、スケール則を通じて理解と生成タスク間の相互促進効果を発見したことです。

衣服

37.5K

中国語精選

GLM 4 32B

GLM-4-32Bは、様々な自然言語処理タスクに対応することを目的とした高性能な生成言語モデルです。深層学習技術を用いて訓練されており、首尾一貫したテキストの生成や複雑な質問への回答が可能です。本モデルは、学術研究、商業用途、開発者に適しており、価格も手頃で、的確な位置付けをしており、自然言語処理分野をリードする製品です。

AIモデル

38.4K

Dream 7B

Dream 7Bは、香港大学NLPグループとファーウェイ?ノアの方舟研究所が共同で発表した最新の拡散型大規模言語モデルです。テキスト生成分野において優れた性能を示しており、特に複雑な推論、長期計画、文脈の一貫性などに優れています。本モデルは高度なトレーニング方法を採用しており、強力な計画能力と柔軟な推論能力を備え、様々なAIアプリケーションにより強力なサポートを提供します。

AIモデル

38.4K

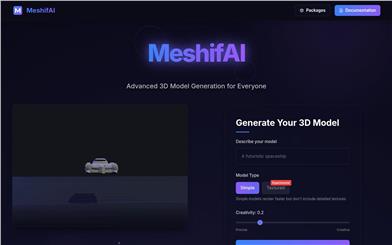

Meshifai

MeshifAIは、開発者がアプリケーション、ゲーム、ウェブサイトに高品質の3D生成機能を迅速に統合できるように設計された、高度なテキストから3Dモデルへの生成プラットフォームです。強力なAI技術により、ユーザーは説明を入力するだけでリアルな3Dモデルを生成でき、3Dデザインのプロセスを大幅に簡素化します。このプラットフォームは使いやすく、あらゆる開発ニーズに対応できます。

3Dモデリング

39.5K

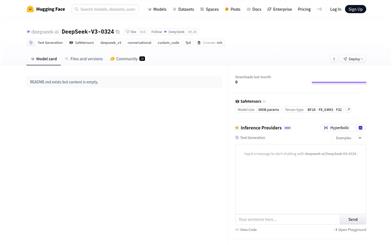

Deepseek V3 0324

DeepSeek-V3-0324は、685億パラメーターを持つ高度なテキスト生成モデルです。BF16とF32テンソルタイプを採用し、効率的な推論とテキスト生成をサポートします。このモデルの主な利点は、その強力な生成能力とオープンソースの特性であり、様々な自然言語処理タスクに広く適用できます。このモデルは、開発者と研究者に強力なツールを提供し、テキスト生成分野でのブレークスルーを支援することを目的としています。

AIモデル

49.4K

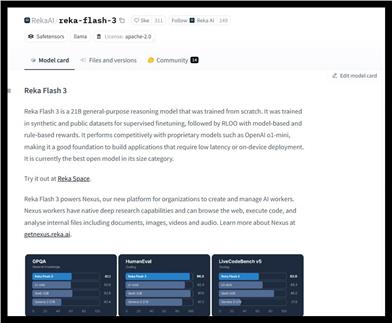

Reka Flash 3

Reka Flash 3は、ゼロからトレーニングされた21億パラメーターの汎用推論モデルです。合成データセットと公開データセットを使用して教師ありファインチューニングを行い、モデルベースとルールベースの報酬を組み合わせて強化学習を行います。このモデルは、低遅延とデバイスエンドの展開アプリケーションにおいて優れたパフォーマンスを発揮し、強力な研究能力を備えています。現在、同種のオープンソースモデルの中で最良の選択肢であり、様々な自然言語処理タスクやアプリケーションシナリオに適しています。

AIモデル

43.9K

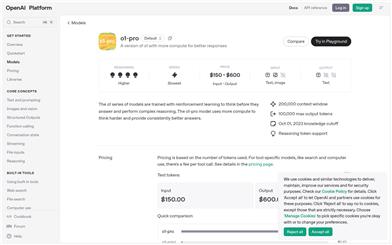

O1 Pro

o1-proモデルは、高品質なテキスト生成と複雑な推論を提供するために設計された、高度な人工知能言語モデルです。推論と応答の正確性に優れており、高精度なテキスト処理が必要なアプリケーションシーンに適しています。本モデルの価格は使用トークン数に基づいており、入力100万トークンあたり150米ドル、出力100万トークンあたり600米ドルです。企業や開発者は、本モデルをアプリケーションに統合することで、効率的なテキスト生成能力を活用できます。

レクチャー資料

45.8K

ヴェネツィア

ヴェネツィアは、プライバシー保護を重視したAIプラットフォームで、テキスト生成、画像生成、コード生成など、さまざまな機能を提供します。ユーザーデータのプライバシーを重視しており、すべてのデータはユーザーのデバイスのみに保存され、サーバーにアップロードされることはありません。このプラットフォームは、最先端のオープンソースAI技術を活用し、検閲やバイアスのないインテリジェントなサービスを提供することで、ユーザーが自由に創造性と知識を探求できる環境を目指しています。ヴェネツィアは、無料と有料の2種類のアカウントオプションを提供しており、有料ユーザーは、より高解像度の画像、透かしなし、プロンプト回数無制限などの高度な機能を利用できます。

AIモデル

53.3K

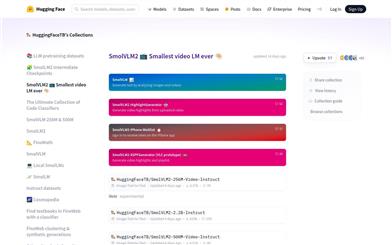

Smolvlm2

SmolVLM2は、動画コンテンツを分析して関連するテキスト説明や動画ハイライトを生成することを目的とした軽量の動画言語モデルです。このモデルは、効率性と低リソース消費を特徴とし、モバイルデバイスやデスクトップクライアントなど、さまざまなデバイスで動作します。主な利点は、動画データを迅速に処理し、高品質のテキスト出力を生成できることで、動画コンテンツ制作、動画分析、教育などの分野に強力な技術サポートを提供します。このモデルはHugging Faceチームによって開発され、効率的で軽量な動画処理ツールとして位置付けられており、現在実験段階です。ユーザーは無料で試用できます。

ビデオ編集

44.4K

Firecrawl LLMs.txt ジェネレーター

LLMs.txtジェネレーターは、Firecrawlが提供するオンラインツールで、ユーザーがウェブサイトからLLMのトレーニングと推論に使用する統合テキストファイルを生成することを目的としています。ウェブコンテンツを統合することで、大規模言語モデルのトレーニングに高品質のテキストデータを提供し、モデルのパフォーマンスと精度を向上させます。このツールの主な利点は、操作が簡単で効率的であり、必要なテキストファイルを迅速に生成できることです。主に大量のテキストデータを用いたモデルトレーニングを行う開発者や研究者を対象としており、便利なソリューションを提供します。

モデルプレスと類似のサイト

48.6K

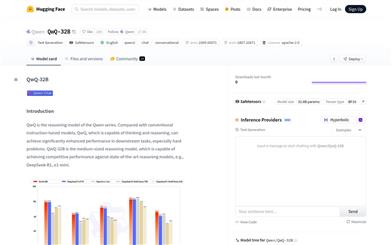

Qwq 32B

QwQ-32BはQwenシリーズの推論モデルであり、複雑な問題の思考と推論能力に特化しています。下流タスクにおいて優れたパフォーマンスを発揮し、特に難問解決においてその力を発揮します。このモデルはQwen2.5アーキテクチャをベースに、事前学習と強化学習による最適化が行われており、325億のパラメーターを持ち、最大131072トークンの完全なコンテキスト長を処理できます。主な利点としては、強力な推論能力、効率的な長文処理能力、柔軟な展開オプションなどが挙げられます。このモデルは、学術研究、プログラミング支援、創作執筆など、深い思考と複雑な推論を必要とする場面に適しています。

AIモデル

48.6K

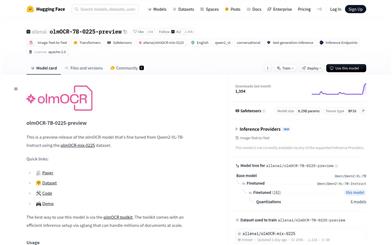

Olmocr 7B 0225 Preview

olmOCR-7B-0225-previewは、Allen Institute for AIが開発した高度なドキュメント認識モデルです。効率的な画像処理とテキスト生成技術により、ドキュメント画像を編集可能なプレーンテキストに迅速に変換することを目指しています。このモデルはQwen2-VL-7B-Instructをファインチューニングしたもので、強力な視覚処理と自然言語処理能力を兼ね備えており、大規模なドキュメント処理タスクに適しています。主な利点としては、効率的な処理能力、高精度なテキスト認識、柔軟なプロンプト生成方法などが挙げられます。このモデルは研究および教育目的で使用でき、Apache 2.0ライセンスに従い、責任ある使用を重視しています。

OCR

44.7K

Magma 8B

Magma-8Bは、マイクロソフトが開発したマルチモーダルAI基盤モデルであり、マルチモーダルAIエージェントの研究のために設計されています。テキストと画像の入力を組み合わせ、テキスト出力を生成し、ビジュアルプランニングとエージェント機能を備えています。このモデルは、言語モデルのバックボーンとしてMeta LLaMA-3を使用し、CLIP-ConvNeXt-XXLargeビジョンエンコーダーと組み合わせることで、ラベルなしビデオデータからの時空間関係の学習を可能にし、強力な汎化能力とマルチタスク適応性を備えています。Magma-8Bはマルチモーダルタスク、特に空間理解と推論において優れた性能を発揮します。これはマルチモーダルAI研究に強力なツールを提供し、仮想環境と現実環境における複雑なインタラクションの研究を推進します。

AIモデル

46.1K

S1 32B

s1は、少量のサンプルで効率的なテキスト生成能力を実現することに重点を置いた推論モデルです。予算強制技術を用いてテスト時に拡張することで、o1-previewと同等の性能を達成します。このモデルはNiklas Muennighoff氏らによって開発され、関連研究はarXivに掲載されています。Safetensors技術を採用しており、328億パラメータを備え、テキスト生成タスクに対応します。主な利点は、少量のサンプルで高品質な推論を実現できることであり、効率的なテキスト生成が必要なシナリオに適しています。

ライティングアシスタント

61.5K

Xwen Chat

Xwen-teamが開発したXwen-Chatは、高品質な日本語対話モデルのニーズに応えるために誕生し、市場の空白を埋めています。複数のバージョンがあり、強力な言語理解と生成能力を備え、複雑な言語タスクを処理し、自然な対話内容を生成できます。スマートカスタマーサービスなどのシナリオに適しており、Hugging Faceプラットフォームで無料で提供されています。

チャットボット

56.3K

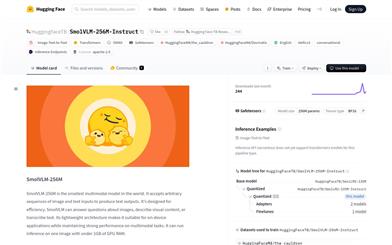

Smolvlm 256M Instruct

SmolVLM-256Mは、Hugging Faceが開発したIdefics3アーキテクチャに基づくマルチモーダルモデルで、画像とテキストの入力を効率的に処理するために設計されています。画像に関する質問への回答、視覚コンテンツの説明、テキストの転写が可能で、推論には1GB未満のGPUメモリしか必要ありません。このモデルは、軽量なアーキテクチャを維持しながら、マルチモーダルタスクで優れた性能を発揮し、デバイス上でのアプリケーションに適しています。The CauldronとDocmatixのデータセットからトレーニングされており、ドキュメント理解や画像記述など、幅広い分野のコンテンツが含まれているため、広範な応用可能性を備えています。現在、Hugging Faceプラットフォームで無料で提供されており、開発者や研究者に強力なマルチモーダル処理能力を提供することを目的としています。

AIモデル

51.3K

Deepseek R1 Distill Qwen 14B

DeepSeek-R1-Distill-Qwen-14Bは、DeepSeekチームがQwen-14Bを基に開発した蒸留モデルであり、推論とテキスト生成タスクに特化しています。大規模な強化学習とデータ蒸留技術により、推論能力と生成品質を大幅に向上させながら、計算資源の消費を削減しています。主な利点として、高性能、低リソース消費、幅広い適用性があり、効率的な推論とテキスト生成を必要とする場面に適しています。

AIモデル

261.6K

Deepseek R1 Distill Qwen 32B

DeepSeek-R1-Distill-Qwen-32Bは、DeepSeekチームが開発した高性能言語モデルであり、Qwen-2.5シリーズを基に蒸留最適化されています。このモデルは複数のベンチマークテストで優れた性能を示しており、特に数学、コード、推論タスクにおいて顕著です。主な利点として、効率的な推論能力、強力な多言語サポート、そしてオープンソースである点が挙げられ、研究者や開発者による二次開発や応用が容易です。このモデルは、スマートカスタマーサービス、コンテンツ作成、コードアシストなど、高性能なテキスト生成が必要な場面に適しており、幅広い応用が期待できます。

モデルトレーニングとデプロイ

112.1K

AI ContentCraft

AI ContentCraftは、クリエイターがストーリー、ポッドキャスト脚本、マルチメディアコンテンツを迅速に生成できるよう設計された強力なコンテンツ作成プラットフォームです。テキスト生成、音声合成、画像生成技術を統合することで、クリエイターにワンストップソリューションを提供します。日本語と英語のコンテンツ変換に対応しており、効率的なコンテンツ制作が必要なユーザーに最適です。DeepSeek AI、Kokoro TTS、Replicate APIなどの技術スタックを採用し、高品質なコンテンツ生成を確保しています。現在、オープンソースで無料で提供されており、個人およびチームでの使用に適しています。

ライティングアシスタント

66.8K

Textoon

Textoonは、アリババグループ通義実験室によって開発された革新的な手法で、テキストの説明に基づいて多様な2D漫画風キャラクターを迅速に生成します。この技術は、高度な言語モデルとビジョンモデルを活用し、テキストの意図を2Dキャラクターの外見に変換します。生成されるLive2Dモデルは、高効率性と互換性を備えています。2D漫画スタイルのデジタルキャラクター制作のニーズを満たすだけでなく、現在の3Dキャラクター研究における2Dインタラクティブキャラクターへの関心の不足を補っています。主な利点としては、高効率なレンダリング性能、柔軟なテキスト解析能力、編集可能性があり、高品質な2D漫画風キャラクターを迅速に生成するのに適しています。

AI顔色生成

53.3K

Internlm3

InternLM3は、InternLMチームが開発した、高性能な言語モデルのシリーズで、テキスト生成タスクに特化しています。様々な量子化技術によって最適化されており、異なるハードウェア環境下でも高効率に動作し、優れた生成品質を維持します。主なメリットとしては、効率的な推論性能、多様な適用シーン、そして様々なテキスト生成タスクへの最適化サポートが挙げられます。InternLM3は、高品質なテキスト生成を必要とする開発者や研究者にとって最適であり、自然言語処理分野における迅速なアプリケーション開発を支援します。

AIモデル

45.5K

Minimax Text 01

MiniMax-Text-01は、MiniMaxAIが開発した大規模言語モデルで、総パラメータ数は4,560億です。各トークンは459億のパラメータを活性化します。本モデルは、閃光型アテンション、Softmaxアテンション、MoE(Mixture of Experts)技術を組み合わせたハイブリッドアーキテクチャを採用しています。LASP+(Linear Attention Sequence Parallelism Plus)、可変長環状アテンション、ETP(Expert Tensor Parallelism)などの高度な並列化戦略と計算?通信オーバーラップ手法により、トレーニング時のコンテキスト長を100万トークンに拡張し、推論時には最大400万トークンのコンテキストを処理できます。複数の学術ベンチマークテストにおいて、MiniMax-Text-01は最先端モデルと同等の性能を示しています。

AIモデル

48.6K

Dria Agent A 7B

Dria-Agent-a-7Bは、Qwen2.5-Coderシリーズを基に訓練された、エージェントアプリケーションに特化した大規模言語モデルです。Pythonic関数呼び出し方式を採用しており、従来のJSON関数呼び出し方法と比較して、単一呼び出しでの複数関数並列処理、自由形式の推論とアクション、複雑なソリューションの即時生成などの利点があります。Berkeley Function Calling Leaderboard (BFCL)、MMLU-Pro、Dria-Pythonic-Agent-Benchmark (DPAB)など、複数のベンチマークテストで優れた性能を発揮しています。モデルサイズは76.2億パラメーター、BF16テンソル型を使用し、テキスト生成タスクに対応しています。主な利点としては、強力なプログラミング支援能力、効率的な関数呼び出し方式、特定分野における高い精度が挙げられます。自動プログラミングやインテリジェントエージェントなど、複雑な論理処理と複数ステップのタスク実行が必要なアプリケーションシナリオに適しています。現在、Hugging Faceプラットフォームで無料で利用可能です。

コードアシスタント

45.8K

Llama 3 Patronus Lynx 8B Instruct Q4 K M GGUF

4ビット量子化技術を採用した量子化済み大規模言語モデルです。ストレージと計算の必要性を削減し、自然言語処理に適しています。パラメータ数は8.03Bで、非商業利用目的であれば無料で使用でき、リソースが限られた環境での高性能言語アプリケーションのニーズに最適です。

AIモデル

55.2K

Internvl2.5 38B MPO

InternVL2.5-MPOは、InternVL2.5と混合嗜好最適化(MPO)に基づいて構築された、高度なマルチモーダル大規模言語モデルシリーズです。このシリーズモデルは、マルチモーダルタスクにおいて優れた性能を示し、画像、テキスト、ビデオデータの処理と高品質なテキスト応答の生成が可能です。'ViT-MLP-LLM'パラダイムを採用し、ピクセルアンシャッフル操作と動的解像度戦略によって、視覚処理能力を最適化しています。さらに、複数画像とビデオデータのサポートも導入されており、適用範囲がさらに広がっています。InternVL2.5-MPOは、マルチモーダル能力評価において複数のベンチマークモデルを上回り、マルチモーダル分野におけるリーダーシップを証明しています。

AIモデル

53.3K

Llama 3 Patronus Lynx 70B Instruct

PatronusAI/Llama-3-Patronus-Lynx-70B-Instructは、Llama-3アーキテクチャに基づく大規模言語モデルであり、RAG設定における幻覚問題の検出を目的としています。このモデルは、与えられた文書、質問、回答を分析することで、回答が文書の内容に忠実であるかどうかを評価します。主な利点としては、高精度の幻覚検出能力と強力な言語理解能力が挙げられます。Patronus AIによって開発され、金融分析や医学研究など、高精度な情報検証が必要な場面に適しています。現在無料で利用できますが、具体的な商用利用については開発者にお問い合わせください。

研究機器

45.5K

CAG

CAG(Cache-Augmented Generation)は、従来のRAG(Retrieval-Augmented Generation)方式における検索遅延、検索エラー、システムの複雑さといった問題を解決することを目的とした、革新的な言語モデル拡張技術です。関連する全ての資源をモデルコンテキストに事前にロードし、その実行時パラメータをキャッシュすることにより、CAGは推論プロセスにおいてリアルタイム検索を行うことなく直接応答を生成できます。この手法は、遅延の顕著な低減、信頼性の向上に加え、システム設計の簡素化を実現し、実用的で拡張性の高い代替手段となります。大規模言語モデル(LLMs)のコンテキストウィンドウが拡大し続けるにつれて、CAGはより複雑なアプリケーションシナリオで役割を果たすことが期待されます。

AIモデル

49.4K

- 1

- 2

- 3

- 4

- 5

- 6

- 10

おすすめAI製品

海外精選

Jules AI

Jules は、自動で煩雑なコーディングタスクを処理し、あなたに核心的なコーディングに時間をかけることを可能にする異步コーディングエージェントです。その主な強みは GitHub との統合で、Pull Request(PR) を自動化し、テストを実行し、クラウド仮想マシン上でコードを検証することで、開発効率を大幅に向上させています。Jules はさまざまな開発者に適しており、特に忙しいチームには効果的にプロジェクトとコードの品質を管理する支援を行います。

開発プログラミング

39.2K

Nocode

NoCode はプログラミング経験を必要としないプラットフォームで、ユーザーが自然言語でアイデアを表現し、迅速にアプリケーションを生成することが可能です。これにより、開発の障壁を下げ、より多くの人が自身のアイデアを実現できるようになります。このプラットフォームはリアルタイムプレビュー機能とワンクリックデプロイ機能を提供しており、技術的な知識がないユーザーにも非常に使いやすい設計となっています。

開発プラットフォーム

38.9K

Listenhub

ListenHub は軽量級の AI ポッドキャストジェネレーターであり、中国語と英語に対応しています。最先端の AI 技術を使用し、ユーザーが興味を持つポッドキャストコンテンツを迅速に生成できます。その主な利点には、自然な会話と超高品質な音声効果が含まれており、いつでもどこでも高品質な聴覚体験を楽しむことができます。ListenHub はコンテンツ生成速度を改善するだけでなく、モバイルデバイスにも対応しており、さまざまな場面で使いやすいです。情報取得の高効率なツールとして位置づけられており、幅広いリスナーのニーズに応えています。

AI

38.1K

中国語精選

腾讯混元画像 2.0

腾讯混元画像 2.0 は腾讯が最新に発表したAI画像生成モデルで、生成スピードと画質が大幅に向上しました。超高圧縮倍率のエンコード?デコーダーと新しい拡散アーキテクチャを採用しており、画像生成速度はミリ秒級まで到達し、従来の時間のかかる生成を回避することが可能です。また、強化学習アルゴリズムと人間の美的知識の統合により、画像のリアリズムと詳細表現力を向上させ、デザイナー、クリエーターなどの専門ユーザーに適しています。

画像生成

38.1K

Openmemory MCP

OpenMemoryはオープンソースの個人向けメモリレイヤーで、大規模言語モデル(LLM)に私密でポータブルなメモリ管理を提供します。ユーザーはデータに対する完全な制御権を持ち、AIアプリケーションを作成する際も安全性を保つことができます。このプロジェクトはDocker、Python、Node.jsをサポートしており、開発者が個別化されたAI体験を行うのに適しています。また、個人情報を漏らすことなくAIを利用したいユーザーにお勧めします。

オープンソース

38.9K

Fastvlm

FastVLM は、視覚言語モデル向けに設計された効果的な視覚符号化モデルです。イノベーティブな FastViTHD ミックスドビジュアル符号化エンジンを使用することで、高解像度画像の符号化時間と出力されるトークンの数を削減し、モデルのスループットと精度を向上させました。FastVLM の主な位置付けは、開発者が強力な視覚言語処理機能を得られるように支援し、特に迅速なレスポンスが必要なモバイルデバイス上で優れたパフォーマンスを発揮します。

画像処理

38.1K

海外精選

ピカ

ピカは、ユーザーが自身の創造的なアイデアをアップロードすると、AIがそれに基づいた動画を自動生成する動画制作プラットフォームです。主な機能は、多様なアイデアからの動画生成、プロフェッショナルな動画効果、シンプルで使いやすい操作性です。無料トライアル方式を採用しており、クリエイターや動画愛好家をターゲットとしています。

映像制作

17.6M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M