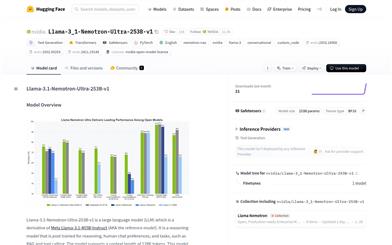

S1 32B

紹介 :

s1は、少量のサンプルで効率的なテキスト生成能力を実現することに重点を置いた推論モデルです。予算強制技術を用いてテスト時に拡張することで、o1-previewと同等の性能を達成します。このモデルはNiklas Muennighoff氏らによって開発され、関連研究はarXivに掲載されています。Safetensors技術を採用しており、328億パラメータを備え、テキスト生成タスクに対応します。主な利点は、少量のサンプルで高品質な推論を実現できることであり、効率的なテキスト生成が必要なシナリオに適しています。

ターゲットユーザー :

ターゲットユーザーは、自然言語処理分野の研究者と開発者です。このモデルは、効率的なテキスト生成と推論が必要なアプリケーションシナリオ(スマートカスタマーサービス、自動ライティングツール、チャットボットなど)に適しています。オープンソースであることと、少量のサンプルでトレーニングできることから、研究開発の理想的な選択肢となります。

使用シナリオ

スマートカスタマーサービスシステム:s1モデルを用いて自然言語による応答を生成し、顧客サービスの質を向上させます。

自動ライティングツール:モデルを用いて記事や物語などのテキストコンテンツを生成し、創作効率を向上させます。

チャットボット:チャットボットに自然言語の理解と生成能力を提供し、インタラクション体験を強化します。

製品特徴

Qwen2.5-32B-Instructを微調整し、推論タスクに特化

わずか1000サンプルでのトレーニングで効率的な学習を実現

テスト時の拡張に対応し、予算強制技術により性能向上

Safetensors技術に対応し、モデルの安全性と安定性を確保

テキスト生成タスク(自然言語処理や対話システムなど)に対応

オープンソースモデルであり、コミュニティでの議論やバージョン管理に対応

詳細な使用方法ドキュメントとコード例を提供し、開発者の迅速な導入を支援

使用チュートリアル

1. Hugging Faceのモデルページにアクセスし、s1-32Bモデルファイルをダウンロードします。

2. Safetensorsやtransformersなど、必要な依存ライブラリをインストールします。

3. モデルを読み込み、推論を実行します。少量のサンプルを用いた微調整(オプション)を行います。

4. 必要に応じてモデルを呼び出してテキストを生成し、予算強制技術を用いて出力を最適化します。

5. スマートカスタマーサービスやライティングツールなどのアプリケーションにモデルを統合します。

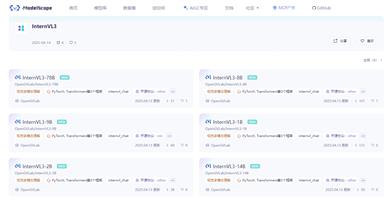

おすすめAI製品

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

AIモデル

11.4M

中国語精選

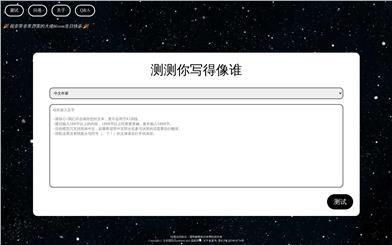

あなたの文章は誰に似ている?

「あなたの文章は誰に似ている? 」testurtext.siteは、テキストを分析して様々な作家の文体を識別するオンラインツールです。高度なアルゴリズムと人工知能技術を活用し、ユーザーは自身の文章の書き方を理解し、著名な作家のスタイルと比較することができます。この文体テストツールは、娯楽性だけでなく、文章作成愛好家にとってインスピレーションと学習の機会を提供します。

ライティングアシスタント

9.3M