Minference 1.0

简介 :

MInference 1.0 是一种稀疏计算方法,旨在加速长序列处理的预填充阶段。它通过识别长上下文注意力矩阵中的三种独特模式,实现了对长上下文大型语言模型(LLMs)的动态稀疏注意力方法,加速了1M token提示的预填充阶段,同时保持了LLMs的能力,尤其是检索能力。

需求人群 :

MInference 1.0 适用于需要处理大量数据和长上下文信息的研究人员和开发者,特别是在自然语言处理和机器学习领域。它通过优化计算资源的使用,使得大型语言模型能够更快地处理和生成文本,适合于需要高效文本生成和检索能力的应用场景。

使用场景

在问答(QA)任务中,MInference 1.0 能够快速检索并生成准确的答案。

在编程任务中,MInference 1.0 可以辅助开发者快速编写和理解代码。

在多跳问答(multi-hop QA)任务中,MInference 1.0 能够处理复杂的上下文信息,提供连贯的答案。

产品特色

动态稀疏注意力方法,加速长上下文LLMs的预填充阶段,提升处理速度高达10倍。

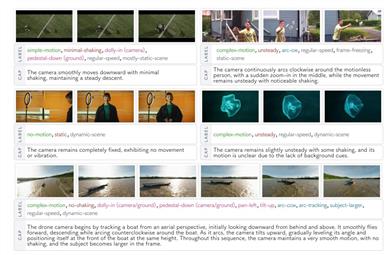

将动态稀疏注意力分为三种模式:A-shape、Vertical-Slash和Block-Sparse,并设计了Kernel-Aware Sparse Pattern Search算法来寻找最优的头模式。

引入在线近似方法和优化的GPU内核,以最小的开销加速LLM推理。

提出最佳推理代码库,实现在单个A100上使用LLaMA风格模型进行1M token预填充推理。

在多个基准测试中评估MInference,包括InfiniteBench、RULER、PG-19和Needle in a Haystack,以评估LLMs的实际上下文处理能力。

通过微基准测试展示了所提出的三种注意力模式的性能,以及FlashAttention的对比。

在不同模型和方法上测试了MInference,包括在Needle in a Haystack任务中对不同上下文窗口和提示中关键信息位置的性能评估。

使用教程

步骤一:访问MInference 1.0的在线演示或下载代码。

步骤二:根据文档说明,配置所需的环境和依赖。

步骤三:加载你的长上下文数据或模型。

步骤四:使用MInference 1.0的API或命令行工具,对数据进行预填充处理。

步骤五:运行优化后的推理过程,观察处理速度和结果质量。

步骤六:根据需要调整参数,以获得最佳的性能和准确性。

精选AI产品推荐

Elicit

Elicit是一款能够以超人速度分析研究论文的AI助手。它可以自动完成繁琐的研究任务,如论文摘要、数据提取和综合研究发现。用户可以搜索相关论文、获取一句话摘要、从论文中提取详细信息并进行整理、寻找主题和概念等。Elicit的准确度高,使用方便,已受到广大研究者的信赖和好评。

研究工具

629.6K

中文精选

Findin AI

Findin AI 是一款旨在通过人工智能技术全面提速学术研究工作流的工具。它通过文献筛选、论文阅读、笔记摘录、主题研究、文献综述和学术写作等功能,帮助用户高效管理文献和知识,提升研究效率。产品利用AI技术,如自动总结、一键获取参考文献、文献问答等,大幅减少研究过程中的重复劳动,使研究者能够专注于创新和深度思考。

研究工具

301.7K