Dream 7B

Dream 7B 是由香港大學 NLP 組和華為諾亞方舟實驗室聯合推出的最新擴散大語言模型。它在文本生成領域展現了優異的性能,特別是在複雜推理、長期規劃和上下文連貫性等方面。該模型採用了先進的訓練方法,具有強大的計劃能力和靈活的推理能力,為各類 AI 應用提供了更為強大的支持。

AI模型

105.2K

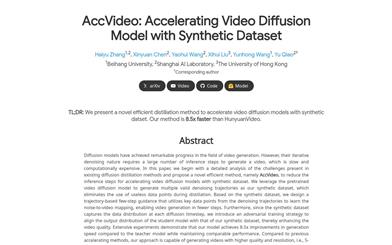

Accvideo

AccVideo 是一種新穎的高效蒸餾方法,通過合成數據集加速視頻擴散模型的推理速度。該模型能夠在生成視頻時實現 8.5 倍的速度提升,同時保持相似的性能。它使用預訓練的視頻擴散模型生成多條有效去噪軌跡,從而優化了數據的使用和生成過程。AccVideo 特別適用於需要高效視頻生成的場景,如電影製作、遊戲開發等,適合研究人員和開發者使用。

視頻生成

98.8K

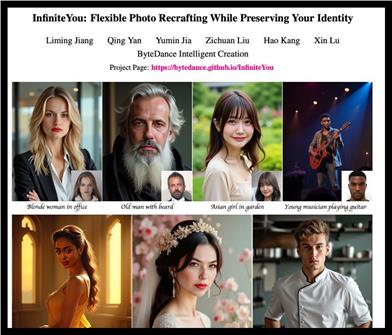

Infiniteyou

InfiniteYou(InfU)是一個基於擴散變換器的強大框架,旨在實現靈活的圖像重構,並保持用戶身份。它通過引入身份特徵並採用多階段訓練策略,顯著提升了圖像生成的質量和美學,同時改善了文本與圖像的對齊。該技術對提高圖像生成的相似性和美觀性具有重要意義,適用於各種圖像生成任務。

圖片生成

252.5K

Trajectorycrafter

TrajectoryCrafter 是一種先進的相機軌跡重定向工具,利用擴散模型技術,將單目視頻中的相機運動重新設計,提升視頻的表現力和視覺吸引力。該技術可廣泛應用於影視製作和虛擬現實等領域,具備高效、便捷和創新的特點,旨在為用戶提供更多創意自由和控制能力。

視頻編輯

58.0K

國外精選

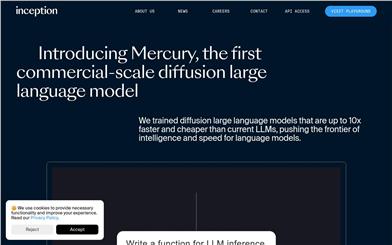

Inception Labs

Inception Labs 是一家專注於開發擴散式大語言模型(dLLMs)的公司。其技術靈感來源於先進的圖像和視頻生成系統,如 Midjourney 和 Sora。通過擴散模型,Inception Labs 提供了比傳統自迴歸模型快 5-10 倍的速度、更高的效率和更強的生成控制能力。其模型支持並行文本生成,能夠糾正錯誤和幻覺,適合多模態任務,並且在推理和結構化數據生成方面表現出色。公司由斯坦福、UCLA 和康奈爾大學的研究人員和工程師組成,是擴散模型領域的先驅。

AI模型

82.5K

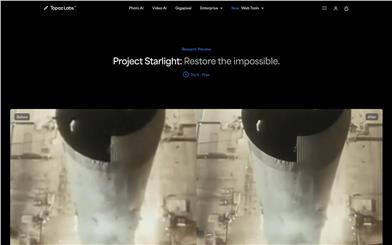

Project Starlight

Project Starlight 是 Topaz Labs 推出的一款 AI 視頻增強模型,專為提升低分辨率和損壞視頻的質量而設計。它採用了擴散模型技術,能夠實現視頻的超分辨率、降噪、去模糊和銳化等功能,同時保持時間一致性,確保視頻幀之間的流暢過渡。該技術是視頻增強領域的重大突破,為視頻修復和提升帶來了前所未有的高質量效果。目前,Project Starlight 提供免費試用,並計劃在未來支持 4K 導出,主要面向需要高質量視頻修復和增強的用戶和企業。

視頻編輯

97.4K

國外精選

Mercury Coder

Mercury Coder 是 Inception Labs 推出的首款商用級擴散大語言模型(dLLM),專為代碼生成優化。該模型採用擴散模型技術,通過‘粗到細’的生成方式,顯著提升生成速度和質量。其速度比傳統自迴歸語言模型快 5-10 倍,能夠在 NVIDIA H100 硬件上達到每秒 1000 多個 token 的生成速度,同時保持高質量的代碼生成能力。該技術的背景是當前自迴歸語言模型在生成速度和推理成本上的瓶頸,而 Mercury Coder 通過算法優化突破了這一限制,為企業級應用提供了更高效、低成本的解決方案。

代碼助手

97.7K

Videograin

VideoGrain 是一種基於擴散模型的視頻編輯技術,通過調節時空注意力機制實現多粒度視頻編輯。該技術解決了傳統方法中語義對齊和特徵耦合的問題,能夠對視頻內容進行精細控制。其主要優點包括零樣本編輯能力、高效的文本到區域控制以及特徵分離能力。該技術適用於需要對視頻進行復雜編輯的場景,如影視後期、廣告製作等,能夠顯著提升編輯效率和質量。

視頻編輯

51.3K

Makeanything

MakeAnything 是一個基於擴散變換器的模型,專注於多領域程序化序列生成。該技術通過結合先進的擴散模型和變換器架構,能夠生成高質量的、逐步的創作序列,如繪畫、雕塑、圖標設計等。其主要優點在於能夠處理多種領域的生成任務,並且可以通過少量樣本快速適應新領域。該模型由新加坡國立大學 Show Lab 團隊開發,目前以開源形式提供,旨在推動多領域生成技術的發展。

AI設計工具

54.1K

Pippo

Pippo 是由 Meta Reality Labs 和多所高校合作開發的生成模型,能夠從單張普通照片生成高分辨率的多人視角視頻。該技術的核心優勢在於無需額外輸入(如參數化模型或相機參數),即可生成高質量的 1K 分辨率視頻。它基於多視角擴散變換器架構,具有廣泛的應用前景,如虛擬現實、影視製作等。Pippo 的代碼已開源,但不包含預訓練權重,用戶需要自行訓練模型。

視頻生成

89.7K

On Device Sora

On-device Sora 是一個開源項目,旨在通過線性比例跳躍(LPL)、時間維度標記合併(TDTM)和動態加載併發推理(CI-DL)等技術,實現在移動設備(如 iPhone 15 Pro)上高效的視頻生成。該項目基於 Open-Sora 模型開發,能夠根據文本輸入生成高質量視頻。其主要優點包括高效性、低功耗和對移動設備的優化。該技術適用於需要在移動設備上快速生成視頻內容的場景,如短視頻創作、廣告製作等。項目目前開源,用戶可以免費使用。

視頻生成

50.0K

Diffsplat

DiffSplat 是一種創新的 3D 生成技術,能夠從文本提示和單視圖圖像快速生成 3D 高斯點雲。該技術通過利用大規模預訓練的文本到圖像擴散模型,實現了高效的 3D 內容生成。它解決了傳統 3D 生成方法中數據集有限和無法有效利用 2D 預訓練模型的問題,同時保持了 3D 一致性。DiffSplat 的主要優點包括高效的生成速度(1~2 秒內完成)、高質量的 3D 輸出以及對多種輸入條件的支持。該模型在學術研究和工業應用中具有廣泛前景,尤其是在需要快速生成高質量 3D 模型的場景中。

3D建模

52.2K

Go With The Flow

Go with the Flow 是一種創新的視頻生成技術,通過使用扭曲噪聲代替傳統的高斯噪聲,實現了對視頻擴散模型運動模式的高效控制。該技術無需對原始模型架構進行修改,即可在不增加計算成本的情況下,實現對視頻中物體和相機運動的精確控制。其主要優點包括高效性、靈活性和可擴展性,能夠廣泛應用於圖像到視頻生成、文本到視頻生成等多種場景。該技術由 Netflix Eyeline Studios 等機構的研究人員開發,具有較高的學術價值和商業應用潛力,目前開源免費提供給公眾使用。

視頻生成

61.5K

Tokenverse

TokenVerse 是一種創新的多概念個性化方法,它利用預訓練的文本到圖像擴散模型,能夠從單張圖像中解耦複雜的視覺元素和屬性,並實現無縫的概念組合生成。這種方法突破了現有技術在概念類型或廣度上的限制,支持多種概念,包括物體、配飾、材質、姿勢和光照等。TokenVerse 的重要性在於其能夠為圖像生成領域帶來更靈活、更個性化的解決方案,滿足用戶在不同場景下的多樣化需求。目前,TokenVerse 的代碼尚未公開,但其在個性化圖像生成方面的潛力已經引起了廣泛關注。

圖片生成

56.6K

X Dyna

X-Dyna是一種創新的零樣本人類圖像動畫生成技術,通過將驅動視頻中的面部表情和身體動作遷移到單張人類圖像上,生成逼真且富有表現力的動態效果。該技術基於擴散模型,通過Dynamics-Adapter模塊,將參考外觀上下文有效整合到擴散模型的空間注意力中,同時保留運動模塊合成流暢複雜動態細節的能力。它不僅能夠實現身體姿態控制,還能通過本地控制模塊捕捉與身份無關的面部表情,實現精確的表情傳遞。X-Dyna在多種人類和場景視頻的混合數據上進行訓練,能夠學習物理人體運動和自然場景動態,生成高度逼真和富有表現力的動畫。

視頻生成

48.9K

中文精選

Hunyuan3d 2.0

Hunyuan3D 2.0 是騰訊推出的一種先進大規模 3D 合成系統,專注於生成高分辨率紋理化的 3D 資產。該系統包括兩個基礎組件:大規模形狀生成模型 Hunyuan3D-DiT 和大規模紋理合成模型 Hunyuan3D-Paint。它通過解耦形狀和紋理生成的難題,為用戶提供了靈活的 3D 資產創作平臺。該系統在幾何細節、條件對齊、紋理質量等方面超越了現有的開源和閉源模型,具有極高的實用性和創新性。目前,該模型的推理代碼和預訓練模型已開源,用戶可以通過官網或 Hugging Face 空間快速體驗。

3D建模

185.5K

Diffusion As Shader

Diffusion as Shader (DaS) 是一種創新的視頻生成控制模型,旨在通過3D感知的擴散過程實現對視頻生成的多樣化控制。該模型利用3D跟蹤視頻作為控制輸入,能夠在統一的架構下支持多種視頻控制任務,如網格到視頻生成、相機控制、運動遷移和對象操作等。DaS的主要優勢在於其3D感知能力,能夠有效提升生成視頻的時間一致性,並在短時間內通過少量數據微調即可展現出強大的控制能力。該模型由香港科技大學等多所高校的研究團隊共同開發,旨在推動視頻生成技術的發展,為影視製作、虛擬現實等領域提供更為靈活和高效的解決方案。

視頻生成

55.5K

Creatilayout

CreatiLayout是一種創新的佈局到圖像生成技術,利用孿生多模態擴散變換器(Siamese Multimodal Diffusion Transformer)來實現高質量和細粒度可控的圖像生成。該技術能夠精確渲染複雜的屬性,如顏色、紋理、形狀、數量和文本,適用於需要精確佈局和圖像生成的應用場景。其主要優點包括高效的佈局引導集成、強大的圖像生成能力和大規模數據集的支持。CreatiLayout由復旦大學和字節跳動公司聯合開發,旨在推動圖像生成技術在創意設計領域的應用。

AI設計工具

59.9K

Vmix

VMix是一種用於提升文本到圖像擴散模型美學質量的技術,通過創新的條件控制方法——價值混合交叉注意力,系統性地增強圖像的美學表現。VMix作為一個即插即用的美學適配器,能夠在保持視覺概念通用性的同時提升生成圖像的質量。VMix的關鍵洞見是通過設計一種優越的條件控制方法來增強現有擴散模型的美學表現,同時保持圖像與文本的對齊。VMix足夠靈活,可以應用於社區模型,以實現更好的視覺性能,無需重新訓練。

圖片生成

49.7K

Diffsensei

DiffSensei是一個結合了多模態大型語言模型(LLMs)和擴散模型的定製化漫畫生成模型。它能夠根據用戶提供的文本提示和角色圖像,生成可控制的黑白漫畫面板,並具有靈活的角色適應性。這項技術的重要性在於它將自然語言處理與圖像生成相結合,為漫畫創作和個性化內容生成提供了新的可能性。DiffSensei模型以其高質量的圖像生成、多樣化的應用場景以及對資源的高效利用而受到關注。目前,該模型在GitHub上公開,可以免費下載使用,但具體的使用可能需要一定的計算資源。

AI設計工具

92.7K

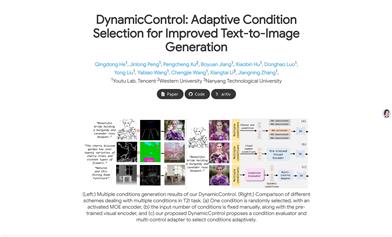

Dynamiccontrol

DynamicControl是一個用於提升文本到圖像擴散模型控制力的框架。它通過動態組合多樣的控制信號,支持自適應選擇不同數量和類型的條件,以更可靠和詳細地合成圖像。該框架首先使用雙循環控制器,利用預訓練的條件生成模型和判別模型,為所有輸入條件生成初始真實分數排序。然後,通過多模態大型語言模型(MLLM)構建高效條件評估器,優化條件排序。DynamicControl聯合優化MLLM和擴散模型,利用MLLM的推理能力促進多條件文本到圖像任務,最終排序的條件輸入到並行多控制適配器,學習動態視覺條件的特徵圖並整合它們以調節ControlNet,增強對生成圖像的控制。

AI模型

46.1K

Invsr

InvSR是一種基於擴散反轉的圖像超分辨率技術,利用大型預訓練擴散模型中豐富的圖像先驗來提高超分辨率性能。該技術通過部分噪聲預測策略構建擴散模型的中間狀態,作為起始採樣點,並使用深度噪聲預測器估計最優噪聲圖,從而在前向擴散過程中初始化採樣,生成高分辨率結果。InvSR支持任意數量的採樣步驟,從一到五步不等,即使僅使用單步採樣,也展現出優於或媲美現有最先進方法的性能。

圖片增強

55.2K

Colorflow

ColorFlow是一個為圖像序列著色而設計的模型,特別注重在著色過程中保留角色和對象的身份信息。該模型利用上下文信息,能夠根據參考圖像池為黑白圖像序列中的不同元素(如角色的頭髮和服裝)準確生成顏色,並確保與參考圖像的顏色一致性。ColorFlow通過三個階段的擴散模型框架,提出了一種新穎的檢索增強著色流程,無需每個身份的微調或顯式身份嵌入提取,即可實現具有相關顏色參考的圖像著色。ColorFlow的主要優點包括其在保留身份信息的同時,還能提供高質量的著色效果,這對於卡通或漫畫系列的著色具有重要的市場價值。

圖片編輯

50.2K

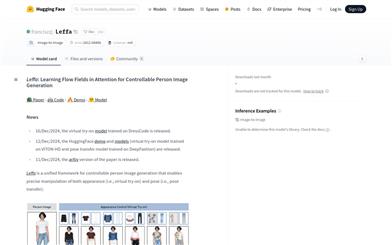

Leffa

Leffa是一個用於可控人物圖像生成的統一框架,它能夠精確控制人物的外觀(例如虛擬試穿)和姿態(例如姿態轉移)。該模型通過在訓練期間引導目標查詢關注參考圖像中的相應區域,減少細節扭曲,同時保持高圖像質量。Leffa的主要優點包括模型無關性,可以用於提升其他擴散模型的性能。

AI設計工具

80.0K

Comfyui HelloMeme

HelloMeme是一個集成了空間編織注意力(Spatial Knitting Attentions)的擴散模型,用於嵌入高級別和細節豐富的條件。該模型支持圖像和視頻的生成,具有改善生成視頻與驅動視頻之間表情一致性、減少VRAM使用、優化算法等優點。HelloMeme由HelloVision團隊開發,屬於HelloGroup Inc.,是一個前沿的圖像和視頻生成技術,具有重要的商業和教育價值。

視頻生成

69.8K

Color Diffusion

Color-diffusion是一個基於擴散模型的圖像著色項目,它使用LAB顏色空間對黑白圖片進行上色。該項目的主要優點在於能夠利用已有的灰度信息(L通道),通過訓練模型來預測顏色信息(A和B通道)。這種技術在圖像處理領域具有重要意義,尤其是在老照片修復和藝術創作中。Color-diffusion作為一個開源項目,其背景信息顯示,它是作者為了滿足好奇心和體驗從頭開始訓練擴散模型而快速構建的。項目目前是免費的,並且有很大的改進空間。

圖片編輯

57.4K

Anchorcrafter

AnchorCrafter是一個創新的擴散模型系統,旨在生成包含目標人物和定製化對象的2D視頻,通過人-物交互(HOI)的集成,實現高視覺保真度和可控交互。該系統通過HOI-外觀感知增強從任意多視角識別對象外觀的能力,並分離人和物的外觀;HOI-運動注入則通過克服對象軌跡條件和相互遮擋管理的挑戰,實現複雜的人-物交互。此外,HOI區域重新加權損失作為訓練目標,增強了對對象細節的學習。該技術在保持對象外觀和形狀意識的同時,也維持了人物外觀和運動的一致性,對於在線商務、廣告和消費者參與等領域具有重要意義。

視頻生成

250.9K

Text To Pose

text-to-pose是一個研究項目,旨在通過文本描述生成人物姿態,並利用這些姿態生成圖像。該技術結合了自然語言處理和計算機視覺,通過改進擴散模型的控制和質量,實現了從文本到圖像的生成。項目背景基於NeurIPS 2024 Workshop上發表的論文,具有創新性和前沿性。該技術的主要優點包括提高圖像生成的準確性和可控性,以及在藝術創作和虛擬現實等領域的應用潛力。

圖片生成

53.5K

Diffusiondrive

DiffusionDrive是一個用於即時端到端自動駕駛的截斷擴散模型,它通過減少擴散去噪步驟來加快計算速度,同時保持高準確性和多樣性。該模型直接從人類示範中學習,無需複雜的預處理或後處理步驟,即可實現即時的自動駕駛決策。DiffusionDrive在NAVSIM基準測試中取得了88.1 PDMS的突破性成績,並且能夠在45 FPS的速度下運行。

AI模型

52.4K

Tryoffdiff

TryOffDiff是一種基於擴散模型的高保真服裝重建技術,用於從穿著個體的單張照片中生成標準化的服裝圖像。這項技術與傳統的虛擬試穿不同,它旨在提取規範的服裝圖像,這在捕捉服裝形狀、紋理和複雜圖案方面提出了獨特的挑戰。TryOffDiff通過使用Stable Diffusion和基於SigLIP的視覺條件來確保高保真度和細節保留。該技術在VITON-HD數據集上的實驗表明,其方法優於基於姿態轉移和虛擬試穿的基線方法,並且需要較少的預處理和後處理步驟。TryOffDiff不僅能夠提升電子商務產品圖像的質量,還能推進生成模型的評估,並激發未來在高保真重建方面的工作。

AI設計工具

98.8K

- 1

- 2

- 3

- 4

精選AI產品推薦

中文精選

騰訊混元圖像 2.0

騰訊混元圖像 2.0 是騰訊最新發布的 AI 圖像生成模型,顯著提升了生成速度和畫質。通過超高壓縮倍率的編解碼器和全新擴散架構,使得圖像生成速度可達到毫秒級,避免了傳統生成的等待時間。同時,模型通過強化學習算法與人類美學知識的結合,提升了圖像的真實感和細節表現,適合設計師、創作者等專業用戶使用。

圖片生成

80.6K

國外精選

Lovart

Lovart 是一款革命性的 AI 設計代理,能夠將創意提示轉化為藝術作品,支持從故事板到品牌視覺的多種設計需求。其重要性在於打破傳統設計流程,節省時間並提升創意靈感。Lovart 當前處於測試階段,用戶可加入等候名單,隨時體驗設計的樂趣。

AI設計工具

63.8K

Fastvlm

FastVLM 是一種高效的視覺編碼模型,專為視覺語言模型設計。它通過創新的 FastViTHD 混合視覺編碼器,減少了高分辨率圖像的編碼時間和輸出的 token 數量,使得模型在速度和精度上表現出色。FastVLM 的主要定位是為開發者提供強大的視覺語言處理能力,適用於各種應用場景,尤其在需要快速響應的移動設備上表現優異。

AI模型

51.1K

Keysync

KeySync 是一個針對高分辨率視頻的無洩漏唇同步框架。它解決了傳統唇同步技術中的時間一致性問題,同時通過巧妙的遮罩策略處理表情洩漏和麵部遮擋。KeySync 的優越性體現在其在唇重建和跨同步方面的先進成果,適用於自動配音等實際應用場景。

視頻編輯

48.3K

Manus

Manus 是由 Monica.im 研發的全球首款真正自主的 AI 代理產品,能夠直接交付完整的任務成果,而不僅僅是提供建議或答案。它採用 Multiple Agent 架構,運行在獨立虛擬機中,能夠通過編寫和執行代碼、瀏覽網頁、操作應用等方式直接完成任務。Manus 在 GAIA 基準測試中取得了 SOTA 表現,展現了強大的任務執行能力。其目標是成為用戶在數字世界的‘代理人’,幫助用戶高效完成各種複雜任務。

個人助理

1.5M

Trae國內版

Trae是一款專為中文開發場景設計的AI原生IDE,將AI技術深度集成於開發環境中。它通過智能代碼補全、上下文理解等功能,顯著提升開發效率和代碼質量。Trae的出現填補了國內AI集成開發工具的空白,滿足了中文開發者對高效開發工具的需求。其定位為高端開發工具,旨在為專業開發者提供強大的技術支持,目前尚未明確公開價格,但預計會採用付費模式以匹配其高端定位。

開發與工具

137.7K

國外精選

Pika

Pika是一個視頻製作平臺,用戶可以上傳自己的創意想法,Pika會自動生成相關的視頻。主要功能有:支持多種創意想法轉視頻,視頻效果專業,操作簡單易用。平臺採用免費試用模式,定位面向創意者和視頻愛好者。

視頻生成

18.7M

中文精選

Liblibai

LiblibAI是一箇中國領先的AI創作平臺,提供強大的AI創作能力,幫助創作者實現創意。平臺提供海量免費AI創作模型,用戶可以搜索使用模型進行圖像、文字、音頻等創作。平臺還支持用戶訓練自己的AI模型。平臺定位於廣大創作者用戶,致力於創造條件普惠,服務創意產業,讓每個人都享有創作的樂趣。

AI模型

8.0M