海外精選

Inception Labs

Inception Labsは、拡散型大規模言語モデル(dLLMs)の開発に特化した企業です。その技術は、MidjourneyやSoraなどの高度な画像?動画生成システムから着想を得ています。拡散モデルを通じて、Inception Labsは、従来の自己回帰モデルよりも5~10倍高速で、効率性が高く、生成制御能力が優れたものを提供します。そのモデルは並列テキスト生成をサポートし、エラーや幻覚を修正でき、マルチモーダルタスクに適しており、推論と構造化データ生成において優れた性能を発揮します。スタンフォード大学、UCLA、コーネル大学の研究者とエンジニアによって設立され、拡散モデル分野のパイオニアです。

AIモデル

51.1K

Scira

Sciraは、強力な言語モデルと検索機能を通じて、ユーザーにより効率的で正確な情報検索体験を提供することを目的とした、AI技術に基づく検索エンジンです。Grok 2.0やClaude 3.5 Sonnetなどの複数の言語モデルをサポートしており、Tavilyなどの検索ツールを統合することで、ウェブ検索、プログラミングコード実行、天気予報など、さまざまな機能を提供します。Sciraの主な利点は、簡潔なインターフェースと強力な機能の統合であり、従来の検索エンジンに満足しておらず、AIを活用して検索効率を向上させたいユーザーに最適です。このプロジェクトはオープンソースで無料で、ユーザーは自分のニーズに合わせてローカルに展開したり、提供されているオンラインサービスを使用したりできます。

AI検索

46.6K

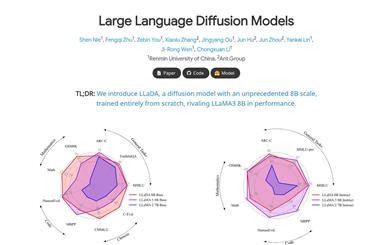

Llada

LLaDAは、拡散プロセスによってテキストを生成する新しいタイプの拡散モデルであり、従来の自己回帰モデルとは異なります。言語生成の拡張性、指示への追従、コンテキスト学習、対話能力、圧縮能力において優れた性能を発揮します。このモデルは、中国人民大学とアリババグループの研究者によって開発され、8Bの規模を持ち、完全にゼロからトレーニングされました。主な利点は、拡散プロセスを通じて柔軟にテキストを生成でき、数学の問題解決、コード生成、翻訳、複数回にわたる対話など、さまざまな言語タスクに対応できることです。LLaDAの登場は、特に生成品質と柔軟性の点で、言語モデルの発展に新たな方向性を提供します。

AIモデル

48.6K

Deepseek 日本語版

DeepSeekは、High-Flyerファンドの支援を受けた中国のAI研究所が開発した高度な言語モデルであり、オープンソースモデルと革新的なトレーニング方法に重点を置いています。R1シリーズモデルは、論理推論と問題解決において優れたパフォーマンスを発揮し、強化学習と混合専門家フレームワークを採用することで、低コストで効率的なトレーニングを実現しています。DeepSeekのオープンソース戦略はコミュニティのイノベーションを促進すると同時に、AI競争とオープンソースモデルの影響力に関する業界での議論を引き起こしています。登録不要で無料という利用方法は、ユーザーの参入障壁をさらに低くし、幅広いアプリケーションシナリオに適しています。

AIモデル

53.5K

Qwen2.5 Max

Qwen2.5-Maxは、20兆トークンを超える事前学習と、教師あり微調整、さらに人間のフィードバックによる強化学習を用いて後学習された大規模Mixture-of-Expert (MoE) モデルです。複数のベンチマークテストで優れた性能を示し、強力な知識とコーディング能力を備えています。阿里巴巴クラウドを通じてAPIインターフェースを提供しており、開発者は様々なアプリケーションシナリオで利用できます。主な利点としては、強力な性能、柔軟なデプロイ方法、効率的なトレーニング技術があり、人工知能分野によりスマートなソリューションを提供することを目指しています。

AIモデル

480.0K

海外精選

Codename Goose

Codename Gooseは、開発者がエンジニアリングタスクを効率的に完了できるよう支援する、ローカルで動作するAIエージェントツールです。オープンソースとローカル実行を重視し、ユーザーがタスク実行を完全に制御できるようにします。外部サーバーまたはAPIに接続することで、ユーザーのニーズに合わせて拡張し、複雑なタスクの自動処理を実現し、開発者はより重要な業務に集中できます。Gooseのオープンソース特性は、開発者の貢献とイノベーションを促進し、ローカル実行モードはデータプライバシーとタスク実行効率を保証します。

開発とツール

53.5K

中国語精選

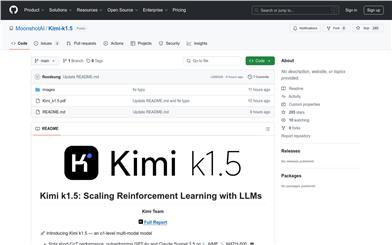

Kimi K1.5

Kimi k1.5は、MoonshotAIによって開発されたマルチモーダル言語モデルです。強化学習とロングコンテキスト拡張技術により、複雑な推論タスクにおけるモデルのパフォーマンスが大幅に向上しました。AIMEやMATH-500などの数学的推論タスクにおいて、GPT-4oやClaude Sonnet 3.5を上回るなど、複数のベンチマークテストで業界トップレベルの成果を達成しています。主な利点としては、効率的なトレーニングフレームワーク、強力なマルチモーダル推論能力、ロングコンテキストのサポートなどが挙げられます。Kimi k1.5は、プログラミング支援、数学の問題解決、コード生成など、複雑な推論と論理分析を必要とするアプリケーションシナリオを主に対象としています。

モデルトレーニングとデプロイ

220.0K

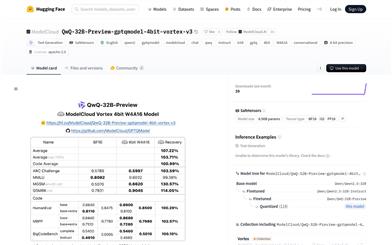

Qwq 32B Preview Gptqmodel 4bit Vortex V3

本製品は、Qwen2.5-32Bをベースとした4ビット量子化言語モデルです。GPTQ技術により、高効率推論と低リソース消費を実現しています。高い性能を維持しつつ、モデルのストレージと計算要件を大幅に削減するため、リソースが限られた環境での使用に適しています。本モデルは、インテリジェントカスタマーサービス、プログラミング支援、コンテンツ作成など、高性能な言語生成を必要とするアプリケーションシナリオを主に対象としています。オープンソースライセンスと柔軟な展開方法により、商業および研究分野で幅広い応用が期待できます。

チャットボット

53.3K

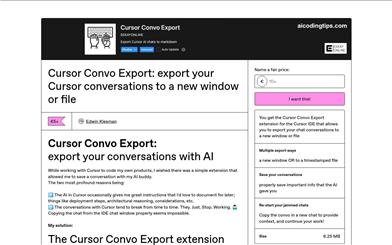

Cursor Convo エクスポート

Cursor Convo エクスポートは、Edwin Klesmanによって開発されたCursor AI拡張機能です。Cursor AIとのチャット履歴を新しいウィンドウまたはタイムスタンプ付きファイルにエクスポートできます。プログラマーにとって非常に便利で、AIから提供された重要な指示や情報(デプロイ手順、アーキテクチャ推論など)を保存し、後で参照できます。また、Cursorとの会話が中断した場合、このプラグインを使用して会話内容を新しい会話にコピーして作業を継続できます。価格は5ユーロ、サイズは6.25MBで、30日間の返金保証が付いています。

開発とツール

63.8K

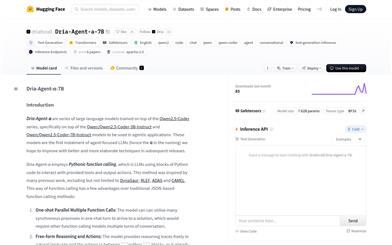

Dria Agent A 7B

Dria-Agent-a-7Bは、Qwen2.5-Coderシリーズを基に訓練された、エージェントアプリケーションに特化した大規模言語モデルです。Pythonic関数呼び出し方式を採用しており、従来のJSON関数呼び出し方法と比較して、単一呼び出しでの複数関数並列処理、自由形式の推論とアクション、複雑なソリューションの即時生成などの利点があります。Berkeley Function Calling Leaderboard (BFCL)、MMLU-Pro、Dria-Pythonic-Agent-Benchmark (DPAB)など、複数のベンチマークテストで優れた性能を発揮しています。モデルサイズは76.2億パラメーター、BF16テンソル型を使用し、テキスト生成タスクに対応しています。主な利点としては、強力なプログラミング支援能力、効率的な関数呼び出し方式、特定分野における高い精度が挙げられます。自動プログラミングやインテリジェントエージェントなど、複雑な論理処理と複数ステップのタスク実行が必要なアプリケーションシナリオに適しています。現在、Hugging Faceプラットフォームで無料で利用可能です。

コードアシスタント

46.9K

海外精選

Codestral 25.01

Codestral 25.01はMistral AIが提供する高度なプログラミング支援モデルであり、プログラミングモデル分野の最先端技術を代表しています。軽量かつ高速で、80種類以上のプログラミング言語に精通しており、低遅延かつ高頻度での使用に最適化されています。コード補完(FIM)、コード修正、テスト生成などのタスクに対応しています。Codestral 25.01はアーキテクチャとトークナイザーが改良されており、コード生成と補完速度は前世代製品と比較して約2倍高速化され、同クラスのプログラミングタスクにおいて、特にFIMユースケースで卓越した性能を発揮し、リーダーシップをとっています。主な利点としては、効率的なアーキテクチャ、高速なコード生成能力、そして多様なプログラミング言語への対応があり、開発者のプログラミング効率の大幅な向上に貢献します。Codestral 25.01は現在、Continue.devなどのIDE/IDEプラグインパートナーを通じて世界中の開発者に提供されており、企業におけるデータとモデルのレジデンシーのニーズを満たすために、オンプレミスでの導入もサポートしています。

コードアシスタント

50.8K

Githubアシスタント

GitHubアシスタントは、自然言語処理技術を活用した革新的なプログラミング支援ツールです。シンプルな言葉でGitHub上の様々なコードリポジトリを探求?理解することができます。直感的な操作性と高い効率性が特長で、複雑なプログラミング知識がなくても必要な情報を迅速に取得できます。assistant-uiとreltaが共同開発し、より便利で直感的なコード探索方法を提供することを目指しています。プログラマーにとって強力な支援ツールとなり、オープンソースコードを効果的に活用できるようサポートします。

コードアシスタント

46.6K

中国語精選

百度AIサーチ

百度AIサーチは、人工知能技術を基盤としたインテリジェント検索プラットフォームです。検索、インテリジェントなコンテンツ作成、画像処理など、複数の機能を統合し、ユーザーの作業効率と創造性を向上させることを目的としています。百度のAI技術を活用することで、ユーザーに便利なサービスを提供し、オフィスワーク、学習、デザインなど様々なシーンで活用できます。百度の強力な検索エンジンとAI技術を基盤としており、ユーザーに包括的なインテリジェント検索ソリューションを提供することを目指しています。一部の機能は無料トライアルを提供しており、その他の機能は有料となる場合があります。

AI検索

61.5K

中国語精選

GLM Zero Preview

GLM-Zero-Previewは、智譜が初めて拡張強化学習技術を用いて訓練した推論モデルです。AI推論能力の強化に焦点を当て、数理論理、コード、そして深い推論を必要とする複雑な問題の処理に優れています。基盤モデルと比較して、一般的なタスク能力を大幅に低下させることなく、専門的なタスク能力が大幅に向上しています。AIME 2024、MATH500、LiveCodeBenchの評価において、OpenAIのo1-previewと同等の性能を示しました。製品背景情報では、智譜華章科技有限公司が強化学習技術を通じてモデルの深層推論能力の向上に努めており、将来的には正式版GLM-Zeroをリリースし、より多くの技術分野に深層思考能力を拡張する計画であることが示されています。

AIモデル

54.6K

海外精選

Jules

JulesはGitHubと統合されたAIコードエージェントです。最新のGeminiモデルを使用し、問題解決のためのコード作成、複雑なプログラミングタスクの操作可能なステップへの分解、コードベースの理解とナビゲーション、ユニットテストによる変更の実行と検証、ユーザーフィードバックに基づく方法の調整が可能です。これは、プログラミング分野における人工知能の応用を体現しており、自動化とインテリジェントな分析を通じて開発効率の向上、エラーの削減を実現し、現代のソフトウェア開発において重要な補助ツールとなっています。

コードアシスタント

52.2K

O1 CODER

O1-CODERは、OpenAIのO1モデルを再現することを目指したプロジェクトであり、プログラミングタスクに焦点を当てています。強化学習(RL)とモンテカルロ木探索(MCTS)技術を組み合わせることで、モデルのシステム思考能力を強化し、より効率的で論理的なコード生成を目指しています。本プロジェクトは、特に大量の自動テストやコード最適化が必要な場面において、プログラミング効率とコード品質の向上に重要な意味を持ちます。

コードアシスタント

51.1K

Qwen2.5 Coder 1.5B Instruct GPTQ Int4

Qwen2.5-Coderは、Qwen大規模言語モデルの最新シリーズであり、コード生成、コード推論、コード修正に特化しています。強力なQwen2.5をベースに、5.5兆個のソースコード、テキストコード関連付け、合成データなどを含むトレーニングを行い、現在、オープンソースのコード言語モデルの中でもトップクラスの実力を誇り、そのコーディング能力はGPT-4に匹敵します。さらに、コードエージェントなど、より包括的な現実世界のアプリケーション基盤も備えており、コーディング能力の向上だけでなく、数学や汎用能力における優位性も維持しています。

コード推論

45.5K

Qwen2.5 Coder 1.5B Instruct GGUF

Qwen2.5-Coderは、コード生成、コード推論、コード修正のために設計されたQwen大規模言語モデルの最新シリーズです。強力なQwen2.5をベースに、トレーニングトークンを5.5兆に増やし、ソースコード、テキストコードベース、合成データなどを含めることで、Qwen2.5-Coder-32Bは現在最先端のオープンソースコード大規模言語モデルとなり、そのコーディング能力はGPT-4oに匹敵します。このモデルは1.5Bパラメーターの命令微調整バージョンで、GGUF形式を採用し、因果言語モデル、事前トレーニングと事後トレーニング段階、Transformersアーキテクチャなどの特徴を備えています。

コード推論

57.1K

Qwen2.5 Coder 1.5B Instruct AWQ

Qwen2.5-Coderは、Qwen大規模言語モデルの最新シリーズであり、コード生成、推論、修正のために設計されています。強力なQwen2.5をベースとしており、5.5兆個のソースコード、テキストコードベース、合成データなどを用いてトレーニングされたため、コード能力においてオープンソースコードLLMの最新レベルに達しています。コーディング能力の向上だけでなく、数学や一般的な能力における優位性も維持しています。

コード推論

45.5K

Qwen2.5 Coder 3B Instruct GGUF

Qwen2.5-Coderは、コード生成、コード推論、コード修正に特化したQwen大規模言語モデルの最新シリーズです。強力なQwen2.5をベースに、ソースコード、テキストコード接地、合成データなどを含む5.5兆トークンでトレーニングされました。Qwen2.5-Coder-32Bは、現在最先端のオープンソースコード大規模言語モデルであり、そのコーディング能力はGPT-4oに匹敵します。このモデルは、コードエージェントなど、実践的なアプリケーションにおいてより包括的な基盤を提供し、コーディング能力を高めると同時に、数学や汎用能力における優位性を維持しています。

コード推論

45.0K

Qwen2.5 Coder 32B Instruct GPTQ Int8

Qwen2.5-Coder-32B-Instruct-GPTQ-Int8は、Qwenシリーズのコード生成に特化した大規模言語モデルです。32億のパラメータを持ち、長文処理に対応しており、現在、オープンソースのコード生成分野で最先端のモデルの一つです。Qwen2.5をベースに更なるトレーニングと最適化が行われており、コード生成、推論、修正において顕著な性能向上を示すと同時に、数学や汎用的な能力も維持しています。GPTQ 8-bit量子化技術を採用することで、モデルサイズを削減し、実行効率を向上させています。

長文処理

48.6K

Qwen2.5 Coder 0.5B Instruct

Qwen2.5-Coderは、コード生成、コード推論、コード修正に特化したQwen大規模言語モデルの最新シリーズです。強力なQwen2.5をベースに、ソースコード、テキストコードベース、合成データなどを含む5.5兆トークンに拡張トレーニングを行い、Qwen2.5-Coder-32Bは現在最先端のオープンソースコードLLMとなり、そのコーディング能力はGPT-4oに匹敵します。このモデルはコーディング能力を向上させただけでなく、数学や一般能力における優位性も維持しており、コードエージェントなどの実用アプリケーションに、より包括的な基盤を提供します。

コードアシスタント

45.3K

Qwen2.5 Coder 1.5B

Qwen2.5-Coder-1.5Bは、Qwen2.5-Coderシリーズの大規模言語モデルであり、コード生成、コード推論、コード修正に特化しています。強力なQwen2.5を基盤とし、ソースコード、テキストコードベース、合成データなどを含む5.5兆トークンに拡張トレーニングすることで、現在のオープンソースコードLLMの中でもトップクラスの実力を誇り、コーディング能力はGPT-4oに匹敵します。さらに、数学と汎用能力も強化されており、コードエージェントなどの実際的なアプリケーションに、より包括的な基盤を提供します。

コードアシスタント

51.9K

Qwen2.5 Coder 1.5B Instruct

Qwen2.5-Coderは、Qwen大規模言語モデルの最新シリーズであり、コード生成、コード推論、コード修正に特化しています。Qwen2.5の強力な能力を基盤とし、5.5兆個のソースコード、テキストコードベース、合成データなどを用いてトレーニングされています。現在、オープンソースのコード生成言語モデルの中でもトップクラスであり、コーディング能力はGPT-4oに匹敵します。コーディング能力の向上に加え、数学や一般的な能力においても優れており、コードエージェントなどの実用アプリケーションに包括的な基盤を提供します。

コードアシスタント

47.7K

Qwen2.5 Coder 3B Instruct

Qwen2.5-Coderは、Qwen大規模言語モデルの最新シリーズであり、コード生成、コード推論、コード修正に特化しています。強力なQwen2.5をベースに、ソースコード、テキストコード接地、合成データなどを含む5.5兆トークンにトレーニングデータを増やすことで、コード生成、推論、修正能力を大幅に向上させました。Qwen2.5-Coder-3Bは、このシリーズの1つのモデルであり、30.9億パラメータ、36層、16個のAttentionヘッド(Q)と2個のAttentionヘッド(KV)、最大32,768トークンのコンテキスト長を備えています。このモデルは、現在オープンソースのコードLLMの中でもトップクラスであり、コーディング能力はGPT-4oに匹敵し、開発者にとって強力なコード支援ツールとなります。

コードアシスタント

45.0K

Qwen2.5 Coder 7B Instruct

Qwen2.5-Coder-7B-Instructは、Qwen2.5-Coderシリーズのコード特化型大規模言語モデルです。0.5億、1.5億、30億、70億、140億、320億パラメータの6種類の主要なモデルサイズを網羅し、様々な開発者のニーズに対応します。コード生成、コード推論、コード修正において顕著な性能向上を実現しており、強力なQwen2.5をベースに、ソースコード、テキストコードベース、合成データなどを含む5.5兆トークンで学習されています。Qwen2.5-Coder-32Bは現在最先端のオープンソースコードLLMであり、そのコーディング能力はGPT-4oに匹敵します。さらに、最大128Kトークンの長文コンテキストに対応し、コードエージェントのような実際的なアプリケーションに包括的な基盤を提供します。

コードアシスタント

47.2K

Qwen2.5 Coder 14B

Qwen2.5-Coder-14Bは、Qwenシリーズのコード専門の大規模言語モデルです。0.5億から32億パラメータまでの様々なモデルサイズを用意しており、開発者の多様なニーズに対応します。コード生成、コード推論、コード修正において顕著な性能向上を実現しており、強力なQwen2.5をベースに、ソースコード、テキストコード接地、合成データなどを含む5.5兆トークンで学習されています。Qwen2.5-Coder-32Bは、現在最先端のオープンソースコードLLMであり、そのコーディング能力はGPT-4oに匹敵します。さらに、コードエージェントなどの現実世界のアプリケーションに包括的な基盤を提供し、コーディング能力の強化に加え、数学や汎用能力における強みも維持しています。最大128Kトークンのロングコンテキストに対応しています。

コードアシスタント

48.0K

Qwen2.5 Coder 32B

Qwen2.5-Coder-32Bは、Qwen2.5をベースとしたコード生成モデルで、32億個のパラメータを持ちます。これは現在、オープンソースのコード言語モデルの中で最大規模のモデルの一つです。コード生成、コード推論、コード修正において顕著な改善が見られ、最大128Kトークンの長文処理に対応できるため、コードエージェントなどの実用的なアプリケーションシナリオに適しています。数学や一般的な能力も維持しており、長文処理にも対応するため、開発者にとって強力なコード開発支援ツールとなります。

コードアシスタント

47.5K

Qwen2.5 Coder Artifacts

Qwen2.5 Coder Artifactsは、Hugging Faceプラットフォーム上でホストされているプログラミングツールの集合体であり、人工知能のプログラミング分野への応用を示しています。この製品群は最新の機械学習技術を活用し、開発者のコーディング効率の向上とコード品質の最適化を支援します。製品背景情報によると、Qwenによって作成?保守されており、開発者にとって強力なプログラミング支援ツールを提供することを目的としています。本製品は無料で、開発者の生産性向上を目指しています。

コードアシスタント

50.5K

Claude 3.5 Haiku

Claude 3.5 Haikuは、Anthropic社が発表した最新かつ最速のモデルです。プログラミング、ツール使用、推論タスクにおいて優れたパフォーマンスを発揮し、価格も手頃です。速度はClaude 3 Haikuとほぼ同等ですが、あらゆるスキルにおいて向上しており、多くのインテリジェンスベンチマークにおいて、前世代の最大モデルであるClaude 3 Opusを上回っています。Anthropic社はAIの安全性に注力しており、Claude 3.5 Haikuは開発過程において多言語および政策分野における広範な安全評価を受けており、機密情報の処理能力が強化されています。

会話型AI

53.0K

- 1

- 2

- 3

おすすめAI製品

海外精選

Jules AI

Jules は、自動で煩雑なコーディングタスクを処理し、あなたに核心的なコーディングに時間をかけることを可能にする異步コーディングエージェントです。その主な強みは GitHub との統合で、Pull Request(PR) を自動化し、テストを実行し、クラウド仮想マシン上でコードを検証することで、開発効率を大幅に向上させています。Jules はさまざまな開発者に適しており、特に忙しいチームには効果的にプロジェクトとコードの品質を管理する支援を行います。

開発プログラミング

42.0K

Nocode

NoCode はプログラミング経験を必要としないプラットフォームで、ユーザーが自然言語でアイデアを表現し、迅速にアプリケーションを生成することが可能です。これにより、開発の障壁を下げ、より多くの人が自身のアイデアを実現できるようになります。このプラットフォームはリアルタイムプレビュー機能とワンクリックデプロイ機能を提供しており、技術的な知識がないユーザーにも非常に使いやすい設計となっています。

開発プラットフォーム

41.4K

Listenhub

ListenHub は軽量級の AI ポッドキャストジェネレーターであり、中国語と英語に対応しています。最先端の AI 技術を使用し、ユーザーが興味を持つポッドキャストコンテンツを迅速に生成できます。その主な利点には、自然な会話と超高品質な音声効果が含まれており、いつでもどこでも高品質な聴覚体験を楽しむことができます。ListenHub はコンテンツ生成速度を改善するだけでなく、モバイルデバイスにも対応しており、さまざまな場面で使いやすいです。情報取得の高効率なツールとして位置づけられており、幅広いリスナーのニーズに応えています。

AI

40.3K

中国語精選

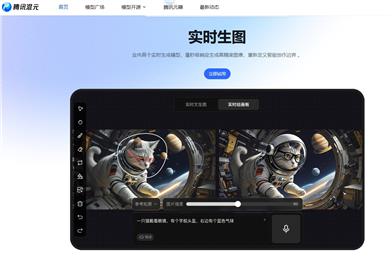

腾讯混元画像 2.0

腾讯混元画像 2.0 は腾讯が最新に発表したAI画像生成モデルで、生成スピードと画質が大幅に向上しました。超高圧縮倍率のエンコード?デコーダーと新しい拡散アーキテクチャを採用しており、画像生成速度はミリ秒級まで到達し、従来の時間のかかる生成を回避することが可能です。また、強化学習アルゴリズムと人間の美的知識の統合により、画像のリアリズムと詳細表現力を向上させ、デザイナー、クリエーターなどの専門ユーザーに適しています。

画像生成

39.7K

Openmemory MCP

OpenMemoryはオープンソースの個人向けメモリレイヤーで、大規模言語モデル(LLM)に私密でポータブルなメモリ管理を提供します。ユーザーはデータに対する完全な制御権を持ち、AIアプリケーションを作成する際も安全性を保つことができます。このプロジェクトはDocker、Python、Node.jsをサポートしており、開発者が個別化されたAI体験を行うのに適しています。また、個人情報を漏らすことなくAIを利用したいユーザーにお勧めします。

オープンソース

40.8K

Fastvlm

FastVLM は、視覚言語モデル向けに設計された効果的な視覚符号化モデルです。イノベーティブな FastViTHD ミックスドビジュアル符号化エンジンを使用することで、高解像度画像の符号化時間と出力されるトークンの数を削減し、モデルのスループットと精度を向上させました。FastVLM の主な位置付けは、開発者が強力な視覚言語処理機能を得られるように支援し、特に迅速なレスポンスが必要なモバイルデバイス上で優れたパフォーマンスを発揮します。

画像処理

39.7K

海外精選

ピカ

ピカは、ユーザーが自身の創造的なアイデアをアップロードすると、AIがそれに基づいた動画を自動生成する動画制作プラットフォームです。主な機能は、多様なアイデアからの動画生成、プロフェッショナルな動画効果、シンプルで使いやすい操作性です。無料トライアル方式を採用しており、クリエイターや動画愛好家をターゲットとしています。

映像制作

17.6M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M