シェーダとしての拡散 (Diffusion As Shader)

紹介 :

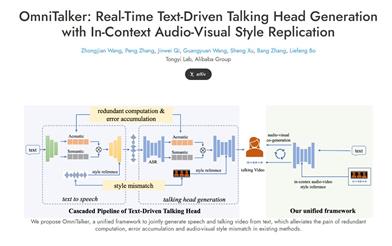

Diffusion as Shader (DaS) は、3D認識に基づく拡散プロセスを通じてビデオ生成の多様な制御を実現することを目指した、革新的なビデオ生成制御モデルです。3Dトラッキングビデオを制御入力として利用し、メッシュからビデオ生成、カメラ制御、モーション転移、オブジェクト操作など、様々なビデオ制御タスクを統一アーキテクチャ内でサポートします。DaSの主な利点は、その3D認識能力であり、生成ビデオの時間的一貫性を効果的に向上させ、少量のデータで短時間で微調整することで強力な制御能力を発揮します。本モデルは、香港科技大学を始めとする複数の大学研究チームが共同で開発し、ビデオ生成技術の発展を促進し、映画制作、仮想現実などの分野に、より柔軟で効率的なソリューションを提供することを目指しています。

ターゲットユーザー :

本製品は、映画制作関係者、仮想現実開発者、ゲームデザイナーなど、高品質なビデオ生成と制御を必要とする専門家に適しており、複雑なビデオ制作ニーズをより効率的に実現する支援をします。

使用シナリオ

シンプルなアニメーションメッシュを、詳細な外観と幾何学的特徴を持つ高品質なビデオに変換する。

与えられたテキストプロンプトに基づいて、特定のカメラ運動軌跡を持つビデオを生成する。

あるビデオのモーションを別のビデオに転送し、モーション転移を実現する。

特定のビデオ制作ニーズを満たすため、ビデオ内の特定オブジェクトを移動、回転などの操作を行う。

製品特徴

テキストプロンプトまたは画像から高品質なビデオを生成

上下左右の移動や螺旋運動など、正確なカメラ制御を実現

シンプルなアニメーションメッシュを視覚的に豊かなビデオに変換

特定オブジェクトの移動、回転などのオブジェクト操作に対応

あるビデオのモーションを別のビデオに転送するモーション転移を実現

3Dトラッキングビデオにより生成ビデオの時間的一貫性を向上

少量のデータと短時間でモデルの微調整が可能

使用チュートリアル

1. テキストプロンプト、画像、またはシンプルなアニメーションメッシュなどの入力データを用意します。

2. DaSモデルが提供するツール(Depth Pro、SAMなど)を使用して、深度図推定、オブジェクトセグメンテーションなど、入力データの前処理を行います。

3. 必要に応じて、ビデオ生成の制御入力として3Dトラッキングビデオを生成します。

4. 前処理済みのデータと3DトラッキングビデオをDaSモデルに入力し、ビデオを生成します。

5. モデルパラメータを微調整して、生成ビデオの品質と制御効果を最適化します。

6. 生成されたビデオを出力し、後続の編集や適用を行います。

おすすめAI製品

海外精選

ピカ

ピカは、ユーザーが自身の創造的なアイデアをアップロードすると、AIがそれに基づいた動画を自動生成する動画制作プラットフォームです。主な機能は、多様なアイデアからの動画生成、プロフェッショナルな動画効果、シンプルで使いやすい操作性です。無料トライアル方式を採用しており、クリエイターや動画愛好家をターゲットとしています。

映像制作

17.6M

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

AIモデル

11.4M