Llama Lynx 70b 4bit 量子化

紹介 :

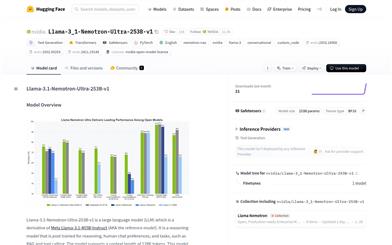

Llama-Lynx-70b-4bit-量子化は、PatronusAIが開発した70億パラメータの大規模テキスト生成モデルです。4ビット量子化処理が施されており、モデルサイズと推論速度の最適化を実現しています。Hugging FaceのTransformersライブラリに基づいて構築されており、多言語に対応し、特に対話生成とテキスト生成において優れた性能を発揮します。高い性能を維持しながらモデルのストレージと計算ニーズを削減できるため、リソースに制約のある環境でも強力なAIモデルを展開できます。

ターゲットユーザー :

AI開発者やデータサイエンティスト、特にリソースに制約のある環境で高性能なテキスト生成モデルを展開する必要がある専門家を対象としています。多言語対応と量子化技術により、多国籍企業や複数の言語のテキスト処理が必要なアプリケーションシーンにも適しています。

使用シナリオ

事例1:Llama-Lynx-70b-4bit-量子化を使用して、顧客の問い合わせに自動的に回答するカスタマーサービスチャットボットを開発します。

事例2:このモデルを使用して記事やブログコンテンツを生成し、コンテンツ作成の効率を向上させます。

事例3:教育分野で、パーソナライズされた学習教材や練習問題を生成します。

製品特徴

? テキスト生成:指定されたプロンプトに基づいて、一貫性があり関連性の高いテキストを生成します。

? 対話生成:チャットボットや対話システムの構築に適しており、自然な対話の応答を生成します。

? 多言語対応:多言語に対応しており、様々な言語のテキスト生成タスクを処理できます。

? 4ビット量子化:量子化技術によりモデルサイズを削減し、推論速度を向上させ、計算コストを削減します。

? Transformersライブラリとの互換性:既存のTransformersベースのシステムに容易に統合できます。

? モデルカードとファイルバージョン管理:モデルの変更とパフォーマンスを追跡しやすいように、モデルカードとファイルバージョン管理機能を提供しています。

? コミュニティディスカッション:Hugging Faceコミュニティで、モデルの使用と改善について議論できます。

使用チュートリアル

1. Hugging Faceの公式サイトにアクセスし、アカウントを登録します。

2. モデルページ(https://huggingface.co/PatronusAI/Llama-Lynx-4bit-Quantized)に移動します。

3. モデルカードを読み、モデルの詳細と利用条件を確認します。

4. モデルファイルをダウンロードし、提供されているガイドに従ってローカルに展開するか、Hugging FaceのInference APIを使用して展開します。

5. Pythonまたはその他の対応言語を使用して、モデルにテキストプロンプトを送信し、生成されたテキストを受信するコードを作成します。

6. 必要に応じてモデルパラメータを調整し、生成されるテキストの品質を最適化します。

7. コミュニティディスカッションに参加し、他の開発者と使用経験やベストプラクティスを共有します。

おすすめAI製品

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

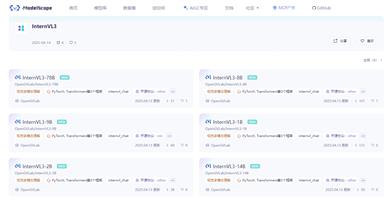

AIモデル

11.4M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M