SAM Graph

紹介 :

SAM-guided Graph Cut for 3D Instance Segmentationは、3D幾何学的情報と多視点画像情報を活用して3Dインスタンスセグメンテーションを行う深層学習手法です。3Dから2Dへのクエリフレームワークにより、2Dセグメンテーションモデルを効果的に3Dインスタンスセグメンテーションに活用します。超点グラフをグラフカット問題として構築し、グラフニューラルネットワークによって学習することで、様々なシーンにおけるロバストなセグメンテーション性能を実現します。

ターゲットユーザー :

本技術は、自動運転、ロボットナビゲーション、拡張現実など、3Dインスタンスセグメンテーションが必要な分野に適用可能です。特に、複雑なシーンの処理や、高多様性の3Dアノテーションデータが不足しているアプリケーションシーンに適しています。

使用シナリオ

自動運転において、周囲環境の3Dインスタンスセグメンテーションを行い、車両や歩行者の識別と追跡を行います。

ロボットナビゲーションにおいて、室内環境の3Dインスタンスセグメンテーションを行い、正確な経路計画を実現します。

拡張現実において、現実世界のシーンの3Dインスタンスセグメンテーションを行い、仮想物体と現実世界の自然な融合を実現します。

製品特徴

3D幾何学的情報と多視点画像情報を用いたインスタンスセグメンテーション

3Dから2Dへのクエリフレームワークによるシーン汎化能力の向上

グラフカット問題によるセグメンテーション結果の最適化

2Dセグメンテーションモデルに基づくグラフニューラルネットワークの学習

ScanNet、ScanNet++、KITTI-360データセットでの性能検証

様々なシーンにおけるロバストなセグメンテーションの実現

使用チュートリアル

ステップ1:3D点群データの前処理を行い、シーンから超点を抽出します。

ステップ2:2Dセグメンテーションモデルを用いて多視点画像をセグメント化し、ノード特徴量を取得します。

ステップ3:多視点セグメンテーション結果に基づき、エッジウェイトを計算し、超点グラフを構築します。

ステップ4:グラフニューラルネットワークを、擬似3Dラベルを用いて学習させます。

ステップ5:グラフカットアルゴリズムを用いて超点グラフを処理し、3Dインスタンスセグメンテーションを行います。

ステップ6:様々なデータセットでモデル性能を検証し、パラメータを調整して様々なシーンに対応させます。

おすすめAI製品

Yolov8

YOLOv8は、YOLOシリーズ物体検出モデルの最新版であり、画像や動画内における複数の物体の正確かつ迅速な識別と位置特定、そしてそれらの移動のリアルタイム追跡が可能です。以前のバージョンと比較して、YOLOv8は検出速度と精度が大幅に向上しており、インスタンスセグメンテーションや姿勢推定など、様々な追加のコンピュータビジョンタスクにも対応しています。YOLOv8は様々なフォーマットで異なるハードウェアプラットフォームに展開でき、エンドツーエンドの物体検出ソリューションを提供します。

AI画像検出識別

229.1K

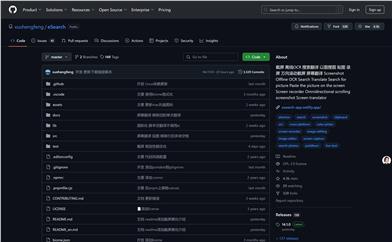

Lexy

LexyはAI技術に基づいた画像文字抽出ツールです。画像内の文字を自動認識し、抽出することで、ユーザーによる後処理や分析を容易にします。高い精度と高速な認識速度を誇り、あらゆる画像文字抽出シーンに適用可能です。画像から文字を抽出したい個人ユーザーから、大規模な画像文字処理を行う企業ユーザーまで、Lexyは皆様のニーズにお応えします。

AI画像検出識別

218.3K