Segment Anything Model 2

紹介 :

Segment Anything Model 2 (SAM 2)は、Meta社のAI研究部門FAIRによって発表されたビジョンセグメンテーションモデルです。シンプルなトランスフォーマーアーキテクチャとストリーミングメモリ設計により、リアルタイムの動画処理を実現しています。ユーザーインタラクションを通じてモデル循環データエンジンを構築し、これまでにない規模の動画セグメンテーションデータセットSA-Vを収集しました。SAM 2はSA-Vでトレーニングされており、幅広いタスクとビジョン領域において高い性能を発揮します。

ターゲットユーザー :

SAM 2は、画像と動画でのビジョンセグメンテーションを必要とする研究者や開発者、特にリアルタイム動画処理を必要とするユーザーにとって最適です。その高い性能と使いやすさから、関連分野における有力なツールとなっています。

使用シナリオ

SAM 2を用いた画像セグメンテーションに関する学術研究。

動画編集ソフトウェアへのSAM 2統合によるオブジェクトの自動セグメンテーション。

自動運転車のビジュアルデータ処理へのSAM 2の活用。

製品特徴

静止画と動画のビジョンセグメンテーションに対応。

シンプルな画像予測APIインターフェースを提供。

画像へのマスク自動生成に対応。

動画予測に対応し、複数オブジェクトのセグメンテーションとトラッキングが可能。

動画予測において、プロンプトの追加とマスクの伝播に対応。

速度向上のためのコンパイル済みモデルを提供。

詳細なインストールと使用方法ガイドを提供。

使用チュートリアル

1. gitを使用してSAM 2のコードリポジトリをローカルにクローンします。

2. 必要な依存関係をインストールし、SAM 2環境を設定します。

3. 事前トレーニング済みのモデルチェックポイントをダウンロードしてロードします。

4. 提供されているAPIインターフェースを使用して、画像または動画のセグメンテーション予測を行います。

5. 必要に応じてモデル設定を調整してパフォーマンスを最適化します。

6. Jupyter Notebookを使用してサンプルを確認し、実験を行います。

おすすめAI製品

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

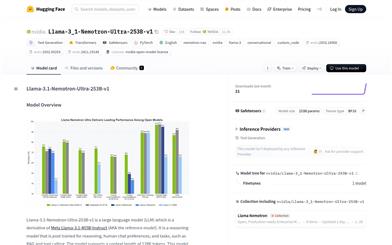

AIモデル

11.4M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M