ライブポートレートモニター

紹介 :

Live_Portrait_Monitorは、モニターまたはウェブカメラを通じて肖像画をアニメーション化することを目的としたオープンソースプロジェクトです。LivePortrait研究論文に基づき、深層学習技術を用いて、効率的に肖像画のアニメーション化を実現するための、拼接とリダイレクト制御を使用しています。本プロジェクトは作者によって積極的に更新?改良されており、研究目的でのみ使用可能です。

ターゲットユーザー :

本プロジェクトの対象ユーザーは、研究者や開発者、特に深層学習、コンピュータビジョン、画像処理に興味のある方々です。この技術は、肖像画のアニメーション化に関する研究開発を支援し、新たなインタラクションと表現方法を提供します。

使用シナリオ

研究者はLive_Portrait_Monitorを使用して、顔表情のリアルタイムキャプチャとアニメーション化を行います。

開発者はこのプロジェクトを利用して独自のアプリケーションに統合し、ユーザーがカスタム肖像画アニメーション機能を提供します。

教育機関は、この技術を教育事例として採用し、学生に深層学習を用いた画像アニメーション化の方法を教授します。

製品特徴

コードをクローンして環境を準備します。condaを使用してPython環境を作成し、依存関係をインストールします。

事前学習済みウェイトとInsightFace顔検出モデルをダウンロードします。

スクリプトを実行して推論を行い、アニメーションビデオを生成します。

コマンドライン引数を使用して、入力画像と駆動ビデオをカスタマイズできます。

各モジュールの推論速度を評価するスクリプトを提供します。

FOMM、Open Facevid2vid、SPADE、InsightFaceなどのオープンソースプロジェクトへの貢献に感謝します。

使用チュートリアル

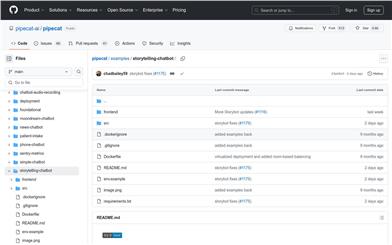

Live_Portrait_Monitorプロジェクトをローカルにクローンします。

condaを使用してPython 3.9.18環境を作成し、アクティブにします。

pipを使用してプロジェクトの依存関係をインストールします。

事前学習済みウェイトとInsightFace顔検出モデルをダウンロードして、指定されたディレクトリに解凍します。

inference_monitor.pyまたはinference_org.pyスクリプトを実行して推論を行い、アニメーションビデオを生成します。

必要に応じて、入力画像パス、駆動ビデオパスなどのコマンドライン引数を調整します。

speed.pyスクリプトを使用して推論速度を評価します。

おすすめAI製品

中国語精選

剪映dreamina

剪映DreaminaはTikTok(抖音)が提供するAIGCツールです。テキストを入力すると、AIが自動的にクリエイティブな画像を生成します。画像サイズやアスペクト比、テンプレートの種類も調整可能です。将来的には、TikTokの画像投稿やショート動画のコンテンツ制作にも活用され、TikTokのAIによるコンテンツ制作の充実を図ります。

AI画像生成

9.0M

Motionshop

Motionshopは、AIを活用したキャラクターアニメーションを作成できるウェブサイトです。アップロードした動画から人物を自動検出し、3Dのカートゥーンキャラクターモデルに置き換えることで、面白いAI動画を生成します。シンプルで使いやすいインターフェースと強力なAIアルゴリズムにより、ユーザーは簡単に自身の動画コンテンツを生動感あふれるアニメーション作品に変換できます。

AI動画編集

5.9M