使用场景

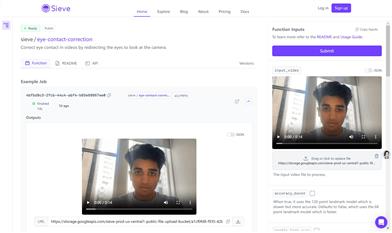

研究人员使用Live_Portrait_Monitor进行面部表情的实时捕捉和动画化。

开发者利用该项目集成到自己的应用中,提供用户自定义肖像动画的功能。

教育机构采用此技术作为教学案例,教授学生如何使用深度学习进行图像动画化。

产品特色

克隆代码并准备环境,使用conda创建Python环境并安装依赖。

下载预训练的权重和InsightFace面部检测模型。

运行脚本进行推理,生成动画视频。

支持通过命令行参数自定义输入图像和驱动视频。

提供脚本评估每个模块的推理速度。

感谢FOMM、Open Facevid2vid、SPADE、InsightFace等开源项目的贡献。

使用教程

克隆Live_Portrait_Monitor项目到本地。

使用conda创建Python 3.9.18环境并激活。

通过pip安装项目依赖项。

下载并解压预训练权重和InsightFace面部检测模型到指定目录。

运行inference_monitor.py或inference_org.py脚本进行推理,生成动画视频。

根据需要调整命令行参数,如输入图像路径、驱动视频路径等。

使用speed.py脚本评估推理速度。