Streamv2v

紹介 :

StreamV2Vは、ユーザープロンプトによってリアルタイムの動画から動画への翻訳(V2V)を実現する拡散モデルです。従来のバッチ処理とは異なり、StreamV2Vはストリーミング処理を採用することで、無限のフレーム数の動画を処理できます。その核心は、過去のフレームの情報を保存する特徴量バンクにあります。新しいフレームが入力されると、StreamV2Vは拡張自己注意機構と直接特徴量融合技術を用いて、類似する過去の情報を直接出力に融合します。特徴量バンクは、保存された特徴量と新しい特徴量を統合することで継続的に更新され、コンパクトで情報量の豊富な状態を維持します。StreamV2Vは、その適応性と効率性において優れており、微調整なしで画像拡散モデルとシームレスに統合できます。

ターゲットユーザー :

StreamV2Vは、リアルタイムの動画処理と翻訳を必要とする専門家や研究者向けです。動画編集、映画のポストプロダクション、リアルタイム動画エンハンスメント、仮想現実など、高速でシームレスな動画処理能力と高品質な出力を必要とする分野に特に適しています。

使用シナリオ

動画編集者はStreamV2Vを使用して、リアルタイムで動画のスタイルや効果を調整します。

映画のポストプロダクションチームはStreamV2Vを利用して、特殊効果のリアルタイムプレビューと調整を行います。

VR開発者はStreamV2Vを使用して、VR体験にリアルタイムで動画コンテンツの動的な調整を提供します。

製品特徴

リアルタイム動画から動画への翻訳:無限のフレーム数の動画処理に対応。

ユーザープロンプト:ユーザーは指示を入力して動画翻訳をガイドできます。

特徴量バンクの維持:過去のフレームの中間変換器の特徴量を保存。

拡張自己注意機構(EA):保存されたキーと値を、現在のフレームの自己注意計算に直接連結。

直接特徴量融合(FF):コサイン類似度行列を用いてバンクから類似特徴量を検索し、重み付け和で融合。

高効率:単一のA100 GPU上で20 FPSで動作し、FlowVid、CoDeF、Rerender、TokenFlowと比較して15倍、46倍、108倍、158倍高速。

優れた時間的一貫性:定量的指標とユーザー調査によって確認済み。

使用チュートリアル

ステップ1:StreamV2Vの公式ウェブサイトにアクセスします。

ステップ2:モデルの紹介と機能について読みます。

ステップ3:必要に応じてユーザープロンプトを設定し、動画翻訳の方向性を指示します。

ステップ4:翻訳する動画ソースをアップロードするか、接続します。

ステップ5:StreamV2Vモデルを開始し、リアルタイム動画翻訳を開始します。

ステップ6:翻訳過程の動画出力を観察し、必要に応じてパラメーターを調整します。

ステップ7:翻訳が完了したら、翻訳後の動画コンテンツをダウンロードするか、直接使用します。

おすすめAI製品

Sora

Soraは、大規模データで学習されたテキスト制御型ビデオ生成拡散モデルです。1分間の高解像度ビデオ生成が可能で、幅広い視覚データの種類と解像度に対応します。ビデオと画像の圧縮潜在空間で学習することで、時空間的位置パッチに分解し、スケーラブルなビデオ生成を実現しています。また、三次元の一貫性やインタラクションなど、物理世界とデジタル世界の挙動をある程度シミュレートできる能力を示しており、高性能シミュレータの開発に向けて、ビデオ生成モデルの大規模化が有望であることを示唆しています。

AI動画生成

17.0M

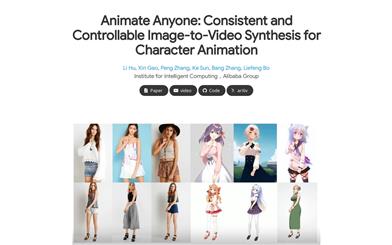

Animate Anyone

Animate Anyoneは、駆動信号から静止画像を基にキャラクタビデオを生成することを目指しています。拡散モデルの力を活用し、キャラクタアニメーション用に特化した新しいフレームワークを提案します。参照画像における複雑な外観特徴の一貫性を維持するため、空間的注意機構を用いて詳細な特徴を統合するReferenceNetを設計しました。制御可能性と連続性を確保するため、キャラクタの動作をガイドする効率的なポーズガイド機構を導入し、ビデオフレーム間の滑らかなクロスフェードを実現する効果的な時間モデリング手法を採用しています。トレーニングデータの拡張により、任意のキャラクタのアニメーション作成が可能になり、他の画像からビデオへの変換手法と比較して、キャラクタアニメーションにおいて優れた結果を得ています。さらに、ファッションビデオと人間のダンス合成のベンチマークにおいて最先端の結果を達成しました。

AI動画生成

11.4M