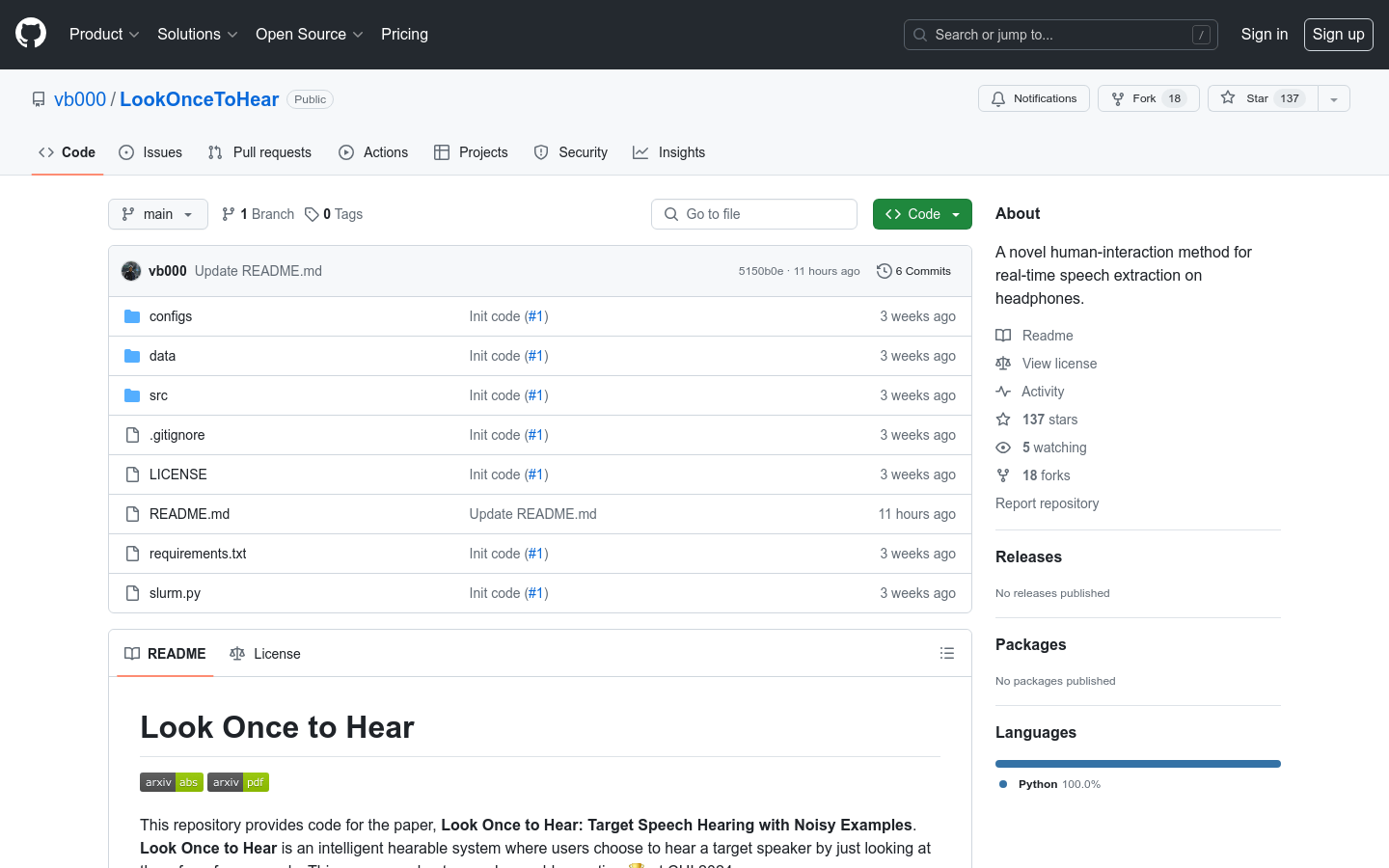

Lookoncetohear

紹介 :

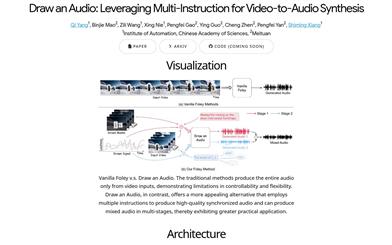

LookOnceToHearは、ユーザーが視覚的な認識だけで聞きたいターゲットスピーカーを選択できる革新的なスマートイヤホンインタラクションシステムです。この技術はCHI 2024でベストペーパーノミネーションを受賞しました。合成オーディオミキシング、頭部伝達関数(HRTFs)、およびバイノーラルルームインパルスレスポンス(BRIRs)を用いてリアルタイム音声抽出を実現し、ユーザーに新しいインタラクション方法を提供します。

ターゲットユーザー :

この製品は、騒音環境下での音声認識と抽出を必要とする研究者や開発者に向いています。例えば、聴覚障害者が騒音環境下で会話をより良く理解したり、多音声環境下で音声分析や処理を行うのに役立ちます。

使用シナリオ

会議で、LookOnceToHearを使用して特定の発話者の音声を聞き取ります。

騒がしい公共の場で、聴覚障害者が会話を集中して聞き取れるように支援します。

音声分析研究で、複数の音源を区別して抽出するために使用します。

製品特徴

ユーザーは、聞きたい音声をターゲットスピーカーの方を数秒間見ることで選択できます。

Scaperツールキットを使用して合成オーディオミックスを生成します。

自己完結型データセットとトレーニング用の.jams仕様ファイルを自由に提供します。

リアルタイム音声抽出とターゲット音声聴力モデルの評価をサポートします。

ユーザーがトレーニングと評価を容易に行えるよう、モデルのチェックポイントを提供しています。

騒音環境下での音声認識と抽出に適しています。

使用チュートリアル

提供された.zipファイルをdata/ディレクトリにダウンロードして解凍します。

コマンドを実行してトレーニングプロセスを開始します。

.jams仕様ファイル上でScaperのgenerate_from_jams関数を使用してオーディオミックスを生成します。

ターゲット音声聴力モデルのチェックポイントをダウンロードしてロードし、評価を行います。

必要に応じてモデルパラメータを調整してパフォーマンスを最適化します。

実際のアプリケーションでは、ユーザーはターゲットスピーカーの方を見るだけで音声抽出を開始できます。