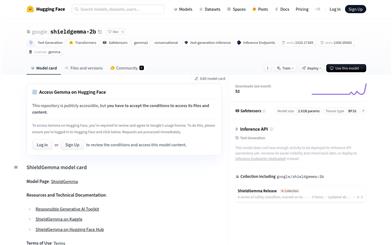

Shieldgemma

简介 :

ShieldGemma是由Google开发的一系列基于Gemma 2构建的安全内容审核模型,专注于四个危害类别(儿童不宜内容、危险内容、仇恨和骚扰)。它们是文本到文本的解码器仅大型语言模型,仅包含英文版本,具有开放权重,包括2B、9B和27B参数大小的模型。这些模型旨在作为负责任的生成AI工具包的一部分,提高AI应用的安全性。

需求人群 :

ShieldGemma模型适用于需要对文本内容进行安全审核的开发者和企业,例如社交媒体平台、在线论坛和内容发布系统。这些模型可以帮助他们过滤掉违反安全政策的内容,提高内容的质量和合规性。

使用场景

社交媒体平台使用ShieldGemma模型自动检测和过滤仇恨言论。

在线教育平台利用该模型确保讨论区的交流健康、积极。

企业内部论坛采用ShieldGemma模型监控和防止职场骚扰。

产品特色

文本到文本的解码器仅大型语言模型,专注于内容审核。

提供三种不同规模的模型:2B、9B和27B参数。

使用特定模式格式化输入,以实现最佳性能。

输出文本字符串,表示用户输入或模型输出是否违反提供的政策。

在公平性特征上进行了安全评估,符合内部指导方针。

作为负责任的生成AI工具包的一部分,用于改善AI应用的安全性。

使用教程

安装必要的库:`pip install -U transformers[accelerate]`。

从Hugging Face导入AutoTokenizer和AutoModelForCausalLM。

使用AutoTokenizer和AutoModelForCausalLM加载ShieldGemma模型。

根据需要格式化提示(prompt),包括前文、用户提示、安全政策描述等。

将格式化后的提示输入模型,并使用模型进行内容审核。

根据模型输出的'Yes'或'No'判断内容是否违反安全政策。

根据需要调整模型参数或提示格式,以优化审核效果。