Shieldgemma

紹介 :

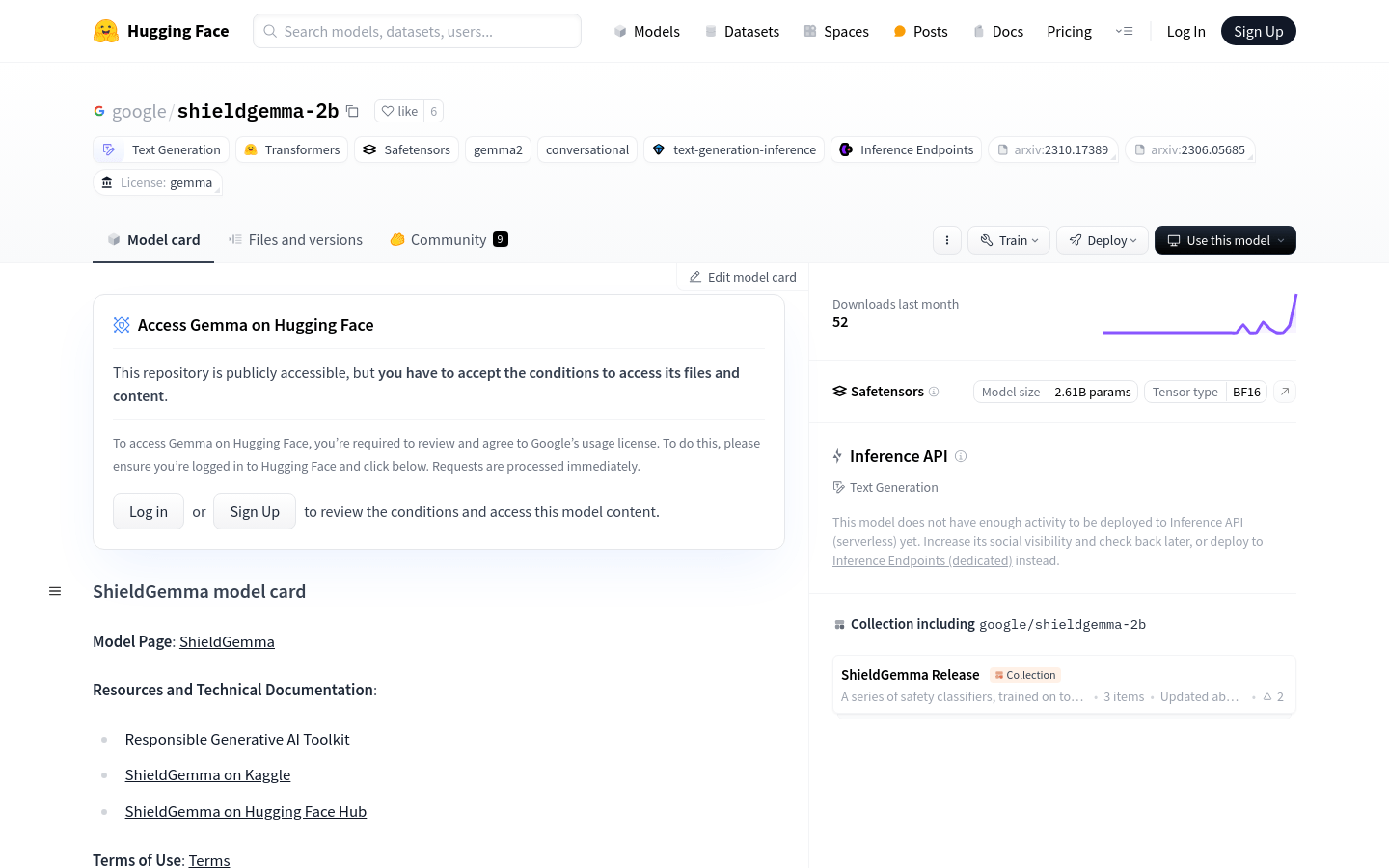

ShieldGemmaは、Googleが開発したGemma 2を基盤とする一連の安全なコンテンツ審査モデルです。児童ポルノ、危険なコンテンツ、ヘイトスピーチ、嫌がらせという4つの有害カテゴリーに焦点を当てています。テキスト入力からテキストを出力するデコーダー専用の巨大言語モデルであり、英語バージョンのみ提供され、重みは公開されています。モデルのパラメータ数は2B、9B、27Bの3種類があります。これらのモデルは、責任ある生成AIツールキットの一部として、AIアプリケーションの安全性を向上させることを目的としています。

ターゲットユーザー :

ShieldGemmaモデルは、ソーシャルメディアプラットフォーム、オンラインフォーラム、コンテンツ公開システムなど、テキストコンテンツの安全審査が必要な開発者や企業に適しています。これらのモデルは、安全ポリシーに違反するコンテンツをフィルタリングし、コンテンツの質とコンプライアンスを向上させるのに役立ちます。

使用シナリオ

ソーシャルメディアプラットフォームで、ShieldGemmaモデルを使用してヘイトスピーチを自動検出?フィルタリングします。

オンライン教育プラットフォームで、このモデルを使用して、ディスカッションフォーラムの健全で積極的な交流を確保します。

企業の社内フォーラムで、ShieldGemmaモデルを使用して、職場での嫌がらせを監視?防止します。

製品特徴

テキスト入力からテキストを出力するデコーダー専用の巨大言語モデルで、コンテンツ審査に特化しています。

2B、9B、27Bパラメータの3種類のモデルサイズを提供しています。

最適なパフォーマンスを得るために、特定のフォーマットで入力を実行します。

ユーザー入力またはモデル出力が提供されたポリシーに違反しているかどうかを示すテキスト文字列を出力します。

公平性の特性について安全評価を実施し、内部ガイドラインに準拠しています。

責任ある生成AIツールキットの一部として、AIアプリケーションのセキュリティ向上に役立ちます。

使用チュートリアル

必要なライブラリのインストール:`pip install -U transformers[accelerate]`。

Hugging FaceからAutoTokenizerとAutoModelForCausalLMをインポートします。

AutoTokenizerとAutoModelForCausalLMを使用してShieldGemmaモデルを読み込みます。

必要に応じて、コンテキスト、ユーザープロンプト、セキュリティポリシーの説明などを含むプロンプトをフォーマットします。

フォーマットされたプロンプトをモデルに入力し、モデルを使用してコンテンツ審査を実行します。

モデルが出力する'Yes'または'No'に基づいて、コンテンツがセキュリティポリシーに違反しているかどうかを判断します。

必要に応じて、モデルパラメータまたはプロンプトフォーマットを調整して、審査効果を最適化します。