Shieldgemma

簡介 :

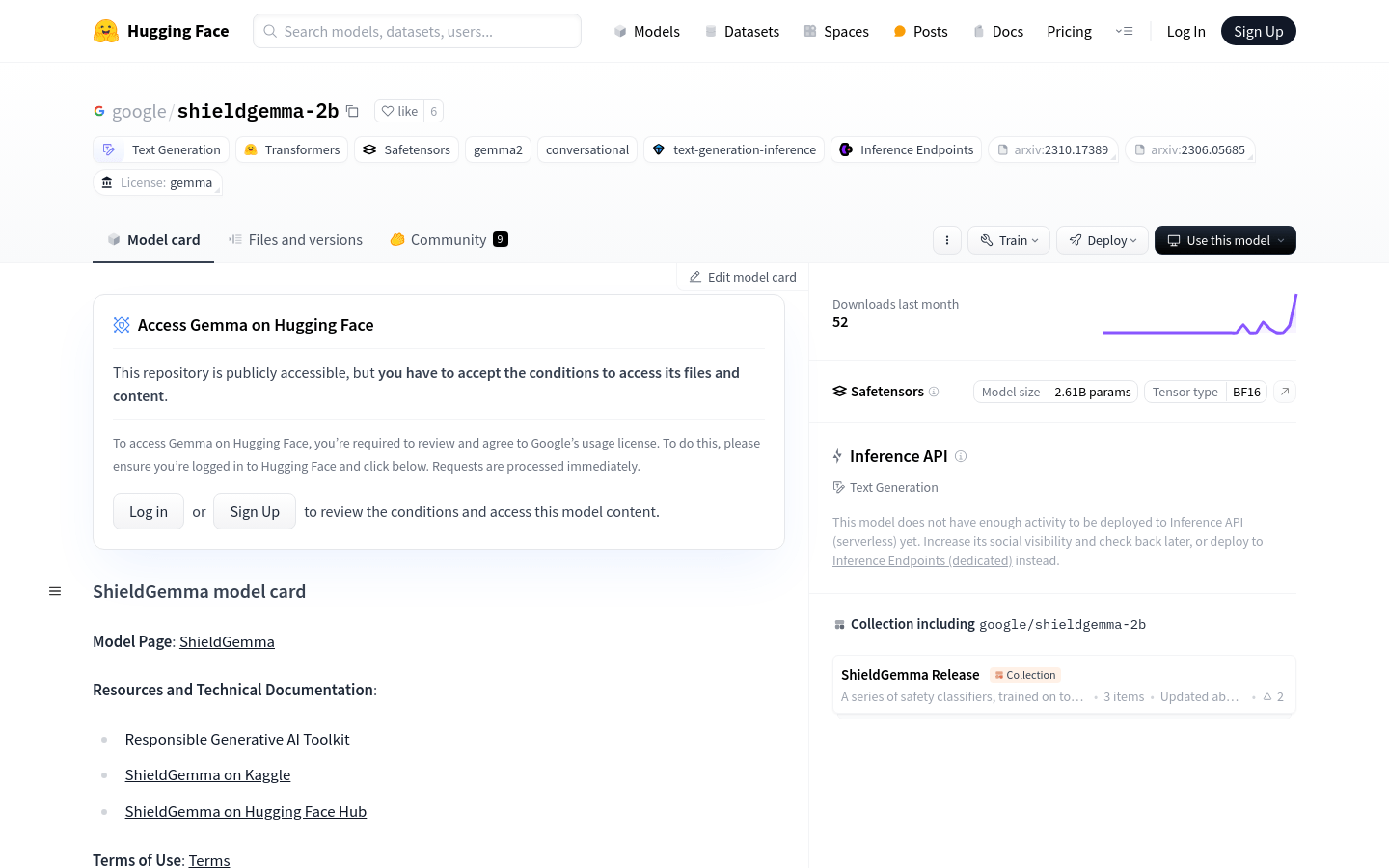

ShieldGemma是由Google開發的一系列基於Gemma 2構建的安全內容審核模型,專注於四個危害類別(兒童不宜內容、危險內容、仇恨和騷擾)。它們是文本到文本的解碼器僅大型語言模型,僅包含英文版本,具有開放權重,包括2B、9B和27B參數大小的模型。這些模型旨在作為負責任的生成AI工具包的一部分,提高AI應用的安全性。

需求人群 :

ShieldGemma模型適用於需要對文本內容進行安全審核的開發者和企業,例如社交媒體平臺、在線論壇和內容發佈系統。這些模型可以幫助他們過濾掉違反安全政策的內容,提高內容的質量和合規性。

使用場景

社交媒體平臺使用ShieldGemma模型自動檢測和過濾仇恨言論。

在線教育平臺利用該模型確保討論區的交流健康、積極。

企業內部論壇採用ShieldGemma模型監控和防止職場騷擾。

產品特色

文本到文本的解碼器僅大型語言模型,專注於內容審核。

提供三種不同規模的模型:2B、9B和27B參數。

使用特定模式格式化輸入,以實現最佳性能。

輸出文本字符串,表示用戶輸入或模型輸出是否違反提供的政策。

在公平性特徵上進行了安全評估,符合內部指導方針。

作為負責任的生成AI工具包的一部分,用於改善AI應用的安全性。

使用教程

安裝必要的庫:`pip install -U transformers[accelerate]`。

從Hugging Face導入AutoTokenizer和AutoModelForCausalLM。

使用AutoTokenizer和AutoModelForCausalLM加載ShieldGemma模型。

根據需要格式化提示(prompt),包括前文、用戶提示、安全政策描述等。

將格式化後的提示輸入模型,並使用模型進行內容審核。

根據模型輸出的'Yes'或'No'判斷內容是否違反安全政策。

根據需要調整模型參數或提示格式,以優化審核效果。