Bunny

简介 :

Bunny 是一系列轻量级但功能强大的多模态模型,提供多种即插即用的视图编码器和语言主干网络。通过从更广泛的数据源进行精选选择,构建更丰富的训练数据,以补偿模型尺寸的减小。Bunny-v1.0-3B 模型在性能上超越了同类大小甚至更大的 MLLMs(7B)模型,并与 13B 模型性能相当。

需求人群 :

["适用于需要进行多模态学习和处理的开发者和研究人员。","适合在资源受限的环境下部署高效的 AI 模型。","为中文和英文环境下的多模态任务提供支持。","适用于希望利用轻量级模型进行图像和语言任务的用户。"]

使用场景

用于图像和文本的联合理解和生成任务。

在聊天机器人中结合图像理解提供更丰富的用户体验。

作为多模态数据处理的后端模型,支持各种智能应用。

产品特色

提供多种视觉编码器选择,如 EVA-CLIP、SigLIP。

支持多种语言主干网络,包括 Llama-3-8B、Phi-1.5 等。

通过精选数据源构建更丰富的训练数据。

Bunny-v1.0-3B 模型在多语言环境下表现优异。

Bunny-Llama-3-8B-V 模型基于 Llama-3,展示出卓越的性能。

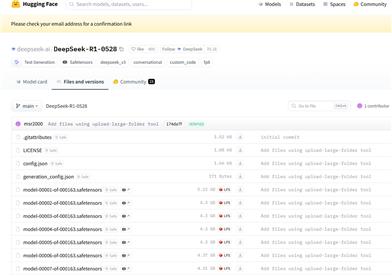

支持在 HuggingFace、ModelScope 和 wisemodel 平台上查找更多细节。

提供了针对中文问答能力的模型,如 Bunny-v1.0-3B-zh 和 Bunny-v1.0-2B-zh。

使用教程

步骤1:访问 Bunny 的 GitHub 页面以获取更多信息。

步骤2:根据需要选择合适的模型版本进行下载。

步骤3:安装必要的依赖,如 torch 和 transformers。

步骤4:使用提供的代码片段或脚本进行模型的预处理和训练。

步骤5:通过 Gradio Web UI 或 CLI 进行模型的交互和推理。

步骤6:根据具体应用场景调整模型参数以获得最佳性能。

精选AI产品推荐

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系统。它能够进行多模态推理,支持文本、图像、视频、音频和代码之间的无缝交互。Gemini在语言理解、推理、数学、编程等多个领域都超越了之前的状态,成为迄今为止最强大的AI系统之一。它有三个不同规模的版本,可满足从边缘计算到云计算的各种需求。Gemini可以广泛应用于创意设计、写作辅助、问题解答、代码生成等领域。

AI模型

11.4M

中文精选

Liblibai

LiblibAI是一个中国领先的AI创作平台,提供强大的AI创作能力,帮助创作者实现创意。平台提供海量免费AI创作模型,用户可以搜索使用模型进行图像、文字、音频等创作。平台还支持用户训练自己的AI模型。平台定位于广大创作者用户,致力于创造条件普惠,服务创意产业,让每个人都享有创作的乐趣。

AI模型

8.0M