GPT 4.1

GPT-4.1 是一系列新模型,提供了顯著的性能提升,特別是在編碼、指令跟隨和處理長文本上下文方面。它的上下文窗口擴大到 100 萬標記,並且在真實世界的應用中表現出色,適合開發者創建更高效的應用程序。此模型的價格相對較低,且具有快速響應能力,使其在開發和執行復雜任務時更加高效。

AI模型

95.5K

Jamba 1.6

Jamba 1.6 是 AI21 推出的最新語言模型,專為企業私有部署而設計。它在長文本處理方面表現出色,能夠處理長達 256K 的上下文窗口,採用混合 SSM-Transformer 架構,可高效準確地處理長文本問答任務。該模型在質量上超越了 Mistral、Meta 和 Cohere 等同類模型,同時支持靈活的部署方式,包括在本地或 VPC 中私有部署,確保數據安全。它為企業提供了一種無需在數據安全和模型質量之間妥協的解決方案,適用於需要處理大量數據和長文本的場景,如研發、法律和金融分析等。目前,Jamba 1.6 已在多個企業中得到應用,如 Fnac 使用其進行數據分類,Educa Edtech 利用其構建個性化聊天機器人等。

AI模型

55.8K

AI21 Jamba Large 1.6

AI21-Jamba-Large-1.6 是由 AI21 Labs 開發的混合 SSM-Transformer 架構基礎模型,專為長文本處理和高效推理而設計。該模型在長文本處理、推理速度和質量方面表現出色,支持多種語言,並具備強大的指令跟隨能力。它適用於需要處理大量文本數據的企業級應用,如金融分析、內容生成等。該模型採用 Jamba Open Model License 授權,允許在許可條款下進行研究和商業使用。

模型訓練與部署

54.9K

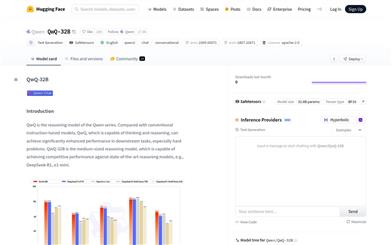

Qwq 32B

QwQ-32B 是 Qwen 系列的推理模型,專注於複雜問題的思考和推理能力。它在下游任務中表現出色,尤其是在解決難題方面。該模型基於 Qwen2.5 架構,經過預訓練和強化學習優化,具有 325 億參數,支持 131072 個完整上下文長度的處理能力。其主要優點包括強大的推理能力、高效的長文本處理能力和靈活的部署選項。該模型適用於需要深度思考和複雜推理的場景,如學術研究、編程輔助和創意寫作等。

AI模型

75.9K

優質新品

Gemini 2.0 Flash Lite

Gemini 2.0 Flash-Lite 是 Google 推出的高效語言模型,專為長文本處理和複雜任務優化。它在推理、多模態、數學和事實性基準測試中表現出色,具備簡化的價格策略,使得百萬級上下文窗口更加經濟實惠。Gemini 2.0 Flash-Lite 已在 Google AI Studio 和 Vertex AI 中全面開放,適合企業級生產使用。

AI模型

55.8K

Moba

MoBA(Mixture of Block Attention)是一種創新的注意力機制,專為長文本上下文的大語言模型設計。它通過將上下文劃分為塊,並讓每個查詢令牌學習關注最相關的塊,從而實現高效的長序列處理。MoBA 的主要優點是能夠在全注意力和稀疏注意力之間無縫切換,既保證了性能,又提高了計算效率。該技術適用於需要處理長文本的任務,如文檔分析、代碼生成等,能夠顯著降低計算成本,同時保持模型的高性能表現。MoBA 的開源實現為研究人員和開發者提供了強大的工具,推動了大語言模型在長文本處理領域的應用。

模型訓練與部署

51.6K

Modernbert Base

ModernBERT-base是一個現代化的雙向編碼器Transformer模型,預訓練於2萬億英文和代碼數據,原生支持長達8192個token的上下文。該模型採用了Rotary Positional Embeddings (RoPE)、Local-Global Alternating Attention和Unpadding等最新架構改進,使其在長文本處理任務中表現出色。ModernBERT-base適用於需要處理長文檔的任務,如檢索、分類和大型語料庫中的語義搜索。模型訓練數據主要為英文和代碼,因此可能在其他語言上的表現會有所降低。

AI模型

52.4K

EXAONE 3.5

EXAONE 3.5是LG AI Research發佈的一系列人工智能模型,這些模型以其卓越的性能和成本效益而著稱。它們在模型訓練效率、去汙染處理、長文本理解和指令遵循能力方面表現出色。EXAONE 3.5模型的開發遵循了LG的AI倫理原則,進行了AI倫理影響評估,以確保模型的負責任使用。這些模型的發佈旨在推動AI研究和生態系統的發展,併為AI創新奠定基礎。

AI模型

46.4K

Aria Base 64K

Aria-Base-64K是Aria系列的基礎模型之一,專為研究目的和繼續訓練而設計。該模型在長文本預訓練階段後形成,經過33B個token(21B多模態,12B語言,69%為長文本)的訓練。它適合於長視頻問答數據集或長文檔問答數據集的繼續預訓練或微調,即使在資源有限的情況下,也可以通過短指令調優數據集進行後訓練,並轉移到長文本問答場景。該模型能夠理解多達250張高分辨率圖像或多達500張中等分辨率圖像,並在語言和多模態場景中保持強大的基礎性能。

AI模型

43.6K

Qwen2.5 Coder 0.5B Instruct GGUF

Qwen2.5-Coder是Qwen大型語言模型的最新系列,專注於代碼生成、代碼推理和代碼修復。基於強大的Qwen2.5,Qwen2.5-Coder-32B已成為當前最先進的開源代碼語言模型,其編碼能力與GPT-4o相匹配。該模型在實際應用中,如代碼代理等,提供了更全面的基礎,不僅增強了編碼能力,還保持了在數學和通用能力方面的優勢。

代碼推理

43.9K

中文精選

Qwen2.5 Turbo

Qwen2.5-Turbo是阿里巴巴開發團隊推出的一款能夠處理超長文本的語言模型,它在Qwen2.5的基礎上進行了優化,支持長達1M個token的上下文,相當於約100萬英文單詞或150萬中文字符。該模型在1M-token Passkey Retrieval任務中實現了100%的準確率,並在RULER長文本評估基準測試中得分93.1,超越了GPT-4和GLM4-9B-1M。Qwen2.5-Turbo不僅在長文本處理上表現出色,還保持了短文本處理的高性能,且成本效益高,每1M個token的處理成本僅為0.3元。

高性能

56.3K

Qwen2.5 Coder 3B Instruct GPTQ Int4

Qwen2.5-Coder是Qwen大型語言模型的最新系列,專為代碼生成、推理和修復而設計。該模型基於Qwen2.5,擴展了訓練令牌至5.5萬億,包括源代碼、文本代碼基礎、合成數據等。Qwen2.5-Coder-32B是目前開源代碼LLM中的佼佼者,其編碼能力與GPT-4o相匹配。此模型為GPTQ-量化的4位指令調優3B參數Qwen2.5-Coder模型,具有因果語言模型、預訓練和後訓練階段、transformers架構等特點。

代碼推理

47.5K

Qwen2.5 Coder 32B Instruct GPTQ Int8

Qwen2.5-Coder-32B-Instruct-GPTQ-Int8是Qwen系列中針對代碼生成優化的大型語言模型,擁有32億參數,支持長文本處理,是當前開源代碼生成領域最先進的模型之一。該模型基於Qwen2.5進行了進一步的訓練和優化,不僅在代碼生成、推理和修復方面有顯著提升,而且在數學和通用能力上也保持了優勢。模型採用GPTQ 8-bit量化技術,以減少模型大小並提高運行效率。

長文本處理

51.1K

Qwen2.5 Coder 32B Instruct GPTQ Int4

Qwen2.5-Coder-32B-Instruct-GPTQ-Int4是基於Qwen2.5的代碼生成大型語言模型,具有32.5億參數量,支持長文本處理,最大支持128K tokens。該模型在代碼生成、代碼推理和代碼修復方面有顯著提升,是當前開源代碼語言模型中的佼佼者。它不僅增強了編碼能力,還保持了在數學和通用能力方面的優勢。

代碼推理

46.9K

Qwen2.5 Coder 32B Instruct AWQ

Qwen2.5-Coder是一系列針對代碼生成優化的大型語言模型,覆蓋了0.5、1.5、3、7、14、32億參數的六種主流模型尺寸,以滿足不同開發者的需求。Qwen2.5-Coder在代碼生成、代碼推理和代碼修復方面有顯著提升,基於強大的Qwen2.5,訓練令牌擴展到5.5萬億,包括源代碼、文本代碼接地、合成數據等,成為當前最先進的開源代碼LLM,其編碼能力與GPT-4o相匹配。此外,Qwen2.5-Coder還提供了更全面的基礎,適用於現實世界中的代碼代理等應用場景。

代碼推理

48.3K

Qwen2.5 Coder 32B

Qwen2.5-Coder-32B是基於Qwen2.5的代碼生成模型,擁有32億參數,是目前開源代碼語言模型中參數最多的模型之一。它在代碼生成、代碼推理和代碼修復方面有顯著提升,能夠處理長達128K tokens的長文本,適用於代碼代理等實際應用場景。該模型在數學和通用能力上也保持了優勢,支持長文本處理,是開發者在進行代碼開發時的強大助手。

代碼助手

44.2K

Mistral Small Instruct 2409

Mistral-Small-Instruct-2409是由Mistral AI Team開發的一個具有22B參數的指令式微調AI模型,支持多種語言,並能夠支持高達128k的序列長度。該模型特別適用於需要長文本處理和複雜指令理解的場景,如自然語言處理、機器學習等領域。

AI模型

48.3K

Reader LM

Reader-LM是Jina AI開發的小型語言模型,旨在將網絡中的原始、雜亂的HTML內容轉換為清潔的Markdown格式。這些模型特別針對長文本處理進行了優化,支持多語言,並能夠處理高達256K令牌的上下文長度。Reader-LM模型通過直接從HTML到Markdown的轉換,減少了對正則表達式和啟發式規則的依賴,提高了轉換的準確性和效率。

AI文本轉語音

54.9K

優質新品

AI21 Jamba 1.5 Mini

AI21-Jamba-1.5-Mini是AI21實驗室開發的最新一代混合SSM-Transformer指令跟隨基礎模型。這款模型以其卓越的長文本處理能力、速度和質量在市場上脫穎而出,相較於同類大小的領先模型,推理速度提升高達2.5倍。Jamba 1.5 Mini和Jamba 1.5 Large專為商業用例和功能進行了優化,如函數調用、結構化輸出(JSON)和基礎生成。

AI模型

46.9K

國外精選

Jamba 1.5 Open Model Family

Jamba 1.5 Open Model Family是AI21公司推出的最新AI模型系列,基於SSM-Transformer架構,具有超長文本處理能力、高速度和高質量,是市場上同類產品中表現最優的。這些模型專為企業級應用設計,考慮了資源效率、質量、速度和解決關鍵任務的能力。

AI模型

50.5K

Internlm XComposer2.5

InternLM-XComposer2.5是一款專注於文本圖像理解與合成應用的大型語言模型,具有7B參數的後端支持,能夠處理長達96K的長文本上下文,適合需要廣泛輸入輸出的複雜任務。

AI模型

53.3K

Internlm2.5 7B Chat 1M

InternLM2.5-7B-Chat-1M 是一個開源的70億參數的對話模型,具有卓越的推理能力,在數學推理方面超越了同量級模型。該模型支持1M超長上下文窗口,能夠處理長文本任務,如LongBench等。此外,它還具備強大的工具調用能力,能夠從上百個網頁蒐集信息進行分析推理。

AI模型

55.2K

Internlm2.5 7B Chat

InternLM2.5-7B-Chat是一個開源的7億參數的中文對話模型,專為實用場景設計,具有卓越的推理能力,在數學推理方面超越了Llama3和Gemma2-9B等模型。支持從上百個網頁蒐集信息進行分析推理,具有強大的工具調用能力,支持1M超長上下文窗口,適合進行長文本處理和複雜任務的智能體構建。

AI聊天機器人

55.8K

Qwen2

Qwen2是一系列經過預訓練和指令調整的模型,支持多達27種語言,包括英語和中文。這些模型在多個基準測試中表現出色,特別是在編碼和數學方面有顯著提升。Qwen2模型的上下文長度支持高達128K個token,適用於處理長文本任務。此外,Qwen2-72B-Instruct模型在安全性方面與GPT-4相當,顯著優於Mistral-8x22B模型。

AI模型

153.7K

優質新品

GLM 4 9B Chat 1M

GLM-4-9B-Chat-1M 是智譜 AI 推出的新一代預訓練模型,屬於 GLM-4 系列的開源版本。它在語義、數學、推理、代碼和知識等多方面的數據集測評中展現出較高的性能。該模型不僅支持多輪對話,還具備網頁瀏覽、代碼執行、自定義工具調用和長文本推理等高級功能。支持包括日語、韓語、德語在內的26種語言,並特別推出了支持1M上下文長度的模型版本,適合需要處理大量數據和多語言環境的開發者和研究人員使用。

AI模型

59.3K

優質新品

GLM 4 9B Chat

GLM-4-9B-Chat是智譜AI推出的新一代預訓練模型GLM-4系列中的開源版本,具備多輪對話、網頁瀏覽、代碼執行、自定義工具調用和長文本推理等高級功能。支持包括日語、韓語、德語在內的26種語言,並且推出了支持1M上下文長度的模型。

AI模型

62.4K

Llama 3 70B Gradient 524K Adapter

Llama-3 70B Gradient 524K Adapter是一個基於Llama-3 70B模型的適配器,由Gradient AI Team開發,旨在通過LoRA技術擴展模型的上下文長度至524K,從而提升模型在處理長文本數據時的性能。該模型使用了先進的訓練技術,包括NTK-aware插值和RingAttention庫,以高效地在高性能計算集群上進行訓練。

AI模型

46.4K

Llama 3 70B Instruct Gradient 1048k

Llama-3 70B Instruct Gradient 1048k是一款由Gradient AI團隊開發的先進語言模型,它通過擴展上下文長度至超過1048K,展示了SOTA(State of the Art)語言模型在經過適當調整後能夠學習處理長文本的能力。該模型使用了NTK-aware插值和RingAttention技術,以及EasyContext Blockwise RingAttention庫,以高效地在高性能計算集群上進行訓練。它在商業和研究用途中具有廣泛的應用潛力,尤其是在需要長文本處理和生成的場景中。

AI模型

53.8K

Unichat Llama3 Chinese

Unichat-llama3-Chinese是中國聯通AI創新中心發佈的業界首個基於Meta Llama 3模型的中文指令微調模型。該模型通過增加中文數據進行訓練,實現了高質量的中文問答功能,支持長達28K的上下文輸入,並計劃發佈支持長度64K的版本。模型的微調指令數據經過人工篩查,確保了數據的高質量。此外,該模型還計劃陸續發佈700億參數的中文微調版本,包括長文本版本和加入中文二次預訓練的版本。

AI聊天機器人

60.7K

Llama 3 8B Instruct 262k

Llama-3 8B Instruct 262k是一款由Gradient AI團隊開發的文本生成模型,它擴展了LLama-3 8B的上下文長度至超過160K,展示了SOTA(State of the Art)大型語言模型在學習長文本操作時的潛力。該模型通過適當的調整RoPE theta參數,並結合NTK-aware插值和數據驅動的優化技術,實現了在長文本上的高效學習。此外,它還基於EasyContext Blockwise RingAttention庫構建,以支持在高性能硬件上的可擴展和高效訓練。

AI模型

55.5K

精選AI產品推薦

中文精選

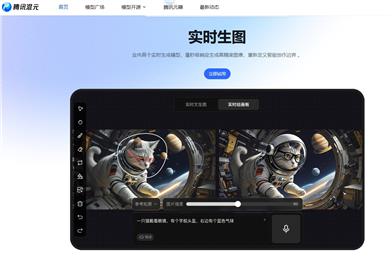

騰訊混元圖像 2.0

騰訊混元圖像 2.0 是騰訊最新發布的 AI 圖像生成模型,顯著提升了生成速度和畫質。通過超高壓縮倍率的編解碼器和全新擴散架構,使得圖像生成速度可達到毫秒級,避免了傳統生成的等待時間。同時,模型通過強化學習算法與人類美學知識的結合,提升了圖像的真實感和細節表現,適合設計師、創作者等專業用戶使用。

圖片生成

80.6K

國外精選

Lovart

Lovart 是一款革命性的 AI 設計代理,能夠將創意提示轉化為藝術作品,支持從故事板到品牌視覺的多種設計需求。其重要性在於打破傳統設計流程,節省時間並提升創意靈感。Lovart 當前處於測試階段,用戶可加入等候名單,隨時體驗設計的樂趣。

AI設計工具

63.8K

Fastvlm

FastVLM 是一種高效的視覺編碼模型,專為視覺語言模型設計。它通過創新的 FastViTHD 混合視覺編碼器,減少了高分辨率圖像的編碼時間和輸出的 token 數量,使得模型在速度和精度上表現出色。FastVLM 的主要定位是為開發者提供強大的視覺語言處理能力,適用於各種應用場景,尤其在需要快速響應的移動設備上表現優異。

AI模型

51.1K

Keysync

KeySync 是一個針對高分辨率視頻的無洩漏唇同步框架。它解決了傳統唇同步技術中的時間一致性問題,同時通過巧妙的遮罩策略處理表情洩漏和麵部遮擋。KeySync 的優越性體現在其在唇重建和跨同步方面的先進成果,適用於自動配音等實際應用場景。

視頻編輯

48.3K

Manus

Manus 是由 Monica.im 研發的全球首款真正自主的 AI 代理產品,能夠直接交付完整的任務成果,而不僅僅是提供建議或答案。它採用 Multiple Agent 架構,運行在獨立虛擬機中,能夠通過編寫和執行代碼、瀏覽網頁、操作應用等方式直接完成任務。Manus 在 GAIA 基準測試中取得了 SOTA 表現,展現了強大的任務執行能力。其目標是成為用戶在數字世界的‘代理人’,幫助用戶高效完成各種複雜任務。

個人助理

1.5M

Trae國內版

Trae是一款專為中文開發場景設計的AI原生IDE,將AI技術深度集成於開發環境中。它通過智能代碼補全、上下文理解等功能,顯著提升開發效率和代碼質量。Trae的出現填補了國內AI集成開發工具的空白,滿足了中文開發者對高效開發工具的需求。其定位為高端開發工具,旨在為專業開發者提供強大的技術支持,目前尚未明確公開價格,但預計會採用付費模式以匹配其高端定位。

開發與工具

137.7K

國外精選

Pika

Pika是一個視頻製作平臺,用戶可以上傳自己的創意想法,Pika會自動生成相關的視頻。主要功能有:支持多種創意想法轉視頻,視頻效果專業,操作簡單易用。平臺採用免費試用模式,定位面向創意者和視頻愛好者。

視頻生成

18.7M

中文精選

Liblibai

LiblibAI是一箇中國領先的AI創作平臺,提供強大的AI創作能力,幫助創作者實現創意。平臺提供海量免費AI創作模型,用戶可以搜索使用模型進行圖像、文字、音頻等創作。平臺還支持用戶訓練自己的AI模型。平臺定位於廣大創作者用戶,致力於創造條件普惠,服務創意產業,讓每個人都享有創作的樂趣。

AI模型

8.0M