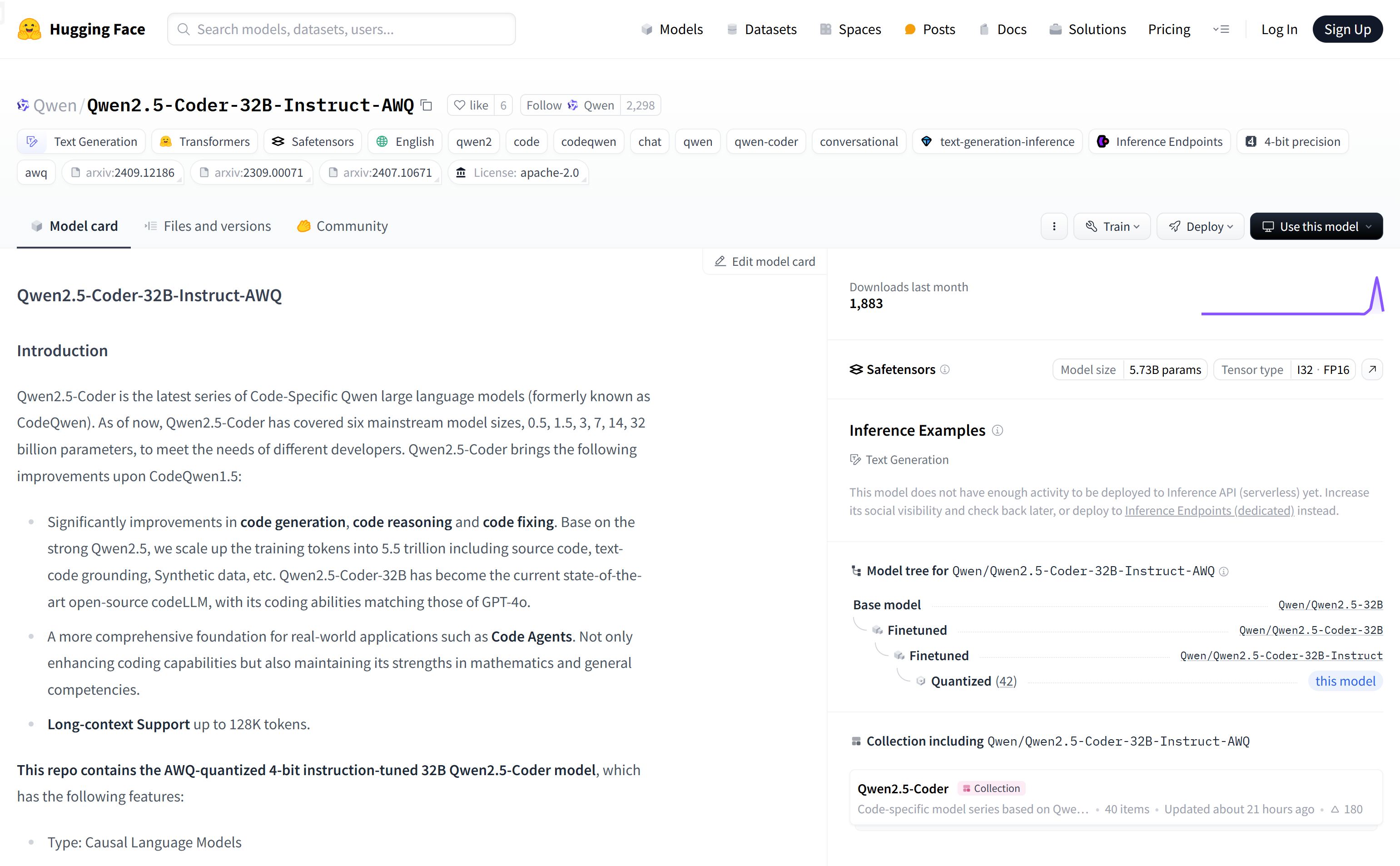

Qwen2.5 Coder 32B Instruct AWQ

簡介 :

Qwen2.5-Coder是一系列針對代碼生成優化的大型語言模型,覆蓋了0.5、1.5、3、7、14、32億參數的六種主流模型尺寸,以滿足不同開發者的需求。Qwen2.5-Coder在代碼生成、代碼推理和代碼修復方面有顯著提升,基於強大的Qwen2.5,訓練令牌擴展到5.5萬億,包括源代碼、文本代碼接地、合成數據等,成為當前最先進的開源代碼LLM,其編碼能力與GPT-4o相匹配。此外,Qwen2.5-Coder還提供了更全面的基礎,適用於現實世界中的代碼代理等應用場景。

需求人群 :

Qwen2.5-Coder-32B-Instruct-AWQ的目標受眾是開發者和編程愛好者,特別是那些需要處理大量代碼和長文本的專業人士。該模型的代碼生成、推理和修復能力可以幫助他們提高開發效率,優化代碼質量,並且長文本支持使得它在處理大型項目時更加得心應手。

使用場景

開發者使用Qwen2.5-Coder生成快速排序算法的代碼。

軟件工程師利用模型修復現有代碼中的錯誤。

研究人員使用模型進行大規模代碼分析和研究。

產品特色

代碼生成:顯著提升代碼生成能力,匹配GPT-4o的編碼能力。

代碼推理:增強代碼理解能力,幫助開發者更好地理解和優化代碼。

代碼修復:輔助開發者發現並修復代碼中的錯誤。

長文本支持:支持長達128K令牌的長文本處理。

AWQ量化:使用AWQ 4-bit量化技術,優化模型性能和效率。

多參數配置:包含64層、40個查詢頭和8個KV頭的複雜配置。

開源:作為開源模型,可供開發者自由使用和貢獻。

高性能:在處理長文本和代碼生成任務時展現出高性能。

使用教程

1. 訪問Hugging Face網站並搜索Qwen2.5-Coder-32B-Instruct-AWQ模型。

2. 根據頁面提供的代碼片段,導入必要的庫和模塊。

3. 加載模型和分詞器,使用AutoModelForCausalLM和AutoTokenizer.from_pretrained方法。

4. 準備輸入提示,例如編寫一個算法的需求。

5. 使用tokenizer.apply_chat_template方法處理輸入消息,並生成模型輸入。

6. 調用model.generate方法生成代碼。

7. 使用tokenizer.batch_decode方法將生成的代碼ID轉換為文本形式。

8. 分析和測試生成的代碼,確保其符合預期的功能和質量。

精選AI產品推薦

中文精選

抖音即創

即創工作臺是一個一站式的智能創意生產與管理平臺。它集成了視頻創作、圖文創作、直播創作等多種創意工具,可以通過AI的力量大大提高創作效率。主要功能和優勢包括:1)視頻創作:內置多種AI視頻創作工具,支持智能編劇、數字人物、一鍵成片等,可快速生成高質量視頻內容;2)圖文創作:提供智能圖文和商品圖片生成工具,可快速製作微信文章、產品詳情等圖文內容;3)直播創作:支持AI直播背景、直播文案等創作工具,可輕鬆製作抖音、快手等直播內容。定位為新創和創意從業者的創意助手,以合理價格提供創意生產全流程服務。

AI設計工具

106.5M

國外精選

Pika

Pika是一個視頻製作平臺,用戶可以上傳自己的創意想法,Pika會自動生成相關的視頻。主要功能有:支持多種創意想法轉視頻,視頻效果專業,操作簡單易用。平臺採用免費試用模式,定位面向創意者和視頻愛好者。

視頻生成

18.7M