MILS

簡介 :

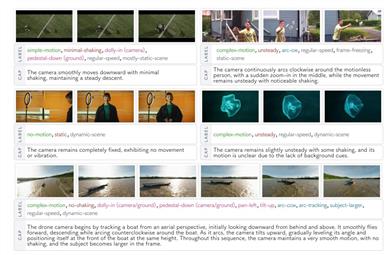

MILS是一個由Facebook Research發佈的開源項目,旨在展示大型語言模型(LLMs)在未經過任何訓練的情況下,能夠處理視覺和聽覺任務的能力。該技術通過利用預訓練的模型和優化算法,實現了對圖像、音頻和視頻的自動描述生成。這一技術突破為多模態人工智能的發展提供了新的思路,展示了LLMs在跨模態任務中的潛力。該模型主要面向研究人員和開發者,為他們提供了一個強大的工具來探索多模態應用。目前該項目是免費開源的,旨在推動學術研究和技術發展。

需求人群 :

該產品主要面向人工智能研究人員、開發者以及對多模態生成任務感興趣的專業人士。它為研究人員提供了一個強大的工具來探索和開發新的多模態應用,同時也為開發者提供了可以直接使用的代碼和模型,幫助他們快速實現相關功能。

使用場景

使用MILS為MS-COCO數據集中的圖像生成描述

為Clotho數據集中的音頻生成描述

為MSR-VTT數據集中的視頻生成描述

產品特色

支持圖像、音頻和視頻的自動描述生成

利用預訓練模型優化跨模態任務性能

提供多種任務的示例代碼,包括圖像、音頻和視頻描述

支持多GPU並行處理,提升生成效率

提供詳細的安裝和使用指南,易於上手

使用教程

1. 安裝所需的依賴環境,運行`conda env create -f environment.yml`並激活環境

2. 下載所需的圖像、音頻和視頻數據集,並解壓到指定目錄

3. 更新`paths.py`文件中的路徑,設置數據集和輸出目錄

4. 根據任務選擇對應的腳本運行,例如運行圖像描述生成腳本`main_image_captioning.py`

5. 使用評估腳本計算生成結果的性能指標,如BLEU、METEOR等

精選AI產品推薦

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系統。它能夠進行多模態推理,支持文本、圖像、視頻、音頻和代碼之間的無縫交互。Gemini在語言理解、推理、數學、編程等多個領域都超越了之前的狀態,成為迄今為止最強大的AI系統之一。它有三個不同規模的版本,可滿足從邊緣計算到雲計算的各種需求。Gemini可以廣泛應用於創意設計、寫作輔助、問題解答、代碼生成等領域。

AI模型

11.4M

中文精選

Liblibai

LiblibAI是一箇中國領先的AI創作平臺,提供強大的AI創作能力,幫助創作者實現創意。平臺提供海量免費AI創作模型,用戶可以搜索使用模型進行圖像、文字、音頻等創作。平臺還支持用戶訓練自己的AI模型。平臺定位於廣大創作者用戶,致力於創造條件普惠,服務創意產業,讓每個人都享有創作的樂趣。

AI模型

8.0M