Deepseek V3

簡介 :

DeepSeek-V3是一個強大的Mixture-of-Experts (MoE) 語言模型,擁有671B的總參數量,每次激活37B參數。它採用了Multi-head Latent Attention (MLA) 和 DeepSeekMoE架構,這些架構在DeepSeek-V2中得到了充分的驗證。此外,DeepSeek-V3首次採用了無輔助損失的負載均衡策略,並設置了多令牌預測訓練目標,以實現更強大的性能。DeepSeek-V3在14.8萬億高質量令牌上進行了預訓練,隨後進行了監督式微調和強化學習階段,以充分利用其能力。綜合評估顯示,DeepSeek-V3超越了其他開源模型,並達到了與領先的閉源模型相當的性能。儘管性能出色,DeepSeek-V3的完整訓練僅需要2.788M H800 GPU小時,並且訓練過程非常穩定。

需求人群 :

DeepSeek-V3的目標受眾是研究人員、開發者和企業,他們需要一個高效、低成本且性能強大的語言模型來處理大規模的自然語言處理任務。由於其出色的性能和成本效益,它特別適合於需要處理大量數據和複雜任務的場景,如機器翻譯、文本摘要、問答系統等。

使用場景

在金融領域,DeepSeek-V3可以用於分析大量的財經新聞和報告,提取關鍵信息。

在醫療行業,模型能夠理解和分析醫學文獻,輔助藥物研發和病例研究。

在教育領域,DeepSeek-V3可以作為輔助工具,幫助學生和研究人員快速獲取學術資料和解答覆雜問題。

產品特色

採用Multi-head Latent Attention (MLA) 和 DeepSeekMoE架構,提高模型效率。

無輔助損失的負載均衡策略,減少性能退化。

多令牌預測訓練目標,增強模型性能並加速推理。

FP8混合精度訓練框架,降低訓練成本。

從DeepSeek R1系列模型中提取推理能力的創新方法,提升推理性能。

在HuggingFace平臺上提供685B大小的模型下載,包括671B主模型權重和14B多令牌預測模塊權重。

支持在NVIDIA和AMD GPU上進行FP8和BF16精度的推理。

使用教程

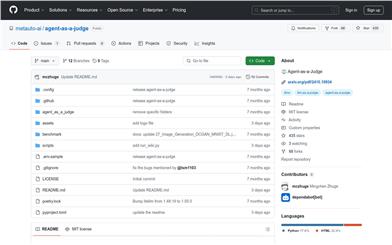

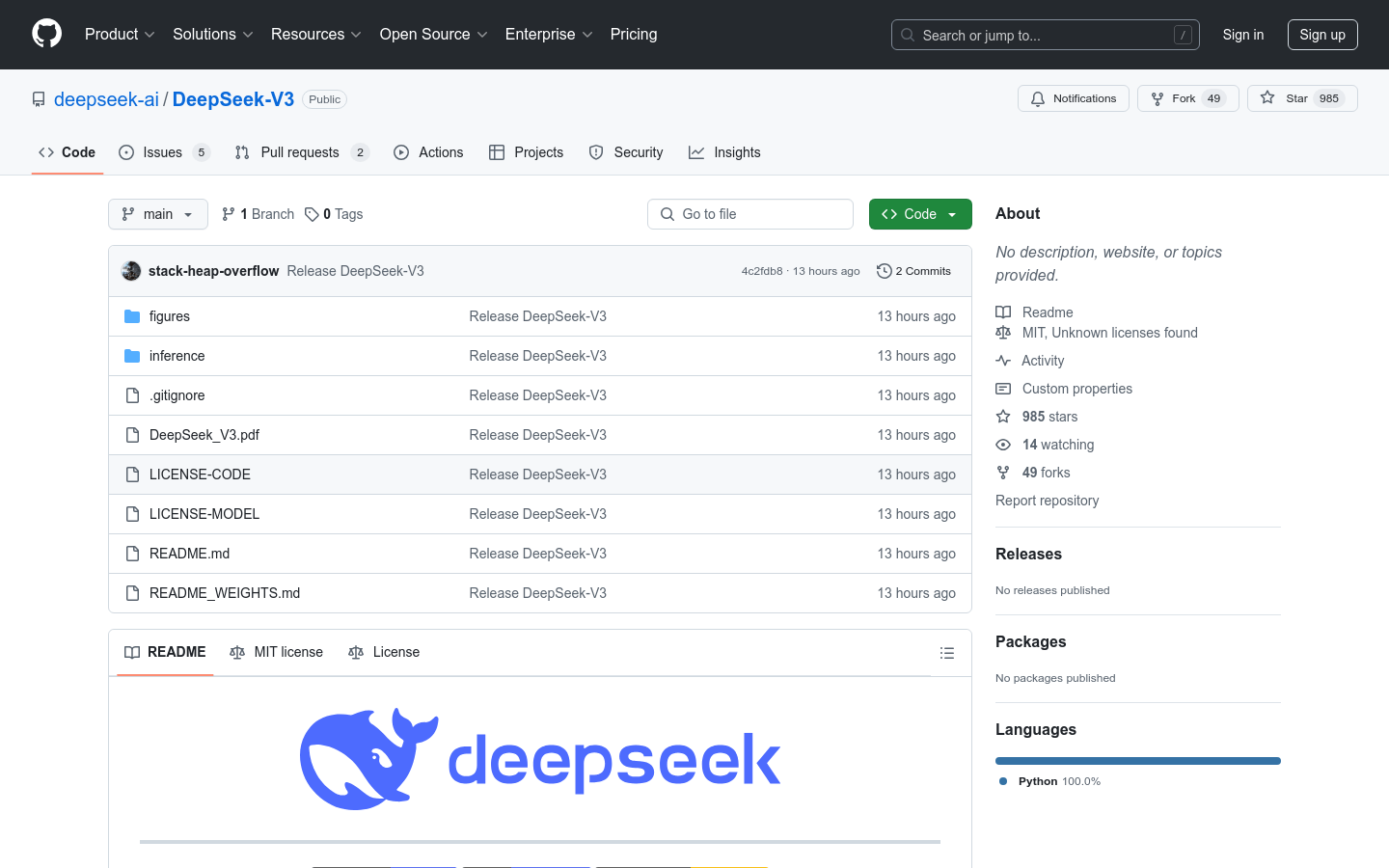

1. 克隆DeepSeek-V3的GitHub倉庫。

2. 進入`inference`目錄並安裝`requirements.txt`中列出的依賴。

3. 從HuggingFace下載模型權重,並放入指定的文件夾。

4. 使用提供的腳本將FP8權重轉換為BF16(如果需要)。

5. 根據提供的配置文件和權重路徑,運行推理腳本與DeepSeek-V3進行交互或批量推理。

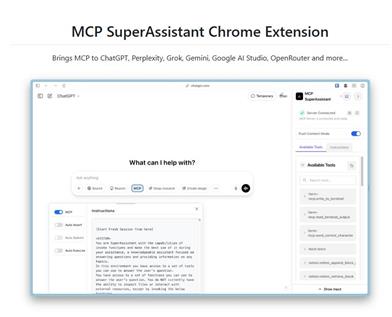

6. 也可以通過DeepSeek的官方網站或API平臺與DeepSeek-V3進行交互。

精選AI產品推薦

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系統。它能夠進行多模態推理,支持文本、圖像、視頻、音頻和代碼之間的無縫交互。Gemini在語言理解、推理、數學、編程等多個領域都超越了之前的狀態,成為迄今為止最強大的AI系統之一。它有三個不同規模的版本,可滿足從邊緣計算到雲計算的各種需求。Gemini可以廣泛應用於創意設計、寫作輔助、問題解答、代碼生成等領域。

AI模型

11.4M

中文精選

Liblibai

LiblibAI是一箇中國領先的AI創作平臺,提供強大的AI創作能力,幫助創作者實現創意。平臺提供海量免費AI創作模型,用戶可以搜索使用模型進行圖像、文字、音頻等創作。平臺還支持用戶訓練自己的AI模型。平臺定位於廣大創作者用戶,致力於創造條件普惠,服務創意產業,讓每個人都享有創作的樂趣。

AI模型

8.0M