使用場景

使用API調用LLM的示例工作流

使用本地模型的示例工作流

使用ollama管理本地模型的示例工作流

知識庫RAG搜索的示例工作流

代碼解釋器的調用示例

產品特色

支持多種API調用和本地大型模型集成

模塊化實現工具調用

支持角色設置和快速構建個人AI助手

支持行業特定詞向量RAG和GraphRAG,實現行業知識庫管理

支持從單一代理流程到複雜代理間輻射和環形互動模式的構建

支持訪問個人社交APP(QQ、飛書、Discord)所需的接口

支持流媒體工作者所需的一站式LLM + TTS + ComfyUI工作流

支持普通學生所需的第一個LLM應用的簡單啟動

支持科研人員常用的各種參數調試接口和模型適配

使用教程

將工作流拖入ComfyUI中,然後使用ComfyUI-Manager安裝缺失的節點

使用API調用LLM:start_with_LLM_api

使用ollama管理本地LLM:start_with_Ollama

使用本地分佈式格式LLM:start_with_LLM_local

使用本地GGUF格式LLM:start_with_LLM_GGUF

使用本地分佈式格式VLM:start_with_VLM_local

使用本地GGUF格式VLM:start_with_VLM_GGUF

如果是使用API,請在API LLM加載節點中填寫你的base_url(可以是中繼API,請確保以/v1/結尾)和api_key

精選AI產品推薦

中文精選

剪映dreamina

剪映Dreamina是抖音旗下的AIGC工具,用戶可以根據文本內容生成由AI生成的創意圖,支持修整圖片大小比例和模板類型。未來會用於抖音的圖文或短視頻的內容創作,豐富抖音在AI創造方面的內容庫。

AI圖像生成

9.1M

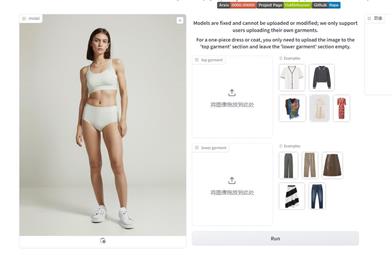

Outfit Anyone

Outfit Anyone 是一款超高質量虛擬試穿產品,使用戶能夠在不真實試穿衣物的情況下嘗試不同的時尚款式。通過採用兩個流的條件擴散模型,Outfit Anyone 能夠靈活處理衣物變形,生成更逼真的效果。它具備可擴展性,可以調整姿勢和身體形狀等因素,適用於動漫角色到真實人物的圖像。Outfit Anyone 在各種場景下的表現突出了其實用性和準備好投入實際應用的程度。

AI圖像生成

5.7M