使用場景

利用Lumina-Next-SFT模型生成與文本描述匹配的圖像。

使用Lumina-T2Music模型創作與歌詞同步的音樂。

通過mGPT-7B系列模型自動生成文章或故事。

產品特色

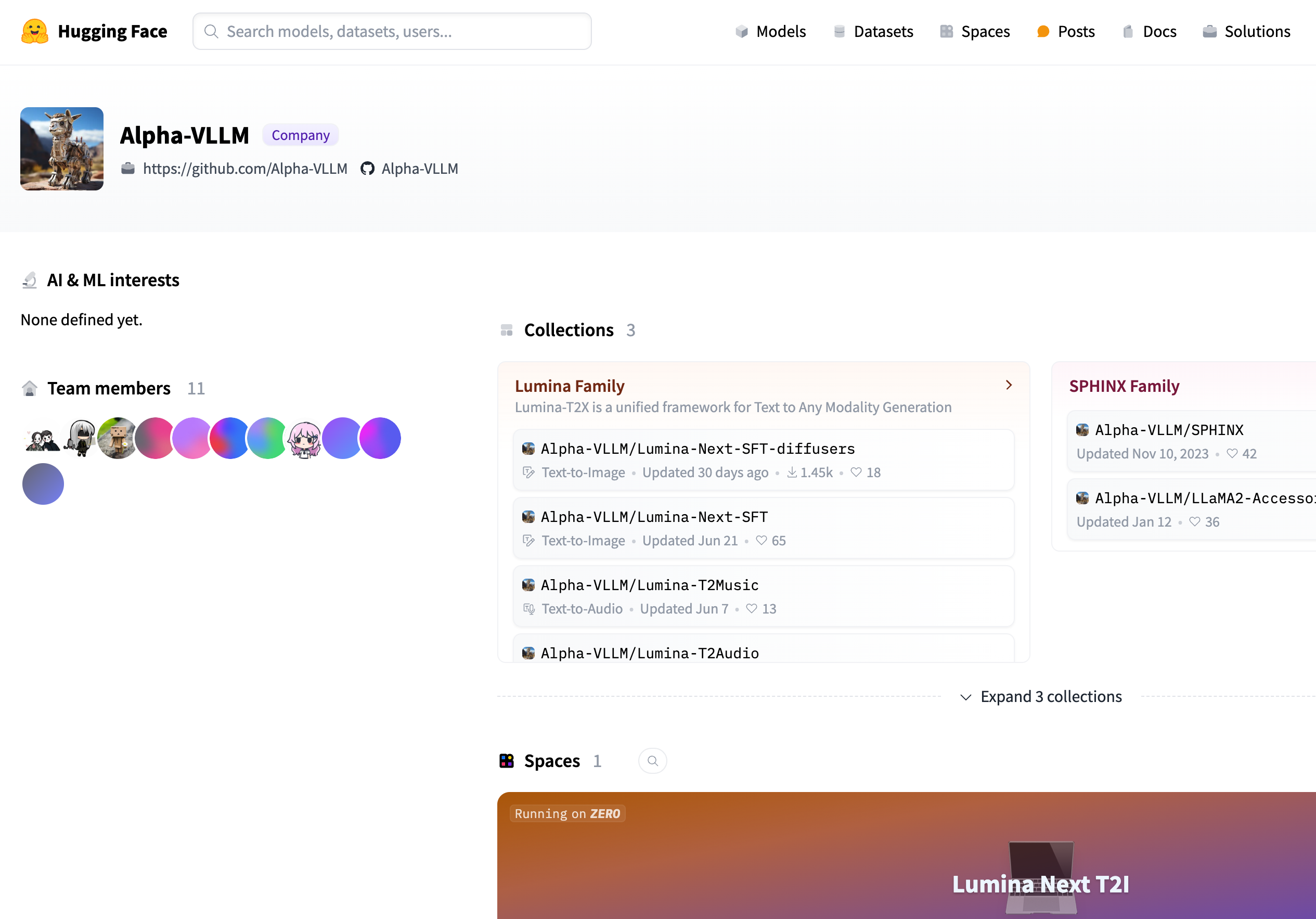

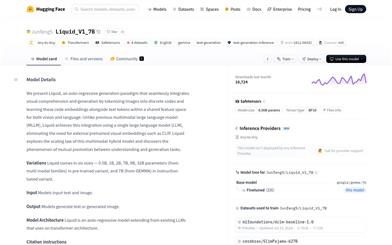

文本到圖像生成:Lumina Family系列模型支持將文本描述轉換為圖像。

文本到音頻生成:Lumina-T2Music模型能夠將文本轉換為音頻內容。

文本到文本生成:mGPT-7B系列模型支持文本內容的生成和編輯。

多模態框架:提供統一的框架,支持不同模態內容的生成。

模型更新:模型定期更新,以保持技術領先和適應性。

社區支持:作為開源項目,擁有活躍的社區和貢獻者。

使用教程

步驟1:訪問Alpha-VLLM的GitHub頁面,瞭解可用模型和文檔。

步驟2:選擇適合需求的模型,例如文本到圖像或文本到音頻。

步驟3:根據模型文檔設置開發環境,安裝必要的依賴。

步驟4:下載並加載選定的模型到本地或雲服務器。

步驟5:編寫代碼以輸入文本並接收模型生成的輸出。

步驟6:測試和調整模型參數以優化生成內容的質量。

步驟7:將模型集成到應用程序或工作流程中,實現自動化內容生成。

精選AI產品推薦

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系統。它能夠進行多模態推理,支持文本、圖像、視頻、音頻和代碼之間的無縫交互。Gemini在語言理解、推理、數學、編程等多個領域都超越了之前的狀態,成為迄今為止最強大的AI系統之一。它有三個不同規模的版本,可滿足從邊緣計算到雲計算的各種需求。Gemini可以廣泛應用於創意設計、寫作輔助、問題解答、代碼生成等領域。

AI模型

11.4M

中文精選

剪映dreamina

剪映Dreamina是抖音旗下的AIGC工具,用戶可以根據文本內容生成由AI生成的創意圖,支持修整圖片大小比例和模板類型。未來會用於抖音的圖文或短視頻的內容創作,豐富抖音在AI創造方面的內容庫。

AI圖像生成

9.1M