使用場景

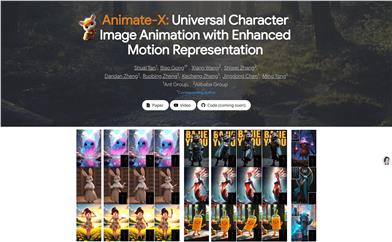

電影製作中,用於生成角色的動作場景。

遊戲開發中,用於創建角色的動態表現。

虛擬現實中,用於生成與用戶互動的虛擬角色動畫。

產品特色

外觀-姿態自適應(APPA層):在保持源圖像外觀的同時,維持來自凍結控制網的姿態信息。

時間控制網絡:防止生成視頻因突然和錯誤的姿態變化而崩潰。

姿態驅動的溫度圖:在推理階段通過平滑時間層的注意力分數來減少靜態區域的閃爍。

時間一致性:確保動畫過程中人物姿態的連貫性。

泛化能力:能夠適應不同領域和身份的動畫生成。

背景保持:在動畫過程中保持源圖像背景的一致性。

多身份動畫:能夠將動作轉移到不同身份的人物或動畫角色上。

使用教程

1. 準備源圖像和驅動視頻,確保它們包含所需的人物外觀和動作。

2. 使用TCAN模型進行人像動畫生成,輸入源圖像和驅動視頻。

3. 調整TCAN模型中的參數,如APPA層的權重和時間控制網絡的強度,以獲得最佳動畫效果。

4. 利用姿態驅動的溫度圖減少動畫中的閃爍和不連貫現象。

5. 觀察生成的動畫,確保時間一致性和背景保持符合預期。

6. 根據需要進行微調,直至達到滿意的動畫效果。

精選AI產品推薦

Sora

Sora是一個基於大規模訓練的文本控制視頻生成擴散模型。它能夠生成長達1分鐘的高清視頻,涵蓋廣泛的視覺數據類型和分辨率。Sora通過在視頻和圖像的壓縮潛在空間中訓練,將其分解為時空位置補丁,實現了可擴展的視頻生成。Sora還展現出一些模擬物理世界和數字世界的能力,如三維一致性和交互,揭示了繼續擴大視頻生成模型規模來發展高能力模擬器的前景。

AI視頻生成

17.2M

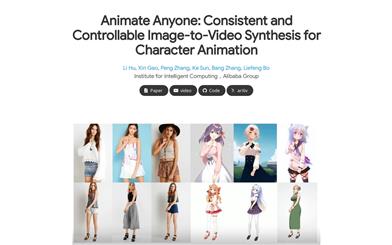

Animate Anyone

Animate Anyone旨在通過驅動信號從靜態圖像生成角色視頻。我們利用擴散模型的力量,提出了一個專為角色動畫量身定製的新框架。為了保持參考圖像中複雜外觀特徵的一致性,我們設計了ReferenceNet來通過空間注意力合併詳細特徵。為了確保可控性和連續性,我們引入了一個高效的姿勢指導器來指導角色的動作,並採用了一種有效的時間建模方法,以確保視頻幀之間的平滑跨幀過渡。通過擴展訓練數據,我們的方法可以為任意角色製作動畫,與其他圖像到視頻方法相比,在角色動畫方面取得了出色的結果。此外,我們在時尚視頻和人類舞蹈合成的基準上評估了我們的方法,取得了最先進的結果。

AI視頻生成

11.8M