海外精選

Claude 4

Claude 4 は、Anthropic が最新にリリースした AI モデルシリーズです。強力なプログラミングと推論能力を持ち、複雑なタスクを効率的に処理可能です。その優れたパフォーマンスにより、プログラミングベンチマークテストでもトップクラスとなる実績を持っています。開発者にとって重要なツールとして広く活用されています。Claude 4 は、情報処理の効率性と正確性の向上を目指し、新しい機能を導入し、効率的なコーディングと論理的推論を必要とするユーザーに最適です。

プログラミング

37.8K

Deepseek Prover V2 671B

DeepSeek-Prover-V2-671Bは、強力な推論能力を提供する高度な人工知能モデルです。最新技術に基づいており、さまざまなシナリオに適用できます。このモデルはオープンソースであり、人工知能技術の民主化と普及、技術的障壁の低減を目指しています。これにより、多くの開発者や研究者がAI技術を使用してイノベーションを行うことが可能になります。このモデルを使用することで、ユーザーは工作效率を向上させ、さまざまなプロジェクトの進捗を加速できます。

AI モデル

37.0K

D1

このモデルは、強化学習と高品質な推論軌跡のマスクされた自己教師あり微調整により、拡散型大規模言語モデルの推論能力の向上を実現しました。この技術の重要性は、モデルの推論プロセスを最適化し、計算コストを削減しながら、学習ダイナミクスの安定性を維持できる点にあります。ライティングや推論タスクで効率を向上させたいユーザーに適しています。

レクチャー資料

37.8K

中国語精選

Kimi VL

Kimi-VLは、マルチモーダル推論、ロングコンテキストの理解、強力なエージェント機能のために設計された、高度な専門家混合型ビジョン言語モデルです。このモデルは、複数の複雑な分野で優れた性能を発揮し、28億パラメータの高効率性と、優れた数学的推論能力と画像理解能力を備えています。Kimi-VLは、最適化された計算性能と長い入力の処理能力により、マルチモーダルモデルの新たな基準を打ち立てています。

AIモデル

37.8K

Llama 3.1 Nemotron Ultra 253B

Llama-3.1-Nemotron-Ultra-253B-v1は、Llama-3.1-405B-Instructをベースとした大規模言語モデルであり、推論能力とチャット能力を向上させるため、複数段階の後訓練が行われています。本モデルは最大128Kのコンテキスト長に対応し、正確性と効率のバランスに優れており、商業利用にも適しています。開発者向けに強力なAIアシスタント機能を提供することを目的としています。

AIモデル

38.6K

海外精選

Gemini 2.5

Gemini 2.5は、Googleが発表した最先端のAIモデルであり、効率的な推論能力とコーディング性能を備え、複雑な問題に対処し、複数のベンチマークテストで優れた成果を上げています。このモデルは、強化された基本モデルと事後トレーニングを組み合わせた新しい思考能力を導入し、より複雑なタスクをサポートし、開発者と企業に強力なサポートを提供することを目的としています。Gemini 2.5 Proは、Google AI StudioとGeminiアプリで使用でき、高度な推論とコーディング能力を必要とするユーザーに適しています。

AIモデル

40.3K

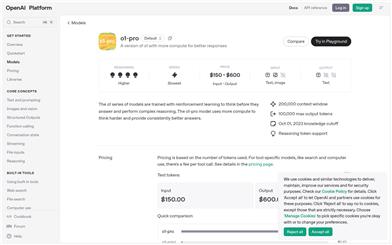

O1 Pro

o1-proモデルは、高品質なテキスト生成と複雑な推論を提供するために設計された、高度な人工知能言語モデルです。推論と応答の正確性に優れており、高精度なテキスト処理が必要なアプリケーションシーンに適しています。本モデルの価格は使用トークン数に基づいており、入力100万トークンあたり150米ドル、出力100万トークンあたり600米ドルです。企業や開発者は、本モデルをアプリケーションに統合することで、効率的なテキスト生成能力を活用できます。

レクチャー資料

45.8K

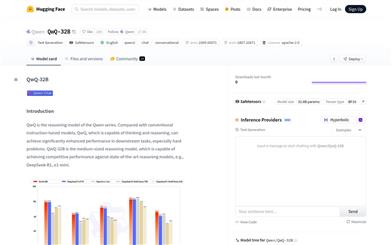

Qwq 32B

QwQ-32BはQwenシリーズの推論モデルであり、複雑な問題の思考と推論能力に特化しています。下流タスクにおいて優れたパフォーマンスを発揮し、特に難問解決においてその力を発揮します。このモデルはQwen2.5アーキテクチャをベースに、事前学習と強化学習による最適化が行われており、325億のパラメーターを持ち、最大131072トークンの完全なコンテキスト長を処理できます。主な利点としては、強力な推論能力、効率的な長文処理能力、柔軟な展開オプションなどが挙げられます。このモデルは、学術研究、プログラミング支援、創作執筆など、深い思考と複雑な推論を必要とする場面に適しています。

AIモデル

48.6K

中国語精選

Qwq Max Preview

QwQ-Max-Previewは、Qwenシリーズの最新成果で、Qwen2.5-Maxを基盤としています。数学、プログラミング、一般的なタスクにおいて優れた能力を示し、Agent関連のワークフローでも良好なパフォーマンスを発揮します。QwQ-Maxのプレビュー版として、現在も継続的に最適化されています。主な利点としては、高度な推論能力、数学、プログラミング、そしてAgentタスクにおける強力な能力が挙げられます。将来的には、Apache 2.0ライセンスの下でQwQ-MaxとQwen2.5-Maxをオープンソースとして公開し、分野横断的なアプリケーションのイノベーションを促進することを目指しています。

AIモデル

66.2K

Claude 3.7 Sonnet

Anthropic社が開発した最新のハイブリッド推論モデルで、高速な応答と高度な推論をシームレスに切り替えることができます。プログラミングやフロントエンド開発において優れた性能を発揮し、APIを通じて推論深度の微調整が可能です。コード生成とデバッグ能力の向上に加え、複雑なタスクへの対応も最適化されており、エンタープライズレベルのアプリケーションに適しています。価格は前世代製品と同様で、入力100万トークンあたり3ドル、出力100万トークンあたり15ドルです。

コードアシスタント

54.6K

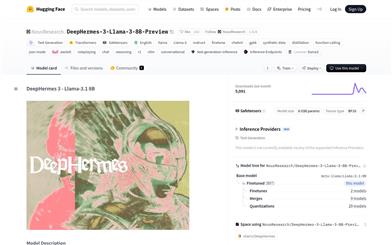

Deephermes 3 Llama 3 8B Preview

DeepHermes 3は、NousResearchが開発した高度な言語モデルであり、体系的な推論によって回答の精度を向上させることができます。推論モードと通常の応答モードをサポートしており、ユーザーはシステムプロンプトで切り替えることができます。このモデルは、複数ターン会話、ロールプレイング、推論などで優れたパフォーマンスを発揮し、ユーザーにより強力で柔軟な言語生成能力を提供することを目指しています。Llama-3.1-8Bをファインチューニングしたモデルで、パラメータ数は80.3億個であり、推論、会話、関数呼び出しなど、さまざまなアプリケーションシナリオに対応しています。

チャットボット

48.9K

Kie.ai

DeepSeek R1とV3 APIは、Kie.aiが提供する強力なAIモデルインターフェースです。DeepSeek R1は、数学、プログラミング、論理推論などの高度な推論タスク向けに設計された最新の推論モデルであり、大規模な強化学習によってトレーニングされ、正確な結果を提供します。DeepSeek V3は、一般的なAIタスクの処理に適しています。これらのAPIは、米国の安全なサーバー上に展開されており、データの安全とプライバシーを保護します。Kie.aiは、詳細なAPIドキュメントとさまざまな価格プランも提供しており、さまざまなニーズに対応し、開発者がAI機能を迅速に統合してプロジェクトのパフォーマンスを向上させることができます。

APIサービス

55.2K

海外精選

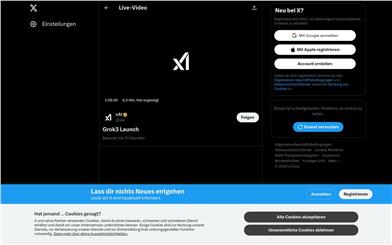

Grok 3

Grok 3は、イーロン?マスク氏のAI企業xAIが開発した最新のフラッグシップAIモデルです。計算能力とデータセット規模が大幅に向上しており、複雑な数学や科学的問題を処理し、マルチモーダル入力に対応できます。主な利点は、強力な推論能力でより正確な回答を提供できる点であり、いくつかのベンチマークテストでは既存のトップモデルを上回っています。Grok 3の発表は、xAIのAI分野における更なる発展を示しており、ユーザーによりスマートで効率的なAIサービスを提供することを目指しています。現在、主にGrokアプリとXプラットフォームを通じてサービスを提供しており、将来的には音声モードと企業向けAPIインターフェースも提供する予定です。ハイエンドなAIソリューションとして位置付けられており、高度な推論とマルチモーダルインタラクションを必要とするユーザーをターゲットとしています。

AIモデル

130.3K

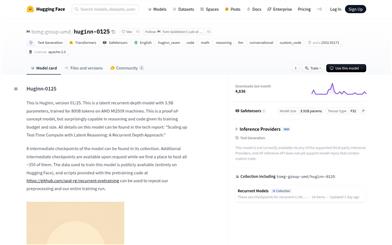

Huginn 0125

Huginn-0125は、メリーランド大学カレッジパーク校Tom Goldstein研究所によって開発された潜在変数循環型深層モデルです。35億パラメータを持ち、8000億トークンのデータで学習されており、推論とコード生成において優れた性能を発揮します。主な特徴は、テスト時に循環深度構造によって計算量を動的に調整することであり、タスクの要件に応じて計算ステップを柔軟に増減させるため、性能を維持しながらリソース利用を最適化できます。このモデルはオープンソースのHugging Faceプラットフォームで公開されており、コミュニティによる共有と協調をサポートし、ユーザーは自由にダウンロード、使用、およびさらなる開発を行うことができます。そのオープンソース性と柔軟なアーキテクチャにより、特にリソースが制限されている場合や高性能な推論が必要な場面において、研究開発における重要なツールとなっています。

コードアシスタント

47.2K

Medrax

MedRAXは、胸部X線(CXR)のインテリジェントな分析に特化した革新的なAIフレームワークです。最先端のCXR分析ツールとマルチモーダル大規模言語モデルを統合することにより、複雑な医療照会を動的に処理できます。MedRAXは追加のトレーニングなしで実行でき、リアルタイムのCXR解釈をサポートし、さまざまな臨床シナリオに適用可能です。主な利点として、高い柔軟性、強力な推論能力、および透明性の高いワークフローが挙げられます。本製品は医療従事者を対象としており、診断効率と精度を向上させ、医療AIの実用化を促進することを目的としています。

医療画像解析

48.3K

Deepclaude

DeepClaudeは、DeepSeek R1の推論能力とClaudeの創造性とコード生成能力を統合した強力なAIツールです。統一されたAPIとチャットインターフェースを通じてサービスを提供します。Rustで記述された高性能なストリーミングAPIを使用することで、即時応答を実現し、エンドツーエンドの暗号化とローカルAPIキー管理に対応することで、ユーザーデータのプライバシーとセキュリティを確保しています。完全にオープンソースであり、ユーザーは自由に貢献、修正、デプロイできます。主な利点としては、ゼロレイテンシ応答、高度な構成可能性、BYOK(Bring Your Own Key)によるユーザー独自のキーの使用などがあり、開発者に高い柔軟性と制御性を提供します。DeepClaudeは、効率的なコード生成とAI推論能力を必要とする開発者や企業を主な対象としており、現在無料トライアル中です。将来的には、使用量に基づいて料金が発生する可能性があります。

開発とツール

71.8K

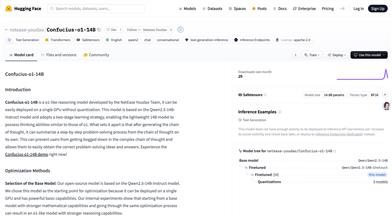

Confucius O1 14B

Confucius-o1-14Bは、网易有道チームがQwen2.5-14B-Instructを基に最適化して開発した推論モデルです。2段階学習戦略を採用し、推論チェーンを自動生成し、段階的な問題解決プロセスを要約します。本モデルは主に教育分野、特にK12数学問題の解答に適しており、ユーザーが迅速に正しい解法と答えを得るのに役立ちます。軽量化されており、量子化なしで単一のGPUに展開できるため、使用障壁が低くなっています。内部評価では優れた推論能力を示しており、教育分野におけるAIアプリケーションに強力な技術サポートを提供します。

学習教育

48.3K

中国語精選

UI TARS

UI-TARSは、バイトダンスによって開発された新しいタイプのGUIエージェントモデルです。人間と同様の知覚、推論、行動能力を通じて、グラフィカルユーザーインターフェースとシームレスに相互作用することに重点を置いています。このモデルは、知覚、推論、位置特定、記憶などの重要なコンポーネントを単一のビジョン言語モデルに統合し、事前に定義されたワークフローや手動ルールを必要とせずに、エンドツーエンドのタスク自動化を実現します。主な利点としては、強力なクロスプラットフォームの相互運用性、複数ステップのタスク実行能力、合成データと現実データからの学習能力があり、デスクトップ、モバイル、ウェブ環境など、さまざまな自動化シナリオに適用できます。

自動化ワークフロー

220.2K

Gemini 2.0 フラッシュ思考実験

Gemini フラッシュ思考は、Google DeepMindが開発した、複雑なタスク向けに設計された最新のAIモデルです。推論プロセスを表示することで、モデルの意思決定ロジックの理解を深めることができます。数学や科学分野で優れた性能を発揮し、長文テキスト分析やコード実行機能をサポートしています。複雑なタスクにおけるAIの応用を促進するための、開発者向けの強力なツールを目指しています。

研究機器

47.7K

Deepseek R1 Distill Llama 8B

DeepSeek-R1-Distill-Llama-8Bは、DeepSeekチームが開発した高性能言語モデルであり、Llamaアーキテクチャをベースに、強化学習と蒸留によって最適化されています。このモデルは、推論、コード生成、多言語タスクにおいて優れた性能を発揮し、純粋な強化学習によって推論能力を向上させた、オープンソースコミュニティにおける初のモデルです。商用利用、修正、派生作品の作成を許可しており、学術研究や企業アプリケーションに適しています。

AIモデル

138.8K

Deepseek R1 Distill Qwen 14B

DeepSeek-R1-Distill-Qwen-14Bは、DeepSeekチームがQwen-14Bを基に開発した蒸留モデルであり、推論とテキスト生成タスクに特化しています。大規模な強化学習とデータ蒸留技術により、推論能力と生成品質を大幅に向上させながら、計算資源の消費を削減しています。主な利点として、高性能、低リソース消費、幅広い適用性があり、効率的な推論とテキスト生成を必要とする場面に適しています。

AIモデル

261.6K

Deepseek R1 Distill Llama 70B

DeepSeek-R1-Distill-Llama-70Bは、DeepSeekチームが開発した大規模言語モデルで、Llama-70Bアーキテクチャをベースに強化学習によって最適化されています。このモデルは、推論、対話、多言語タスクにおいて優れた性能を発揮し、コード生成、数学的推論、自然言語処理など、多様なアプリケーションシナリオに対応しています。主な利点として、効率的な推論能力と複雑な問題解決能力があり、オープンソースと商用利用の両方をサポートしています。高性能な言語生成と推論能力が必要な企業や研究機関に適しています。

AIモデル

75.6K

中国語精選

Kimi K1.5

Kimi k1.5は、MoonshotAIによって開発されたマルチモーダル言語モデルです。強化学習とロングコンテキスト拡張技術により、複雑な推論タスクにおけるモデルのパフォーマンスが大幅に向上しました。AIMEやMATH-500などの数学的推論タスクにおいて、GPT-4oやClaude Sonnet 3.5を上回るなど、複数のベンチマークテストで業界トップレベルの成果を達成しています。主な利点としては、効率的なトレーニングフレームワーク、強力なマルチモーダル推論能力、ロングコンテキストのサポートなどが挙げられます。Kimi k1.5は、プログラミング支援、数学の問題解決、コード生成など、複雑な推論と論理分析を必要とするアプリケーションシナリオを主に対象としています。

モデルトレーニングとデプロイ

219.1K

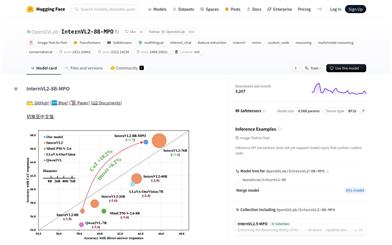

Internvl2 5 78B MPO

InternVL2.5-MPOは、InternVL2.5と混合選好最適化(MPO)に基づくマルチモーダル大規模言語モデルシリーズです。これは、新しく増分事前学習されたInternViTと、InternLM 2.5やQwen 2.5などの様々な事前学習済み大規模言語モデル(LLM)を、ランダムに初期化されたMLPプロジェクターを使用して統合することで、マルチモーダルタスクにおいて優れた性能を発揮します。このモデルシリーズは約300万サンプルを含むマルチモーダル推論選好データセットMMPRでトレーニングされており、効率的なデータ構築プロセスと混合選好最適化技術により、モデルの推論能力と回答品質が向上しています。

AIモデル

48.9K

Internlm3 8B Instruct

InternLM3-8B-Instructは、InternLMチームによって開発された大規模言語モデルであり、卓越した推論能力と知識集約型タスク処理能力を備えています。わずか4兆の高品質トークンを用いたトレーニングで、同レベルのモデルと比較して75%以上のトレーニングコスト削減を実現し、複数のベンチマークテストにおいてLlama3.1-8BやQwen2.5-7Bなどのモデルを凌駕しています。深層思考モードをサポートし、長い思考連鎖を通じて複雑な推論タスクを解決できると共に、流暢なユーザーインタラクション能力も備えています。Apache-2.0ライセンスの下でオープンソース化されており、効率的な推論と知識処理を必要とする様々なアプリケーションシナリオに適しています。

AIモデル

43.9K

Eurus 2 7B SFT

Eurus-2-7B-SFTは、Qwen2.5-Math-7Bモデルをファインチューニングした大規模言語モデルであり、数学的推論と問題解決能力の向上に特化しています。模倣学習(教師ありファインチューニング)によって推論パターンを学習し、複雑な数学問題やプログラミングタスクを効果的に解決できます。主な利点は、強力な推論能力と数学問題への正確な処理であり、複雑な論理的推論を必要とする場面に適しています。このモデルはPRIME-RLチームによって開発され、暗黙的報酬によってモデルの推論能力を向上させることを目指しています。

研究機器

45.3K

Huatuogpt O1 70B

HuatuoGPT-o1-70Bは、FreedomIntelligenceが開発した医療分野向けの大規模言語モデル(LLM)であり、複雑な医療推論用に設計されています。このモデルは最終的な回答を生成する前に、複雑な思考プロセスを生成し、その推論を反映して洗練します。HuatuoGPT-o1-70Bは複雑な医療問題を処理し、熟慮された回答を提供することで、医療における意思決定の質と効率の向上に貢献します。このモデルはLLaMA-3.1-70Bアーキテクチャに基づいており、英語に対応し、vllmやSglangなどの様々なツールに展開したり、直接推論を実行することも可能です。

医療健康

47.2K

Huatuogpt O1 7B

HuatuoGPT-o1-7Bは、FreedomIntelligenceが開発した高度な医療推論用に設計された医療分野の大規模言語モデル(LLM)です。最終的な回答を提示する前に、複雑な思考プロセスを生成し、その推論を反映および洗練します。HuatuoGPT-o1-7Bは、中国語と英語に対応しており、複雑な医療問題を処理し、「思考-回答」形式で結果を出力します。これは、医療における意思決定の透明性と信頼性を向上させる上で非常に重要です。本モデルはQwen2.5-7Bをベースに、医療分野のニーズに合わせて特別にトレーニングされています。

医療健康

45.8K

Huatuogpt O1 8B

HuatuoGPT-o1-8Bは、高度な医療推論用に設計された医療分野向けの大規模言語モデル(LLM)です。最終的な回答を生成する前に、複雑な思考過程を生成し、その推論過程を反映および改良します。LLaMA-3.1-8Bをベースに構築されており、英語に対応し、'thinks-before-it-answers'方式を採用することで、推論過程と最終的な回答を含む出力形式を提供します。複雑な医療問題を処理し、熟慮された回答を提供できるため、医療現場において、医療意思決定の質と効率の向上に重要な役割を果たします。

医療

46.6K

Internvl2 8B MPO

InternVL2-8B-MPOは、混合選好最適化(MPO)プロセスを導入することで、多様なモダリティ推論能力を強化した多様なモダリティ大規模言語モデル(MLLM)です。自動化された選好データ構築パイプラインを設計し、大規模な多様なモダリティ推論選好データセットであるMMPRを構築しました。InternVL2-8Bを初期化モデルとし、MMPRデータセットを用いてファインチューニングすることで、より強力な多様なモダリティ推論能力と、より少ない幻覚現象を実現しています。MathVistaにおいて67.0%の精度を達成し、InternVL2-8Bを8.7ポイント上回り、10倍規模のInternVL2-76Bに匹敵する性能を示しています。

AIモデル

45.5K

- 1

- 2

- 3

おすすめAI製品

海外精選

Jules AI

Jules は、自動で煩雑なコーディングタスクを処理し、あなたに核心的なコーディングに時間をかけることを可能にする異步コーディングエージェントです。その主な強みは GitHub との統合で、Pull Request(PR) を自動化し、テストを実行し、クラウド仮想マシン上でコードを検証することで、開発効率を大幅に向上させています。Jules はさまざまな開発者に適しており、特に忙しいチームには効果的にプロジェクトとコードの品質を管理する支援を行います。

開発プログラミング

39.2K

Nocode

NoCode はプログラミング経験を必要としないプラットフォームで、ユーザーが自然言語でアイデアを表現し、迅速にアプリケーションを生成することが可能です。これにより、開発の障壁を下げ、より多くの人が自身のアイデアを実現できるようになります。このプラットフォームはリアルタイムプレビュー機能とワンクリックデプロイ機能を提供しており、技術的な知識がないユーザーにも非常に使いやすい設計となっています。

開発プラットフォーム

38.9K

Listenhub

ListenHub は軽量級の AI ポッドキャストジェネレーターであり、中国語と英語に対応しています。最先端の AI 技術を使用し、ユーザーが興味を持つポッドキャストコンテンツを迅速に生成できます。その主な利点には、自然な会話と超高品質な音声効果が含まれており、いつでもどこでも高品質な聴覚体験を楽しむことができます。ListenHub はコンテンツ生成速度を改善するだけでなく、モバイルデバイスにも対応しており、さまざまな場面で使いやすいです。情報取得の高効率なツールとして位置づけられており、幅広いリスナーのニーズに応えています。

AI

38.1K

中国語精選

腾讯混元画像 2.0

腾讯混元画像 2.0 は腾讯が最新に発表したAI画像生成モデルで、生成スピードと画質が大幅に向上しました。超高圧縮倍率のエンコード?デコーダーと新しい拡散アーキテクチャを採用しており、画像生成速度はミリ秒級まで到達し、従来の時間のかかる生成を回避することが可能です。また、強化学習アルゴリズムと人間の美的知識の統合により、画像のリアリズムと詳細表現力を向上させ、デザイナー、クリエーターなどの専門ユーザーに適しています。

画像生成

38.1K

Openmemory MCP

OpenMemoryはオープンソースの個人向けメモリレイヤーで、大規模言語モデル(LLM)に私密でポータブルなメモリ管理を提供します。ユーザーはデータに対する完全な制御権を持ち、AIアプリケーションを作成する際も安全性を保つことができます。このプロジェクトはDocker、Python、Node.jsをサポートしており、開発者が個別化されたAI体験を行うのに適しています。また、個人情報を漏らすことなくAIを利用したいユーザーにお勧めします。

オープンソース

38.9K

Fastvlm

FastVLM は、視覚言語モデル向けに設計された効果的な視覚符号化モデルです。イノベーティブな FastViTHD ミックスドビジュアル符号化エンジンを使用することで、高解像度画像の符号化時間と出力されるトークンの数を削減し、モデルのスループットと精度を向上させました。FastVLM の主な位置付けは、開発者が強力な視覚言語処理機能を得られるように支援し、特に迅速なレスポンスが必要なモバイルデバイス上で優れたパフォーマンスを発揮します。

画像処理

38.1K

海外精選

ピカ

ピカは、ユーザーが自身の創造的なアイデアをアップロードすると、AIがそれに基づいた動画を自動生成する動画制作プラットフォームです。主な機能は、多様なアイデアからの動画生成、プロフェッショナルな動画効果、シンプルで使いやすい操作性です。無料トライアル方式を採用しており、クリエイターや動画愛好家をターゲットとしています。

映像制作

17.6M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M