EXAONE 3.5 32B Instruct AWQ

EXAONE-3.5-32B-Instruct-AWQは、LG AI Researchが開発した、指示調整済みの英語と韓国語のバイリンガル生成モデルシリーズです。パラメーター数は2.4Bから32Bまで様々です。これらのモデルは最大32Kトークンのロングコンテキスト処理に対応し、現実世界のユースケースやロングコンテキスト理解において最先端の性能を発揮すると同時に、最近発表された同規模のモデルと比較して、汎用領域においても競争力を維持しています。AWQ量子化技術により、4ビットグループレベルの重み量子化を実現し、モデルの配置効率を最適化しています。

AIモデル

47.2K

EXAONE 3.5 2.4B Instruct AWQ

EXAONE-3.5-2.4B-Instruct-AWQは、LG AI Researchが開発した一連のバイリンガル(英語と韓国語)指示微調整済み生成モデルであり、パラメーター数は2.4Bから32Bです。これらのモデルは最大32Kトークンのロングコンテキスト処理に対応し、現実世界のユースケースとロングコンテキスト理解において最先端の性能を示すと同時に、最近公開された同規模のモデルと比較して、汎用領域において競争力を維持しています。このモデルは小型またはリソースの限られたデバイスへの配置向けに最適化されており、AWQ量子化技術を採用することで、4ビットグループ重み量子化(W4A16g128)を実現しています。

AIモデル

44.7K

Qwen2.5 Coder 0.5B Instruct AWQ

Qwen2.5-Coderは、Qwen大規模言語モデルの最新シリーズであり、コード生成、コード推論、コード修正に特化しています。Qwen2.5の強力な能力を基盤とし、ソースコード、テキストコードベース、合成データなどを含む5.5兆トークンに拡張トレーニングすることで、Qwen2.5-Coder-32Bは現在最先端のオープンソースコードLLMとなり、そのコーディング能力はGPT-4oに匹敵します。このモデルはAWQ量子化された4ビット指令調整済み0.5Bパラメータバージョンであり、因果言語モデル、事前学習と事後学習、Transformersアーキテクチャなどの特徴を備えています。

コード推論

45.3K

Qwen2.5 Coder 14B Instruct AWQ

Qwen2.5-Coderは、0.5億から32億パラメータまでの様々なモデルサイズを備えた、コード特化型の巨大言語モデルシリーズです。異なる開発者のニーズに対応します。コード生成、コード推論、コード修正において顕著な性能向上を達成しており、強力なQwen2.5をベースに、ソースコード、テキストコードベース、合成データなどを含む5.5兆トークンで学習されています。Qwen2.5-Coder-32Bは、現在最先端のオープンソースコード生成巨大言語モデルであり、そのコーディング能力はGPT-4oに匹敵します。さらに、最大128Kトークンのロングコンテキストをサポートし、AWQ 4-bit量子化技術を採用することで、モデルの効率性と性能を向上させています。

コード推論

50.2K

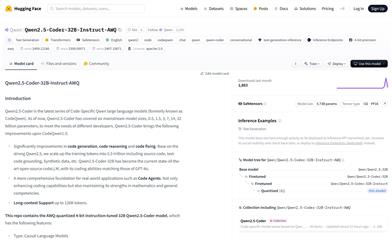

Qwen2.5 Coder 32B Instruct AWQ

Qwen2.5-Coderは、コード生成に最適化された一連の大規模言語モデルです。0.5億、1.5億、3億、7億、14億、32億パラメータの6つの主要なモデルサイズを網羅し、様々な開発者のニーズに対応します。Qwen2.5-Coderは、コード生成、コード推論、コード修正において顕著な性能向上を実現しています。強力なQwen2.5をベースに、ソースコード、テキストコード接地、合成データなどを含む5.5兆トークンでトレーニングされ、現在最先端のオープンソースコードLLMとなっています。そのコーディング能力はGPT-4oに匹敵します。さらに、Qwen2.5-Coderはより包括的な基盤を提供し、現実世界のコードエージェントなどのアプリケーションシナリオに適しています。

コード推論

48.3K

おすすめAI製品

海外精選

Jules AI

Jules は、自動で煩雑なコーディングタスクを処理し、あなたに核心的なコーディングに時間をかけることを可能にする異步コーディングエージェントです。その主な強みは GitHub との統合で、Pull Request(PR) を自動化し、テストを実行し、クラウド仮想マシン上でコードを検証することで、開発効率を大幅に向上させています。Jules はさまざまな開発者に適しており、特に忙しいチームには効果的にプロジェクトとコードの品質を管理する支援を行います。

開発プログラミング

43.1K

Nocode

NoCode はプログラミング経験を必要としないプラットフォームで、ユーザーが自然言語でアイデアを表現し、迅速にアプリケーションを生成することが可能です。これにより、開発の障壁を下げ、より多くの人が自身のアイデアを実現できるようになります。このプラットフォームはリアルタイムプレビュー機能とワンクリックデプロイ機能を提供しており、技術的な知識がないユーザーにも非常に使いやすい設計となっています。

開発プラットフォーム

42.0K

Listenhub

ListenHub は軽量級の AI ポッドキャストジェネレーターであり、中国語と英語に対応しています。最先端の AI 技術を使用し、ユーザーが興味を持つポッドキャストコンテンツを迅速に生成できます。その主な利点には、自然な会話と超高品質な音声効果が含まれており、いつでもどこでも高品質な聴覚体験を楽しむことができます。ListenHub はコンテンツ生成速度を改善するだけでなく、モバイルデバイスにも対応しており、さまざまな場面で使いやすいです。情報取得の高効率なツールとして位置づけられており、幅広いリスナーのニーズに応えています。

AI

41.1K

中国語精選

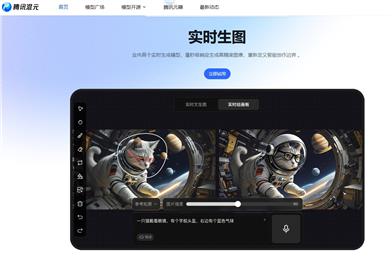

腾讯混元画像 2.0

腾讯混元画像 2.0 は腾讯が最新に発表したAI画像生成モデルで、生成スピードと画質が大幅に向上しました。超高圧縮倍率のエンコード?デコーダーと新しい拡散アーキテクチャを採用しており、画像生成速度はミリ秒級まで到達し、従来の時間のかかる生成を回避することが可能です。また、強化学習アルゴリズムと人間の美的知識の統合により、画像のリアリズムと詳細表現力を向上させ、デザイナー、クリエーターなどの専門ユーザーに適しています。

画像生成

41.1K

Openmemory MCP

OpenMemoryはオープンソースの個人向けメモリレイヤーで、大規模言語モデル(LLM)に私密でポータブルなメモリ管理を提供します。ユーザーはデータに対する完全な制御権を持ち、AIアプリケーションを作成する際も安全性を保つことができます。このプロジェクトはDocker、Python、Node.jsをサポートしており、開発者が個別化されたAI体験を行うのに適しています。また、個人情報を漏らすことなくAIを利用したいユーザーにお勧めします。

オープンソース

42.2K

Fastvlm

FastVLM は、視覚言語モデル向けに設計された効果的な視覚符号化モデルです。イノベーティブな FastViTHD ミックスドビジュアル符号化エンジンを使用することで、高解像度画像の符号化時間と出力されるトークンの数を削減し、モデルのスループットと精度を向上させました。FastVLM の主な位置付けは、開発者が強力な視覚言語処理機能を得られるように支援し、特に迅速なレスポンスが必要なモバイルデバイス上で優れたパフォーマンスを発揮します。

画像処理

40.6K

海外精選

ピカ

ピカは、ユーザーが自身の創造的なアイデアをアップロードすると、AIがそれに基づいた動画を自動生成する動画制作プラットフォームです。主な機能は、多様なアイデアからの動画生成、プロフェッショナルな動画効果、シンプルで使いやすい操作性です。無料トライアル方式を採用しており、クリエイターや動画愛好家をターゲットとしています。

映像制作

17.6M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M