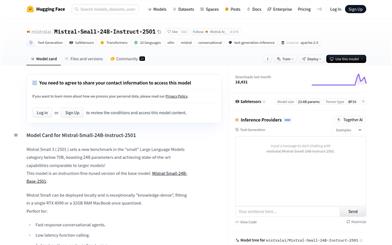

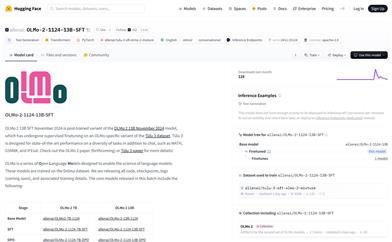

Mistral Small 24B Instruct 2501

紹介 :

Mistral Small 24Bは、Mistral AIチームが開発した240億パラメータの大規模言語モデルです。多言語対応の対話と命令処理をサポートしています。命令微調整により高品質のテキスト生成が可能で、チャット、ライティング、プログラミング支援など、様々な用途に適しています。主な利点としては、強力な言語生成能力、多言語サポート、効率的な推論能力が挙げられます。高性能な言語処理を必要とする個人や企業ユーザーに最適で、オープンソースライセンスであり、ローカル展開や量子化最適化にも対応しているため、データプライバシーを重視する場面にも適しています。

ターゲットユーザー :

このモデルは、高性能な言語処理能力を必要とする個人や企業ユーザー、特に多言語サポートとデータプライバシーを重視する場面(ローカル展開のチャットボット、ライティングアシスタント、プログラミング支援ツールなど)に適しています。オープンソースライセンスと柔軟な展開方法により、多様な用途に対応できます。

使用シナリオ

チャットボットとして、ユーザーにリアルタイムの対話サービスを提供し、多言語でのコミュニケーションをサポートします。

プログラミング支援ツールとして、開発者がコード断片を生成したり、複雑なプログラミング概念を説明したりするのに役立ちます。

ライティングアシスタントとして、ユーザーが記事、レポート、または創作物を執筆するのに役立ちます。

製品特徴

多言語対応の対話機能(英語、フランス語、中国語など)

強力な命令処理能力により、複雑なタスク命令を理解し実行可能

ローカル展開が可能で、単体のRTX 4090または32GBメモリ搭載デバイス上で動作

高度な推論能力により、複雑な問題解決や論理的推論に適している

vLLM、Transformersなど、複数の推論フレームワークをサポート

使用チュートリアル

1. Hugging Face公式サイトに登録してログインし、モデルページにアクセスします。

2. ローカル展開やvLLMフレームワークによる展開など、必要に応じて展開方法を選択します。

3. vLLMやTransformersなど、必要な依存ライブラリをインストールします。

4. モデルのAPIまたはコマンドラインツールを使用して推論を行い、プロンプトを入力して生成結果を取得します。

5. 温度、最大生成長など、実際の用途に合わせてモデルパラメータを調整します。

おすすめAI製品

中国語精選

豆包(doubao)

豆包(Doubao)は、自然言語処理を用いたインテリジェントなチャットボットです。天気、ニュース、ジョーク、音楽など、様々な話題でユーザーと自然な会話を楽しむことができます。さらに、ユーザーの好みや習慣に基づいて、関連性の高いコンテンツやサービスをレコメンドします。豆包はあなた専属のチャットアシスタントとして、寂しさを解消します。

会話型AI

17.0M

中国語精選

Kimiスマートアシスタント

Kimi Chatは、月之暗面科技が開発した、スマートなチャットボットアプリです。大容量の知識ベースを備え、インテリジェントな雑談、質問への回答、生活支援サービスの提供など、高度なインテリジェントなインタラクション能力を備えています。いつでもどこでもKimiとチャットして楽しみを見つけることができ、その返答は多様で、会話をより楽しくします。Kimi Chatは完全に無料で、QRコードをスキャンするか、携帯電話で検索して直接使用できます。

会話型AI

15.9M