Llama O1

紹介 :

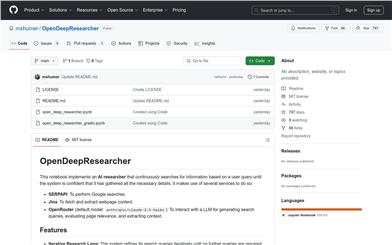

LLaMA-O1は大規模推論モデルフレームワークであり、モンテカルロ木探索(MCTS)、自己強化学習、PPOなどの技術を統合し、AlphaGo Zeroの二重戦略パラダイムと大規模言語モデルを参考にしています。主にオリンピックレベルの数学的推論問題を対象とし、トレーニング、推論、評価のためのオープンなプラットフォームを提供します。これは個人的な実験プロジェクトであり、いかなる第三者組織や機関とも無関係であることを、製品背景情報として明記します。

ターゲットユーザー :

主な対象ユーザーは、複雑な数学および論理問題を処理するための強力な推論モデルを必要とするデータサイエンティスト、機械学習エンジニア、研究者です。LLaMA-O1は、これらのユーザーが実験とイノベーションを行い、大規模推論モデル技術の発展を促進するためのオープンなプラットフォームを提供します。

使用シナリオ

事例1:データサイエンティストがLLaMA-O1を使用してオリンピック数学問題の推論と解法を行う。

事例2:機械学習エンジニアがLLaMA-O1フレームワークを使用して自己強化学習モデルのトレーニングと最適化を行う。

事例3:研究者がLLaMA-O1を使用して大規模言語モデルの推論と評価を行い、新しいアルゴリズムとアプリケーションを探求する。

製品特徴

? モンテカルロ木探索(MCTS)による推論最適化をサポート。

? 自己強化学習技術を統合し、モデルの自己学習能力を向上。

? PPOアルゴリズムを採用し、モデルの戦略最適化能力を強化。

? AlphaGo Zeroの戦略パラダイムを参考に、モデルの意思決定品質を向上。

? PyTorchとHuggingFaceに対応し、開発者による使用と統合を容易化。

? 個人的な実験プラットフォームを提供し、ユーザーによるカスタムトレーニングと評価を可能に。

? AlphaGo ZeroからRLHFまでのチュートリアルとガイダンスを提供。

? LLaMaFactoryを使用した事前トレーニングをサポート。

使用チュートリアル

1. 必要な環境をインストールする:pipを使用してtorch、transformers、accelerate、peft、datasetsをインストールします。

2. コードをクローンする:git cloneコマンドを使用してLLaMA-O1のコードリポジトリをローカルにクローンします。

3. ディレクトリに移動する:cdコマンドを使用してLLaMA-O1のディレクトリに移動します。

4. 最新のコードを取得する:git pullコマンドを実行して、コードが最新であることを確認します。

5. トレーニングを実行する:python main.pyコマンドを使用してモデルのトレーニングを開始します。

6. Accelerateを使用する:必要に応じて、accelerate configおよびaccelerate launch main.pyコマンドを使用してトレーニングを実行します。

7. 推論と評価:必要に応じてモデルを使用して推論と評価タスクを実行します。

おすすめAI製品

Elicit

Elicitは、研究論文を驚くべき速度で分析できるAIアシスタントです。論文要約、データ抽出、研究結果の統合など、煩雑なリサーチ作業を自動化します。関連論文の検索、1文要約の取得、論文からの詳細情報の抽出と整理、主題や概念の特定などが可能です。高い精度と使いやすさで、多くの研究者から信頼と好評を得ています。

研究機器

598.6K

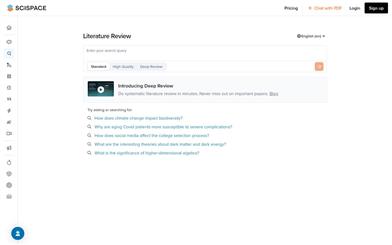

Scireviewhub

SciReviewHubは、人工知能を活用して科学論文の執筆と文献レビューを加速するツールです。AI技術を用いて、研究目的に関連する論文を迅速に絞り込み、最も関連性の高い情報を分かりやすく、すぐに使える文献レビューにまとめます。当プラットフォームを使用することで、研究効率の向上、出版時間の短縮、そして研究分野における飛躍的な進歩を実現できます。SciReviewHubに参加して、科学論文執筆の未来を再構築しましょう!

研究機器

285.1K