Audiolm

紹介 :

AudioLMはGoogle Researchが開発した、長期的な一貫性を備えた高品質オーディオ生成のためのフレームワークです。入力オーディオを離散トークンシーケンスにマッピングし、オーディオ生成をこの表現空間における言語モデリングタスクとして扱います。大量の生のオーディオ波形データで訓練することで、自然で首尾一貫したオーディオの続きを生成します。テキストや注釈がなくても、話者のアイデンティティやリズムを維持しながら、文法上および意味的に妥当な音声の続きを生成できます。さらに、訓練時に音楽記号表現を使用していなくても、首尾一貫したピアノ音楽の続きを生成できます。

ターゲットユーザー :

AudioLMのターゲットユーザーは、オーディオエンジニア、音楽プロデューサー、音声技術研究者、開発者です。複雑な手作業による編集や高価な録音機器を必要とせずに、高品質な音声や音楽コンテンツを生成する革新的な方法を提供するため、これらの人々にとって適しています。

使用シナリオ

- 音声合成アプリケーションで、特定の話者の音声の続きをAudioLMで生成します。

- 楽譜や音楽理論の知識がなくても、AudioLMを使用して新しいピアノ音楽を作成します。

- 映画やビデオゲームで、没入感を高めるために、AudioLMを使用して環境音や背景音楽を生成します。

製品特徴

- 音声マッピング:入力オーディオを離散トークンシーケンスにマッピングします。

- 言語モデリング:表現空間において、オーディオ生成を言語モデリングタスクとして行います。

- 長期構造の捕捉:事前学習済みのマスク言語モデルの離散化された活性化を利用して、長期構造を捉えます。

- 高品質合成:ニューラルオーディオコーデックによって生成された離散コードを用いて、高品質な合成を実現します。

- 自然なオーディオ生成:短いプロンプトを与えて、自然で首尾一貫したオーディオの続きを生成します。

- 音声の続き:テキストや注釈がなくても、文法上および意味的に妥当な音声の続きを生成します。

- 音楽の続き:音楽記号表現を使用していなくても、首尾一貫したピアノ音楽の続きを生成できます。

- 混合トークン方式:さまざまなオーディオトークナイザの長所と短所を組み合わせることで、高品質と長期構造の両方の目標を達成します。

使用チュートリアル

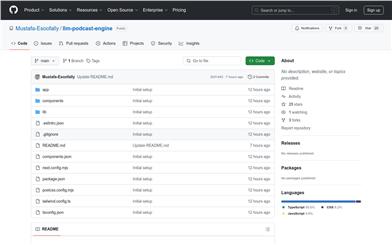

1. AudioLMのGitHubページにアクセスして、プロジェクトの詳細とインストールガイドを確認します。

2. ガイドに従って、必要な依存関係と環境をインストールします。

3. モデルの訓練に使用される生のオーディオ波形を含むAudioLMのデータセットをダウンロードして解凍します。

4. AudioLMが提供するツールとスクリプトを使用して、モデルの訓練を開始します。

5. 訓練が完了したら、モデルを使用してオーディオの続きを生成するか、新しいオーディオコンテンツを作成します。

6. 生成されたオーディオの品質を評価し、必要に応じてモデルのパラメータを調整してパフォーマンスを最適化します。

7. 生成されたオーディオをアプリケーション、ウェブサイト、その他のメディアプロジェクトに統合します。

おすすめAI製品

Suno AI

Suno AIは、人工知能を用いて音楽と音声作品を創作する製品です。高度なアルゴリズムとデータモデルを活用し、高品質な音楽と音声コンテンツを生成します。Suno AIの機能と利点は以下の通りです。1. ポップス、クラシック、エレクトロニックなど、様々なジャンルの音楽を創作できます。2. 自然で滑らかな音声の生成が可能で、音声合成やナレーションなどに活用できます。3. 豊富な音楽および音声効果を提供しており、ユーザーのニーズに合わせてカスタマイズできます。4. インターフェースがシンプルで使いやすく、操作も簡単です。5. 多様な出力形式に対応しており、様々なプラットフォームで利用できます。Suno AIの料金体系は、ユーザーの使用状況に応じて異なります。詳細は公式ウェブサイトをご覧ください。

音楽生成

3.3M

ボーカル除去?分離ツール

vocalremover.orgは、音楽からボーカルと伴奏を分離できるオンライン音声分離ツールです。シンプルで使いやすいインターフェースを備え、迅速かつ効率的に音声を分離し、分離後のオーディオファイルをエクスポートできます。vocalremover.orgは様々なオーディオフォーマットに対応しており、完全に無料で利用可能です。

音声生成

1.6M