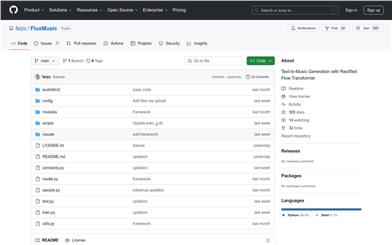

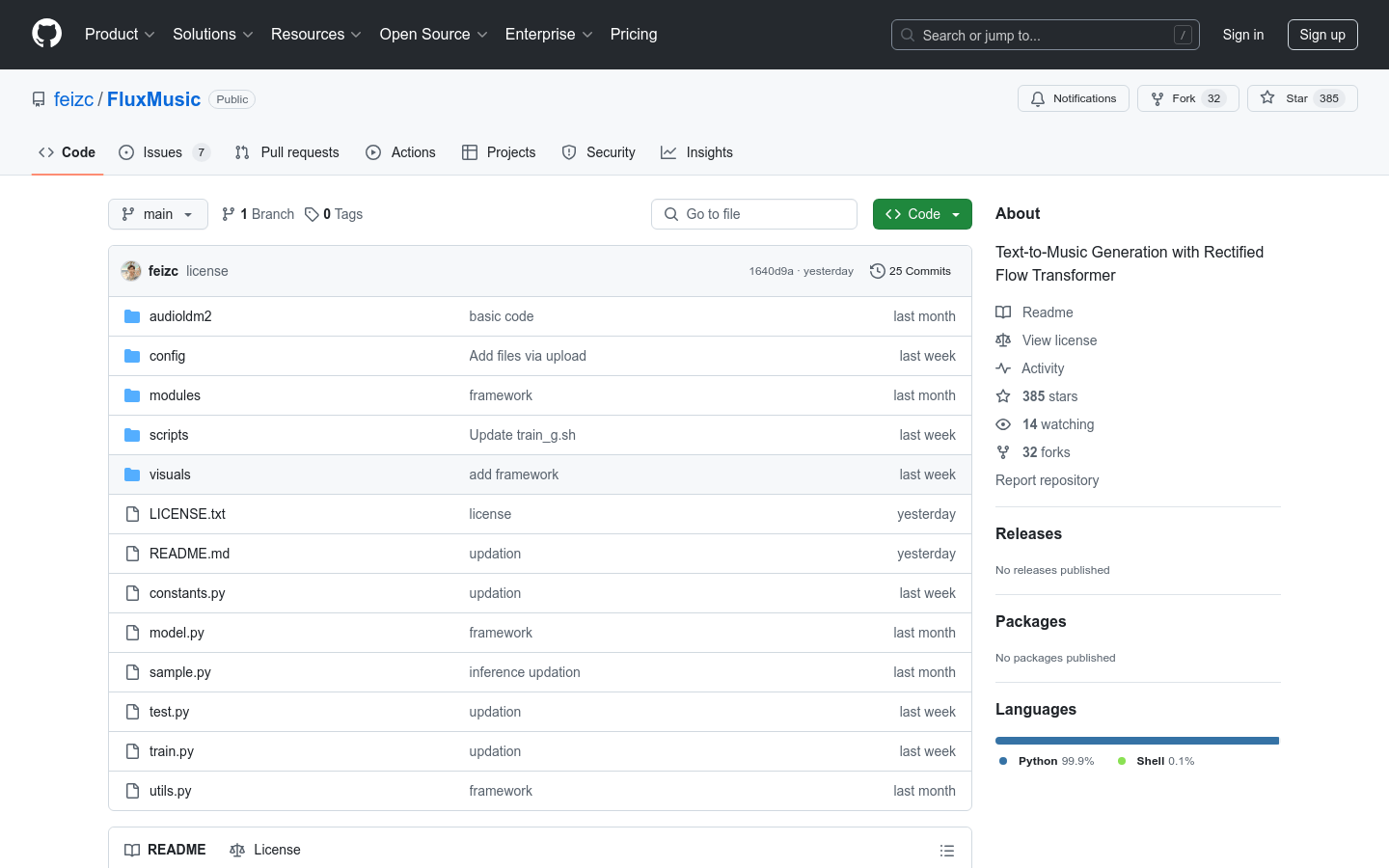

Fluxmusic

紹介 :

FluxMusicは、PyTorchを用いて実装されたテキストから音楽を生成するモデルです。拡散的修正流変換器を用いて、シンプルながらも効果的なテキストから音楽への生成手法を探求しています。このモデルは、テキストプロンプトに基づいて音楽片段を生成することができ、高い革新性と技術的複雑さを併せ持っています。音楽生成分野における最先端技術の代表であり、音楽創作に新たな可能性をもたらします。

ターゲットユーザー :

FluxMusicは、音楽プロデューサー、研究者、そして音楽生成技術に関心のある開発者にとって最適です。音楽プロデューサーは新たな創作方法を探求でき、研究者は実験プラットフォームとして活用でき、開発者は学習と研究のための資源として利用できます。

使用シナリオ

音楽プロデューサーがFluxMusicを用いて特定のスタイルの音楽片段を生成する

研究者がこのモデルを用いて音楽生成アルゴリズムの研究を行う

教育機関がこれを教材として、音楽生成技術を教授する

製品特徴

PyTorchモデル定義と事前学習済みウェイトの使用

テキストから音楽への生成に対応

学習とサンプリングのためのコードを提供

様々な計算資源に対応できるよう、複数のモデルサイズのスクリプトを用意

事前学習済みモデルとデータのダウンロードに対応

Gradioデモとウェブオーディオサンプルを提供

AudioLDM2、CLAP-L、T5-XXLなどの技術に基づいて構築

使用チュートリアル

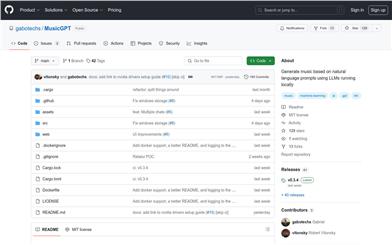

FluxMusicのGitHubページにアクセスし、プロジェクトの詳細を確認する

コードリポジトリをローカル環境にクローンまたはダウンロードする

README.mdファイルの指示に従って、実行環境を設定する

必要な依存ライブラリと事前学習済みモデルをダウンロードしてインストールする

学習スクリプトを実行してモデルの学習を開始するか、サンプリングスクリプトを使用して音楽を生成する

config/example.txt内のテキストプロンプトを参照して、音楽を生成する

Gradioデモまたはウェブオーディオサンプルで、生成された音楽の効果を確認する

必要に応じてモデルパラメータを調整し、生成される音楽の品質を最適化する

おすすめAI製品

中国語精選

天工skymusic

昆侖万維の「天工3.0」超大規模言語モデルを基盤として開発されたAI音楽生成大規模言語モデル「天工SkyMusic」。高品質なAI音楽生成、音声合成、歌詞セクション制御、多様な音楽スタイルと音楽的表現機能などをサポートします。現在、無料招待テストを実施しており、ユーザーの音楽創作と感情表現を支援します。

AI音楽生成

998.6K

TME Studio

TME Studioは、音楽愛好家のための創作ツールです。楽曲分離、MIR計算、作詞支援、スマート楽譜作成などの機能を搭載しています。ユーザーは任意の楽曲をアップロードし、ボーカルと楽器の音声を分離して、音楽内容の理解と分析を行い、様々な音楽情報を抽出できます。また、作詞ツールも提供しており、適切な韻を踏んだ言葉を見つけることで、創作のインスピレーションを刺激します。さらに、音楽をアップロードするだけで、スマートギター楽譜を作成し、自分が弾きたい曲を簡単に演奏することもできます。音楽創作アシスタントが、音楽愛好家の音楽創作をより簡単に支援します。

AI音楽生成

689.2K