LLM Compiler 7b Ftd

紹介 :

LLM Compiler-7b-ftdはMetaが開発した大規模言語モデルで、Code Llamaをベースに、コード最適化とコンパイラ推論に向けて改良されています。LLVM最適化の効果予測において卓越した性能を発揮し、コンパイラの出力を完璧にシミュレートできるため、コンパイラ最適化タスクに最適なツールです。

ターゲットユーザー :

LLM Compilerは主に、コンパイラ研究者、エンジニア、そしてコード最適化が必要な開発者を対象としています。高度なコード最適化の提案と自動化されたコンパイラ推論を提供することで、ユーザーはプログラムの効率と性能を向上させることができます。

使用シナリオ

LLM Compilerを使用して、コンパイラが生成した中間表現(IR)を最適化し、最終プログラムのサイズを縮小します。

LLM Compilerを使用して、特定のアセンブリコードの最適な最適化シーケンスを予測し、コードの実行効率を向上させます。

LLM Compilerを使用して、複雑なアセンブリコードをLLVM IRに変換し、さらなる分析と最適化を行います。

製品特徴

LLVMアセンブリコードに対する最適化効果の予測

コードサイズの縮小のための最適な最適化シーケンスの生成

アセンブリコードをLLVM IRに逆アセンブル

異なるサイズのモデルでサービスを提供し、遅延と性能のニーズに対応

深層学習によるコード最適化

コンパイラ研究者やエンジニアによる研究開発の支援

使用チュートリアル

1. transformersなどの必要なライブラリと依存関係をインストールします。

2. AutoTokenizerを使用して、事前学習済みモデルからトークナイザーを読み込みます。

3. transformers.pipelineを使用して、テキスト生成パイプラインを作成します。

4. 最適化対象のコードスニペットをパイプラインへの入力として提供します。

5. do_sample、top_k、temperatureなどのテキスト生成に関するパラメーターを設定します。

6. パイプラインを呼び出して、最適化の提案またはコードを生成します。

7. 生成されたテキストの結果を分析し、必要に応じてさらに調整または適用します。

おすすめAI製品

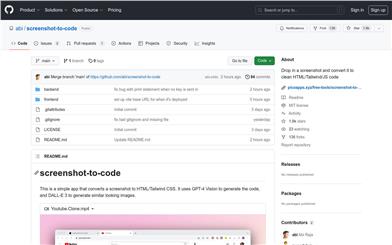

Screenshot To Code

スクリーンショットからコードへの変換は、GPT-4 Visionを使用してコードを生成し、DALL-E 3を使用して類似の画像を生成するシンプルなアプリケーションです。React/ViteフロントエンドとFastAPIバックエンドを使用しており、GPT-4 Vision APIにアクセスするためのOpenAI APIキーが必要です。

AIコード生成

965.2K

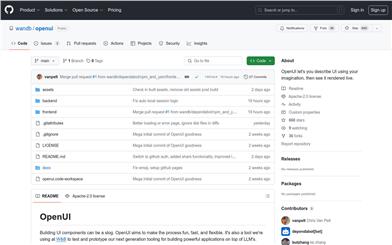

Openui

UIコンポーネントの構築は、多くの場合退屈な作業です。OpenUIは、このプロセスを楽しく、迅速で、柔軟なものにすることを目指しています。これは、W&Bが次世代ツールのテストとプロトタイピングに使用しているツールであり、LLMを基盤とした強力なアプリケーションを構築するために使用されます。想像力でUIを記述し、リアルタイムでレンダリング結果を確認できます。変更を要求し、HTMLをReact、Svelte、Webコンポーネントなどに変換できます。V0のオープンソース版で、多少洗練されていないバージョンと考えてください。

AI開発助手

755.4K