EXAONE 3.5 2.4B Instruct

简介 :

EXAONE-3.5-2.4B-Instruct是LG AI Research开发的一系列双语(英语和韩语)指令调优的生成模型,参数范围从2.4B到32B。这些模型支持长达32K令牌的长上下文处理,并在真实世界用例和长上下文理解方面展现出最先进的性能,同时在与最近发布的类似大小模型相比的通用领域中保持竞争力。该模型特别适合需要处理长文本和多语言需求的场景,如自动翻译、文本摘要、对话系统等。

需求人群 :

目标受众为需要处理大量文本数据和多语言对话的开发者和研究人员。由于EXAONE-3.5-2.4B-Instruct支持长上下文处理和双语能力,它特别适合于需要理解和生成复杂文本内容的应用,如自动翻译、文本摘要、对话系统等。

使用场景

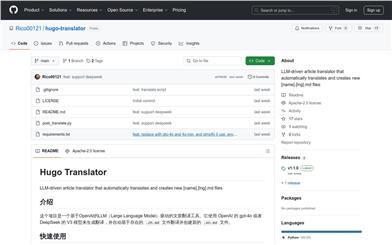

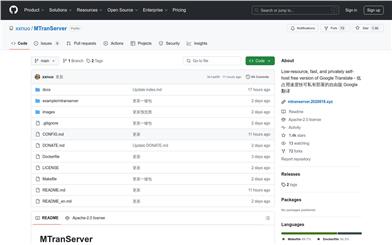

自动翻译:将英文文本翻译成韩文,反之亦然。

文本摘要:生成长文章或报告的简短摘要。

对话系统:创建能够理解和回应用户输入的智能助手。

产品特色

参数数量(不含嵌入层):2.14B

层数:30

注意力头数:GQA,32个Q头和8个KV头

词汇量:102,400

上下文长度:32,768令牌

词嵌入绑定:真(与7.8B和32B模型不同)

使用教程

1. 安装transformers库v4.43或更高版本。

2. 使用AutoModelForCausalLM和AutoTokenizer从Hugging Face加载模型和分词器。

3. 选择或编写提示(prompt),可以是英文或韩文。

4. 使用tokenizer.apply_chat_template方法将消息和提示转换为模型可以理解的格式。

5. 使用model.generate方法生成文本。

6. 使用tokenizer.decode方法将生成的令牌转换回文本。

7. 打印或以其他方式使用生成的文本。