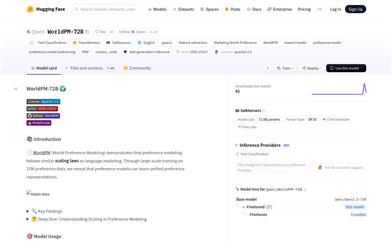

Olmo 2 1124 13B SFT

简介 :

OLMo-2-1124-13B-SFT是由Allen AI研究所开发的一个大型语言模型,经过在特定数据集上的监督微调,旨在提高在多种任务上的表现,包括聊天、数学问题解答、文本生成等。该模型基于Transformers库和PyTorch框架,支持英文,拥有Apache 2.0的开源许可证,适用于研究和教育用途。

需求人群 :

目标受众为自然语言处理领域的研究者、开发者以及对高级文本生成技术感兴趣的教育机构。该模型因其强大的文本生成能力和多任务处理性能,特别适合需要进行复杂语言理解和生成的应用场景。

使用场景

在聊天机器人中使用,提供流畅的对话体验。

用于生成技术文档或文章的草稿。

在教育领域,辅助学生解决数学问题。

产品特色

支持文本生成:能够生成高质量的文本内容。

多任务性能:在聊天、数学问题解答等多个领域有良好表现。

基于Transformers:易于集成到现有的NLP工作流中。

支持PyTorch:便于使用PyTorch框架进行模型训练和部署。

开源许可证:Apache 2.0,支持研究和教育用途。

模型微调:通过在特定数据集上的监督微调提高性能。

使用教程

1. 访问Hugging Face网站并搜索OLMo-2-1124-13B-SFT模型。

2. 使用提供的代码片段加载模型:'from transformers import AutoModelForCausalLM; olmo_model = AutoModelForCausalLM.from_pretrained("allenai/OLMo-2-1124-13B-SFT")'。

3. 根据需要调整模型参数,进行微调或直接使用。

4. 利用模型进行文本生成或其他NLP任务。

5. 遵循Apache 2.0许可证规定,合法使用模型。