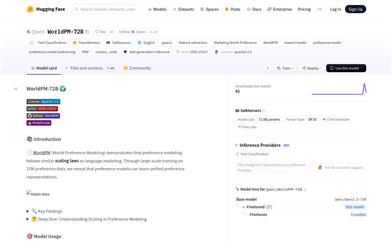

Olmo 2 1124 13B SFT

簡介 :

OLMo-2-1124-13B-SFT是由Allen AI研究所開發的一個大型語言模型,經過在特定數據集上的監督微調,旨在提高在多種任務上的表現,包括聊天、數學問題解答、文本生成等。該模型基於Transformers庫和PyTorch框架,支持英文,擁有Apache 2.0的開源許可證,適用於研究和教育用途。

需求人群 :

目標受眾為自然語言處理領域的研究者、開發者以及對高級文本生成技術感興趣的教育機構。該模型因其強大的文本生成能力和多任務處理性能,特別適合需要進行復雜語言理解和生成的應用場景。

使用場景

在聊天機器人中使用,提供流暢的對話體驗。

用於生成技術文檔或文章的草稿。

在教育領域,輔助學生解決數學問題。

產品特色

支持文本生成:能夠生成高質量的文本內容。

多任務性能:在聊天、數學問題解答等多個領域有良好表現。

基於Transformers:易於集成到現有的NLP工作流中。

支持PyTorch:便於使用PyTorch框架進行模型訓練和部署。

開源許可證:Apache 2.0,支持研究和教育用途。

模型微調:通過在特定數據集上的監督微調提高性能。

使用教程

1. 訪問Hugging Face網站並搜索OLMo-2-1124-13B-SFT模型。

2. 使用提供的代碼片段加載模型:'from transformers import AutoModelForCausalLM; olmo_model = AutoModelForCausalLM.from_pretrained("allenai/OLMo-2-1124-13B-SFT")'。

3. 根據需要調整模型參數,進行微調或直接使用。

4. 利用模型進行文本生成或其他NLP任務。

5. 遵循Apache 2.0許可證規定,合法使用模型。