Google's Secure AI Framework

简介 :

Google的Secure AI Framework(SAIF)是一个实践指南,旨在帮助从业者通过安全视角导航AI开发。它提供了一个框架,用于理解和应对AI开发过程中固有的安全风险,并提供了相应的控制措施来帮助解决这些问题。SAIF代表了Google在全球规模上防御AI的经验,强调了构建AI时的安全性和责任感。

需求人群 :

目标受众为AI开发者、数据科学家、安全专家和任何对AI安全感兴趣的个人或组织。SAIF提供了必要的工具和知识,帮助他们理解和应对AI开发中的安全挑战,确保他们的AI系统既安全又可靠。

使用场景

AI开发者使用SAIF框架来识别和缓解他们的AI系统中的潜在安全风险。

安全专家利用SAIF提供的资源来提高他们对AI安全威胁的理解,并制定相应的防御策略。

教育机构使用SAIF作为教学材料,帮助学生了解AI安全的重要性和实施方法。

产品特色

提供AI开发中的安全风险评估和控制措施

通过SAIF Map引导用户了解AI开发中的安全问题

提供AI安全风险的自我评估工具

分享Google在大规模防御AI方面的经验

提供资源和指导,帮助用户更好地理解和实施AI安全措施

使用教程

1. 访问SAIF官方网站并浏览首页内容,了解SAIF的概览和核心价值。

2. 通过点击'Explore the SAIF Map'开始探索AI开发中的安全问题。

3. 阅读关于AI安全风险的详细介绍,并了解如何通过控制措施来应对这些风险。

4. 利用'Risk Self Assessment'工具来评估你的组织可能面临的AI安全风险。

5. 浏览'Resources'部分,获取更多关于AI安全的深入信息和最佳实践。

6. 如果需要,可以通过提供的电子邮件地址提交反馈或询问更多关于SAIF的信息。

精选AI产品推荐

Pimeye

PimEyes是一款先进的面部识别搜索引擎和反向图像搜索工具,用于查找您的照片在哪些网站上发布。它使用面部识别技术进行反向图像搜索,帮助您找到图片中包含的面部,并保护您的隐私。它还可用于检测版权侵权。定价:PROtect计划。定位:帮助用户在互联网上追踪自己的面部,维护形象权益,并监控在线存在。

安全

876.6K

优质新品

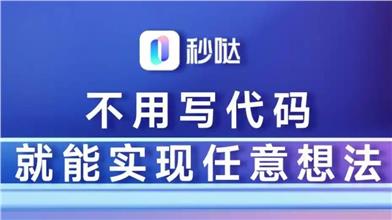

秒哒

秒哒是百度推出的零代码AI开发平台,它基于大模型和智能体技术,允许用户无需编写代码即可构建软件的能力。用户可以通过无代码编程、多智能体协作和规模化工具调用,轻松实现各种创意和想法。秒哒的主要优点包括0代码编程、多智能体协作、规模化工具调用、直观操作、创意实现、自动化流程和模块化构建。它适合需要快速开发和部署软件应用的企业、教育机构和个人开发者,无需具备编程知识即可使用。

开发平台

292.6K