Googleセキュアaiフレームワーク

紹介 :

GoogleのSecure AI Framework(SAIF)は、安全性の観点からAI開発を推進するための実践ガイドです。AI開発における固有のセキュリティリスクを理解し、対処するためのフレームワークを提供し、それらの問題解決に役立つ対策を示します。SAIFは、Googleがグローバル規模でAIを防御してきた経験を反映しており、AI構築における安全性と責任の重要性を強調しています。

ターゲットユーザー :

AI開発者、データサイエンティスト、セキュリティ専門家、その他AIセキュリティに関心のある個人や組織が対象です。SAIFは、AI開発におけるセキュリティ上の課題を理解し、対処し、安全で信頼性の高いAIシステムを構築するために必要なツールと知識を提供します。

使用シナリオ

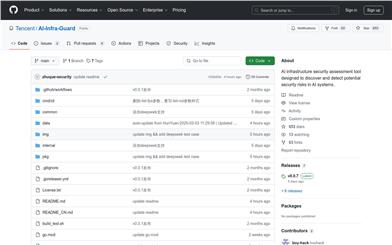

AI開発者はSAIFフレームワークを使用して、AIシステムにおける潜在的なセキュリティリスクを特定し、軽減します。

セキュリティ専門家は、SAIFが提供するリソースを活用して、AIセキュリティ脅威に対する理解を深め、適切な防御戦略を策定します。

教育機関は、SAIFを教材として使用し、学生にAIセキュリティの重要性と実装方法を理解させます。

製品特徴

AI開発におけるセキュリティリスクの評価と対策を提供

SAIFマップを通じてAI開発におけるセキュリティ上の問題を分かりやすく説明

AIセキュリティリスクの自己評価ツールを提供

Googleによる大規模なAI防御に関する経験を共有

AIセキュリティ対策の理解と実装を支援するリソースとガイダンスを提供

使用チュートリアル

1. SAIF公式ウェブサイトにアクセスし、トップページの内容を参照して、SAIFの概要と主要な価値を理解します。

2. 「SAIFマップを見る」をクリックして、AI開発におけるセキュリティ上の問題を探求します。

3. AIセキュリティリスクの詳細な説明を読み、対策によってどのようにリスクに対処できるか理解します。

4. 「リスク自己評価」ツールを使用して、組織が直面する可能性のあるAIセキュリティリスクを評価します。

5. 「リソース」セクションを参照して、AIセキュリティに関する詳細情報とベストプラクティスを入手します。

6. 必要に応じて、掲載されているメールアドレスからフィードバックを送信するか、SAIFに関する詳細についてお問い合わせください。

おすすめAI製品

Pimeyes

PimEyesは、写真がどのウェブサイトに掲載されているかを検索するための、高度な顔認証検索エンジンおよび逆画像検索ツールです。顔認証技術を用いた逆画像検索により、画像に含まれる顔を見つけ出し、プライバシーを守ることができます。また、著作権侵害の検出にも利用可能です。価格:PROtectプラン。ターゲット:インターネット上で自身の顔を追跡し、イメージ権を保護し、オンライン上の存在を監視したいユーザー。

安全

837.1K

文心インテリジェントエージェントプラットフォーム AgentBuilder

文心インテリジェントエージェントプラットフォーム AgentBuilderは、文心大規模言語モデルに基づいたエージェントプラットフォームです。開発者は、業界分野やアプリケーションシナリオに応じて、様々な開発方法を選択してインテリジェントエージェントを構築できます。主な利点として、低コスト開発、トラフィック配信経路のサポートがあり、ユーザーに製品開発の完全な閉ループを提供します。

開発プラットフォーム

258.1K