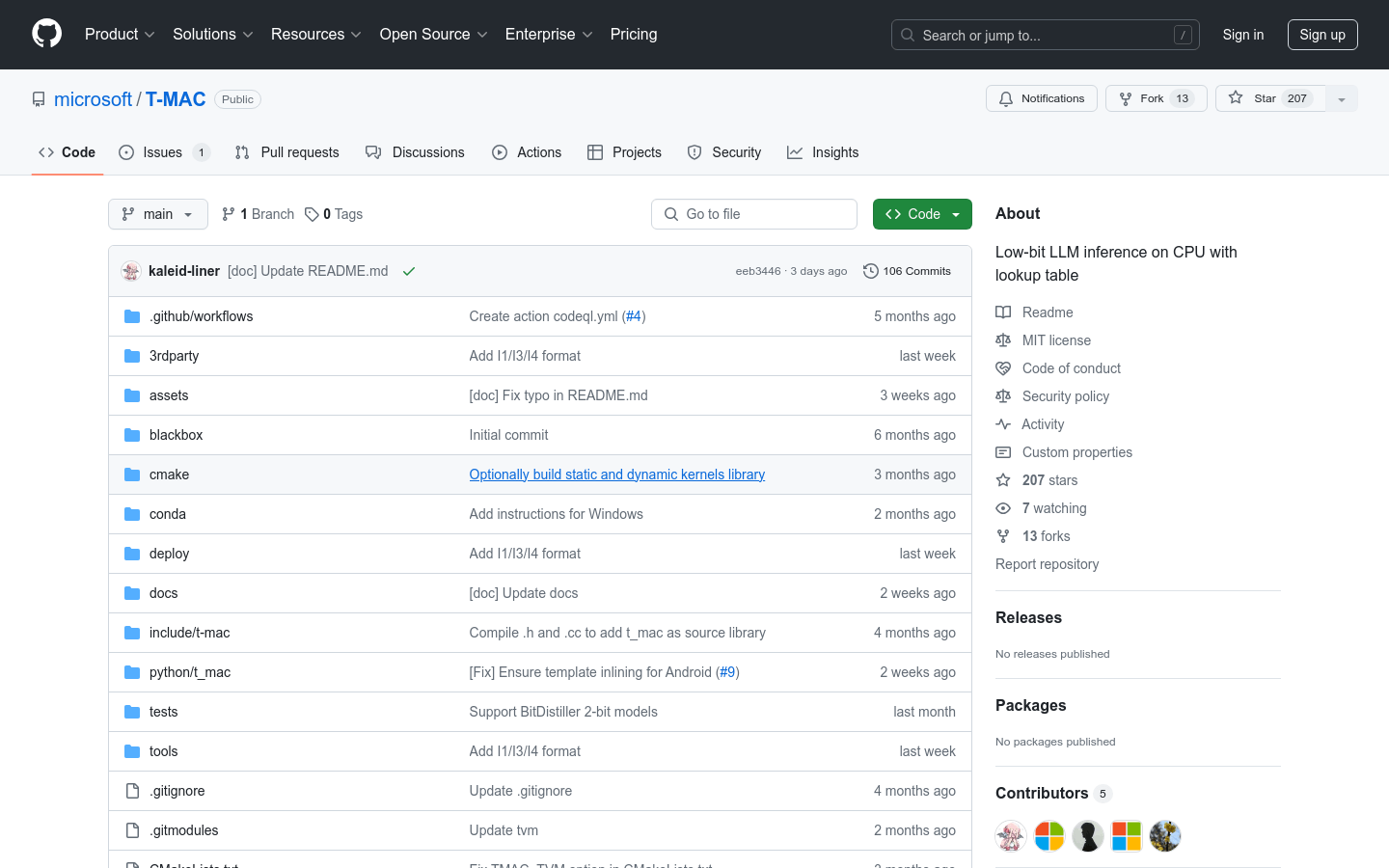

T MAC

简介 :

T-MAC是一个内核库,通过使用查找表直接支持混合精度矩阵乘法,无需去量化操作,旨在加速CPU上的低比特大型语言模型推理。它支持多种低比特模型,包括GPTQ/gguf的W4A16、BitDistiller/EfficientQAT的W2A16以及OSX/Linux/Windows上的ARM/Intel CPU的BitNet W1(.58)A8。T-MAC在Surface Laptop 7上实现了3B BitNet的令牌生成吞吐量,单核每秒20个,四核每秒48个,比现有最先进的CPU低比特框架(llama.cpp)快4~5倍。

需求人群 :

T-MAC主要面向需要在CPU上进行大型语言模型推理的开发者和企业,特别是那些寻求在边缘设备上实现实时或近实时推理性能的应用场景。它适用于需要优化能耗和计算资源的场合,如移动设备、嵌入式系统或任何资源受限的环境。

使用场景

在Surface Laptop 7上使用T-MAC进行3B BitNet模型的推理,实现了显著的速度提升。

在Snapdragon X Elite芯片上,通过T-MAC实现了与NPU相当的性能,同时减少了模型大小。

在Jetson AGX Orin上,T-MAC与CUDA GPU相比,在特定任务上展示了能耗优势。

产品特色

支持1/2/3/4位量化的Llama模型在GPTQ格式下的推理。

在最新的Snapdragon X Elite芯片上,T-MAC的令牌生成速度甚至超过了NPU。

原生支持Windows ARM上的部署,T-MAC在Surface Laptop 7上展示了显著的5倍速度提升。

通过使用查找表,T-MAC显著减少了CPU核心的使用,同时降低了功耗和能耗。

与NPU相比,在Snapdragon X Elite芯片上,T-MAC的CPU性能优于高通骁龙神经处理引擎(NPE)。

与CUDA GPU相比,在Jetson AGX Orin上,T-MAC的2位mpGEMM性能与CUDA GPU相当。

使用教程

安装Python环境,确保版本为3.8以满足TVM的要求。

根据操作系统的不同,安装cmake>=3.22和其他依赖项。

在虚拟环境中使用pip安装T-MAC,并激活相应的环境变量。

使用提供的工具脚本进行端到端推理,或与llama.cpp集成进行特定任务的推理。

根据需要调整参数,如使用-fa开启快速聚合以获得额外的速度提升。

精选AI产品推荐

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系统。它能够进行多模态推理,支持文本、图像、视频、音频和代码之间的无缝交互。Gemini在语言理解、推理、数学、编程等多个领域都超越了之前的状态,成为迄今为止最强大的AI系统之一。它有三个不同规模的版本,可满足从边缘计算到云计算的各种需求。Gemini可以广泛应用于创意设计、写作辅助、问题解答、代码生成等领域。

AI模型

11.4M

中文精选

Liblibai

LiblibAI是一个中国领先的AI创作平台,提供强大的AI创作能力,帮助创作者实现创意。平台提供海量免费AI创作模型,用户可以搜索使用模型进行图像、文字、音频等创作。平台还支持用户训练自己的AI模型。平台定位于广大创作者用户,致力于创造条件普惠,服务创意产业,让每个人都享有创作的乐趣。

AI模型

8.0M