Llama3v

简介 :

llama3v是一个基于Llama3 8B和siglip-so400m的SOTA(State of the Art,即最先进技术)视觉模型。它是一个开源的VLLM(视觉语言多模态学习模型),在Huggingface上提供模型权重,支持快速本地推理,并发布了推理代码。该模型结合了图像识别和文本生成,通过添加投影层将图像特征映射到LLaMA嵌入空间,以提高模型对图像的理解能力。

需求人群 :

目标受众为需要进行图像识别和文本生成的研究人员和开发者。他们可以利用llama3v模型进行图像特征提取和文本生成,从而在图像理解和多模态数据处理方面取得更好的效果。

使用场景

研究人员使用llama3v进行图像和文本的联合分析研究

开发者利用模型进行图像识别和自动标注

企业使用该模型进行产品图像的智能分类和检索

产品特色

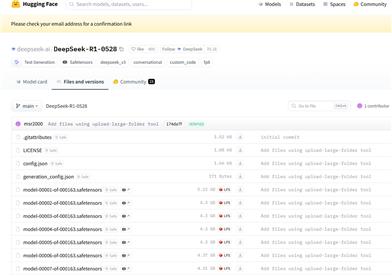

使用Huggingface提供的模型权重进行快速本地推理

结合siglip-so400m模型进行视觉识别

Llama3 8B模型用于多模态图像-文本输入和文本生成

在预训练过程中冻结除投影层外的所有权重

在微调过程中更新Llama3 8B模型权重,同时冻结siglip-so400m模型和投影层

生成合成多模态数据以增强多模态文本生成能力

使用教程

首先,从Huggingface下载llama3v模型权重

使用Transformers库导入AutoTokenizer和AutoModel

加载模型并将其转移到GPU上以加速计算

使用AutoTokenizer对输入图像进行编码

通过模型生成图像的文本描述

打印或进一步处理生成的文本输出

精选AI产品推荐

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系统。它能够进行多模态推理,支持文本、图像、视频、音频和代码之间的无缝交互。Gemini在语言理解、推理、数学、编程等多个领域都超越了之前的状态,成为迄今为止最强大的AI系统之一。它有三个不同规模的版本,可满足从边缘计算到云计算的各种需求。Gemini可以广泛应用于创意设计、写作辅助、问题解答、代码生成等领域。

AI模型

11.4M

中文精选

剪映dreamina

剪映Dreamina是抖音旗下的AIGC工具,用户可以根据文本内容生成由AI生成的创意图,支持修整图片大小比例和模板类型。未来会用于抖音的图文或短视频的内容创作,丰富抖音在AI创造方面的内容库。

AI图像生成

9.1M