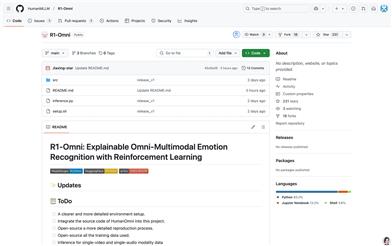

R1 Omni

簡介 :

R1-Omni 是一個創新的多模態情緒識別模型,通過強化學習提升模型的推理能力和泛化能力。該模型基於 HumanOmni-0.5B 開發,專注於情緒識別任務,能夠通過視覺和音頻模態信息進行情緒分析。其主要優點包括強大的推理能力、顯著提升的情緒識別性能以及在分佈外數據上的出色表現。該模型適用於需要多模態理解的場景,如情感分析、智能客服等領域,具有重要的研究和應用價值。

需求人群 :

該模型適用於研究人員和開發者,特別是那些需要處理多模態情緒識別任務的團隊。它可以幫助他們快速搭建和優化情緒識別系統,提升模型的性能和可解釋性。同時,該模型也可用於教育領域,幫助學生和研究人員更好地理解強化學習在多模態任務中的應用。

使用場景

在智能客服系統中,通過分析客戶語音和視頻中的情緒,提供更精準的服務。

在心理健康應用中,通過分析用戶的情緒表達,提供情緒疏導建議。

在視頻內容審核中,自動檢測視頻中的負面情緒,輔助人工審核。

產品特色

結合強化學習提升情緒識別的推理能力

支持全模態輸入(視頻、音頻)的情緒分析

提供詳細的推理過程,增強模型的可解釋性

在分佈外數據上表現出色,具有強大的泛化能力

支持多種預訓練模型的集成,如 Whisper 和 Siglip

提供詳細的訓練和推理代碼,便於開發者復現和擴展

支持多種情緒數據集的訓練和驗證,如 DFEW 和 MAFW

提供模型的詳細性能指標和可視化結果

使用教程

1. 下載並安裝相關依賴,包括 PyTorch 和多模態模型(如 Whisper、Siglip)。

2. 克隆 R1-Omni 代碼倉庫,並按照 README 文件中的說明設置環境。

3. 下載預訓練模型(如 HumanOmni-0.5B、R1-Omni 等)並配置路徑。

4. 使用 inference.py 文件進行單視頻或多模態輸入的情緒推理。

5. 根據需要調整模型配置文件(config.json),以適配不同的輸入數據。

6. 使用訓練代碼(如 train.py)進行模型的微調或自定義訓練。

7. 通過可視化工具(如 wandb)查看模型訓練和推理的結果。

8. 根據實際需求,將模型集成到具體的應用場景中,如智能客服或視頻分析系統。