Omniparser V2

簡介 :

OmniParser V2 是微軟研究團隊開發的一種先進的人工智能模型,旨在將大型語言模型(LLM)轉化為能夠理解和操作圖形用戶界面(GUI)的智能代理。該技術通過將界面截圖從像素空間轉換為可解釋的結構化元素,使 LLM 能夠更準確地識別可交互圖標,並在屏幕上執行預定動作。OmniParser V2 在檢測小圖標和快速推理方面取得了顯著進步,其結合 GPT-4o 在 ScreenSpot Pro 基準測試中達到了 39.6% 的平均準確率,遠超原始模型的 0.8%。此外,OmniParser V2 還提供了 OmniTool 工具,支持與多種 LLM 結合使用,進一步推動了 GUI 自動化的發展。

需求人群 :

OmniParser V2 適用於需要自動化圖形用戶界面操作的開發者和企業,尤其是那些希望利用大型語言模型實現智能交互的團隊。該技術能夠顯著提升 GUI 自動化的效率和準確性,降低開發成本,併為用戶提供更流暢的交互體驗。

使用場景

在自動化測試中,OmniParser V2 可以快速識別界面元素並執行測試腳本。

在智能客服場景中,OmniParser V2 能夠解析用戶界面並提供精準的操作建議。

結合 GPT-4o,OmniParser V2 在高分辨率屏幕的 GUI 接地任務中表現出色。

產品特色

將 UI 截圖轉換為結構化元素,便於 LLM 理解。

檢測小圖標並準確關聯屏幕上的交互區域。

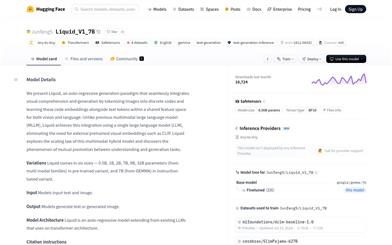

支持與多種 LLM(如 OpenAI、DeepSeek、Qwen 等)結合使用。

提供 OmniTool 工具,加速實驗和開發流程。

通過減少圖標標題模型的圖像大小,降低推理延遲。

使用教程

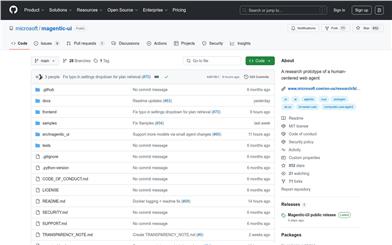

1. 從 GitHub 下載 OmniParser V2 的代碼。

2. 安裝 OmniTool 工具,配置所需的 LLM 環境。

3. 使用 OmniParser V2 對 UI 截圖進行解析,提取結構化元素。

4. 將解析結果輸入到所選的 LLM 中,生成交互指令。

5. 在目標系統中執行生成的指令,完成自動化任務。

精選AI產品推薦

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系統。它能夠進行多模態推理,支持文本、圖像、視頻、音頻和代碼之間的無縫交互。Gemini在語言理解、推理、數學、編程等多個領域都超越了之前的狀態,成為迄今為止最強大的AI系統之一。它有三個不同規模的版本,可滿足從邊緣計算到雲計算的各種需求。Gemini可以廣泛應用於創意設計、寫作輔助、問題解答、代碼生成等領域。

AI模型

11.4M

中文精選

Liblibai

LiblibAI是一箇中國領先的AI創作平臺,提供強大的AI創作能力,幫助創作者實現創意。平臺提供海量免費AI創作模型,用戶可以搜索使用模型進行圖像、文字、音頻等創作。平臺還支持用戶訓練自己的AI模型。平臺定位於廣大創作者用戶,致力於創造條件普惠,服務創意產業,讓每個人都享有創作的樂趣。

AI模型

8.0M