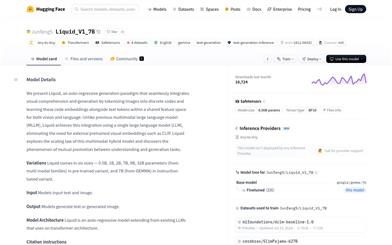

Internvl2 5 26B

簡介 :

InternVL2_5-26B是一個先進的多模態大型語言模型(MLLM),在InternVL 2.0的基礎上,通過引入顯著的訓練和測試策略增強以及數據質量提升,進一步發展而來。該模型保持了其前身的“ViT-MLP-LLM”核心模型架構,並集成了新增量預訓練的InternViT與各種預訓練的大型語言模型(LLMs),例如InternLM 2.5和Qwen 2.5,使用隨機初始化的MLP投影器。InternVL 2.5系列模型在多模態任務中展現出卓越的性能,尤其在視覺感知和多模態能力方面。

需求人群 :

目標受眾為研究人員、開發者和企業,特別是那些需要在多模態任務中結合視覺和語言信息以提升性能的用戶。InternVL2_5-26B因其先進的模型架構和強大的多模態處理能力,適合於需要進行圖像識別、視頻理解和多語言交互的複雜應用場景。

使用場景

使用InternVL2_5-26B進行圖像描述和理解,提升圖像檢索系統的準確性。

在視頻內容分析中應用InternVL2_5-26B,實現視頻內容的自動標註和分類。

通過InternVL2_5-26B進行多語言圖像標註,增強跨語言的圖像識別能力。

產品特色

• 模型架構:遵循'ViT-MLP-LLM'範式,集成了視覺Transformer和語言模型。

• 訓練策略:包括動態高分辨率訓練方法,以及分階段訓練以增強模型的視覺感知和多模態能力。

• 多模態理解:支持圖像、視頻和多語言數據,提供綜合的多模態和幻覺評估。

• 數據組織:通過關鍵參數控制訓練數據的組織,優化數據平衡和分佈。

• 快速啟動:提供示例代碼,方便用戶使用transformers庫快速運行模型。

• 微調與部署:支持模型的微調和部署,使用LMDeploy工具包簡化部署流程。

• 多輪對話:支持基於圖像和視頻的多輪對話,增強交互體驗。

使用教程

1. 安裝transformers庫:確保已安裝transformers庫,版本需大於等於4.37.2。

2. 加載模型:使用AutoModel.from_pretrained方法加載InternVL2_5-26B模型。

3. 數據預處理:對輸入的圖像或視頻數據進行必要的預處理,包括尺寸調整和歸一化。

4. 模型推理:將預處理後的數據輸入模型,進行推理以獲取結果。

5. 結果分析:根據模型輸出的結果進行分析,應用於具體的業務場景。

6. 微調模型:如有需要,可以在特定數據集上對模型進行微調,以適應特定的應用需求。

7. 部署模型:使用LMDeploy工具包將模型部署為服務,提供API接口供其他應用調用。

精選AI產品推薦

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系統。它能夠進行多模態推理,支持文本、圖像、視頻、音頻和代碼之間的無縫交互。Gemini在語言理解、推理、數學、編程等多個領域都超越了之前的狀態,成為迄今為止最強大的AI系統之一。它有三個不同規模的版本,可滿足從邊緣計算到雲計算的各種需求。Gemini可以廣泛應用於創意設計、寫作輔助、問題解答、代碼生成等領域。

AI模型

11.4M

中文精選

Liblibai

LiblibAI是一箇中國領先的AI創作平臺,提供強大的AI創作能力,幫助創作者實現創意。平臺提供海量免費AI創作模型,用戶可以搜索使用模型進行圖像、文字、音頻等創作。平臺還支持用戶訓練自己的AI模型。平臺定位於廣大創作者用戶,致力於創造條件普惠,服務創意產業,讓每個人都享有創作的樂趣。

AI模型

8.0M