Olmoe

簡介 :

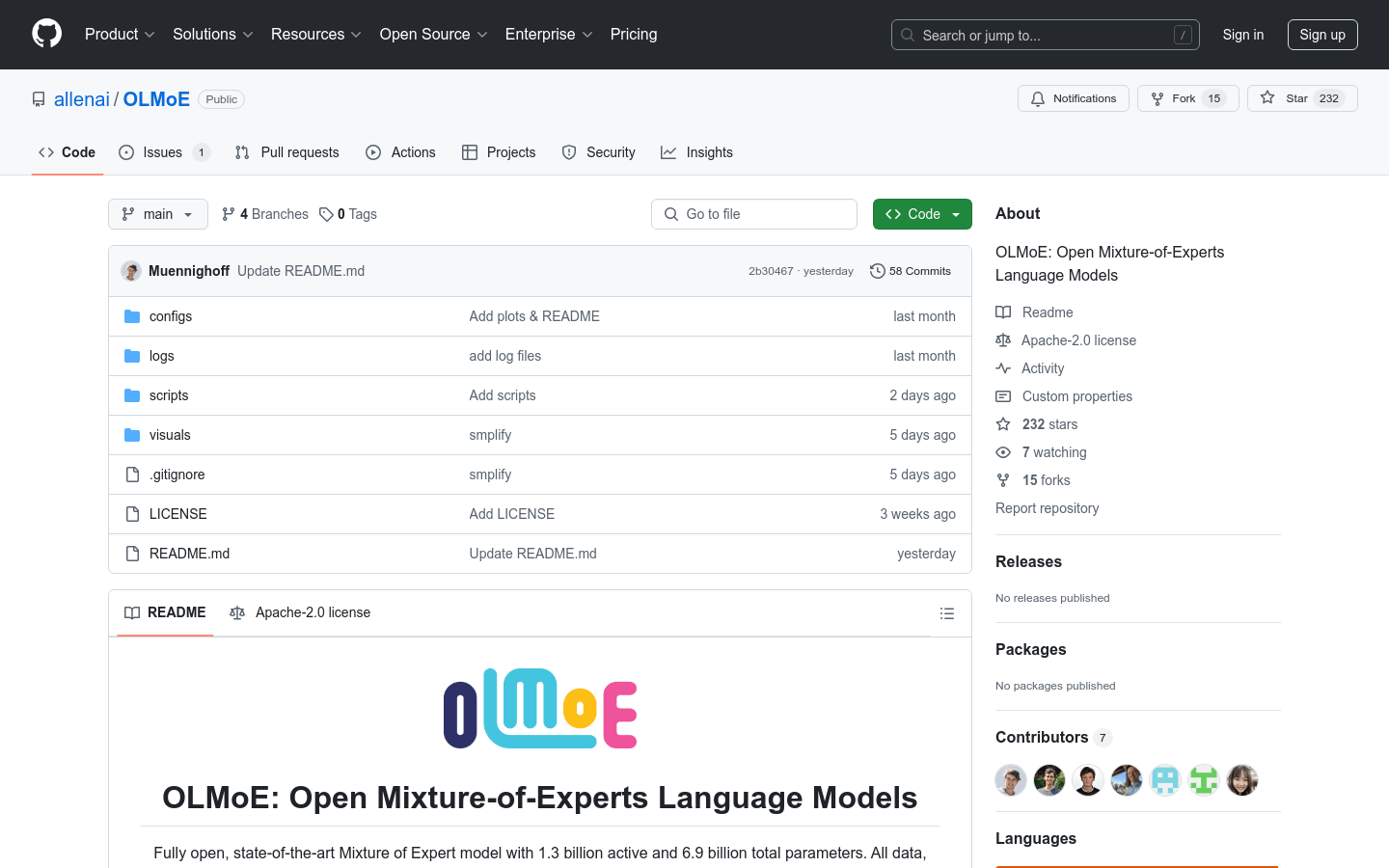

OLMoE是一個完全開放的、最先進的專家混合模型,具有1.3億活躍參數和6.9億總參數。該模型的所有數據、代碼和日誌都已發佈。它提供了論文'OLMoE: Open Mixture-of-Experts Language Models'的所有資源概覽。該模型在預訓練、微調、適應和評估方面都具有重要應用,是自然語言處理領域的一個里程碑。

需求人群 :

OLMoE適合自然語言處理領域的研究人員和開發者,尤其是那些需要處理大規模數據和複雜語言任務的用戶。它的強大計算能力和靈活性使其成為研究和開發先進語言模型的理想選擇。

使用場景

用於構建聊天機器人,提供流暢的對話體驗。

在文本生成任務中,如文章寫作或內容創作,提供高質量的輸出。

在機器翻譯領域,實現跨語言的準確翻譯。

產品特色

支持大規模參數的自然語言處理。

提供預訓練、微調和適應階段的檢查點、代碼、數據和日誌。

支持多種語言和領域的模型適應。

提供詳細的訓練和評估工具。

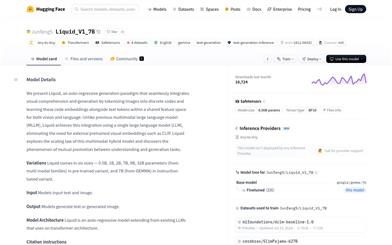

支持通過Hugging Face Hub訪問和使用模型。

提供可視化工具,幫助理解模型結構和性能。

使用教程

首先,安裝必要的庫,如transformers和torch。

通過Hugging Face Hub獲取模型和分詞器。

準備輸入數據,並將其轉換為模型可接受的格式。

調用模型的generate方法生成輸出。

使用分詞器將生成的輸出解碼為可讀文本。

根據需要調整模型參數,以優化性能。

通過可視化工具分析模型的性能和結構。

精選AI產品推薦

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系統。它能夠進行多模態推理,支持文本、圖像、視頻、音頻和代碼之間的無縫交互。Gemini在語言理解、推理、數學、編程等多個領域都超越了之前的狀態,成為迄今為止最強大的AI系統之一。它有三個不同規模的版本,可滿足從邊緣計算到雲計算的各種需求。Gemini可以廣泛應用於創意設計、寫作輔助、問題解答、代碼生成等領域。

AI模型

11.4M

中文精選

Liblibai

LiblibAI是一箇中國領先的AI創作平臺,提供強大的AI創作能力,幫助創作者實現創意。平臺提供海量免費AI創作模型,用戶可以搜索使用模型進行圖像、文字、音頻等創作。平臺還支持用戶訓練自己的AI模型。平臺定位於廣大創作者用戶,致力於創造條件普惠,服務創意產業,讓每個人都享有創作的樂趣。

AI模型

8.0M