Jockey

簡介 :

Jockey是一個基於Twelve Labs API和LangGraph構建的對話式視頻代理。它將現有的大型語言模型(Large Language Models, LLMs)的能力與Twelve Labs的API結合使用,通過LangGraph進行任務分配,將複雜視頻工作流程的負載分配給適當的基礎模型。LLMs用於邏輯規劃執行步驟並與用戶交互,而與視頻相關的任務則傳遞給由視頻基礎模型(Video Foundation Models, VFMs)支持的Twelve Labs API,以原生方式處理視頻,無需像預先生成的字幕這樣的中介表示。

需求人群 :

Jockey主要面向需要處理複雜視頻工作流程的開發者和團隊,尤其是那些希望利用大型語言模型來增強視頻內容創作和編輯流程的用戶。它適合需要高度自定義和自動化視頻處理任務的專業用戶。

使用場景

視頻編輯團隊使用Jockey自動化視頻剪輯和字幕生成。

內容創作者利用Jockey生成視頻草稿和故事板。

教育機構使用Jockey創建交互式視頻教程。

產品特色

結合大型語言模型與視頻處理API進行復雜視頻工作流程的負載分配。

使用LangGraph進行任務分配,提高視頻處理效率。

通過LLMs邏輯規劃執行步驟,增強用戶交互體驗。

無需中介表示,直接利用視頻基礎模型處理視頻任務。

支持自定義和擴展,以適應不同的視頻相關用例。

提供終端和LangGraph API服務器部署選項,靈活適應開發和測試需求。

使用教程

1. 安裝必要的外部依賴,如FFMPEG、Docker和Docker Compose。

2. 克隆Jockey的GitHub倉庫到本地環境。

3. 創建並激活Python虛擬環境,安裝所需的Python包。

4. 配置.env文件,添加必要的API密鑰和環境變量。

5. 使用Docker Compose部署Jockey API服務器。

6. 通過終端運行Jockey實例進行測試或使用LangGraph API服務器進行端到端部署。

7. 使用LangGraph Debugger UI進行調試和端到端測試。

精選AI產品推薦

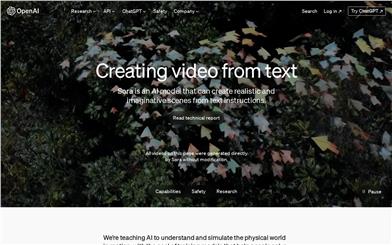

Sora

Sora是一個基於大規模訓練的文本控制視頻生成擴散模型。它能夠生成長達1分鐘的高清視頻,涵蓋廣泛的視覺數據類型和分辨率。Sora通過在視頻和圖像的壓縮潛在空間中訓練,將其分解為時空位置補丁,實現了可擴展的視頻生成。Sora還展現出一些模擬物理世界和數字世界的能力,如三維一致性和交互,揭示了繼續擴大視頻生成模型規模來發展高能力模擬器的前景。

AI視頻生成

17.2M

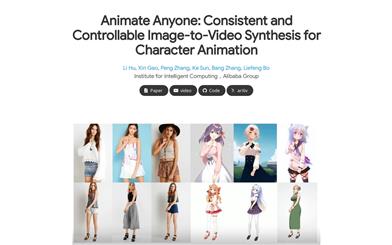

Animate Anyone

Animate Anyone旨在通過驅動信號從靜態圖像生成角色視頻。我們利用擴散模型的力量,提出了一個專為角色動畫量身定製的新框架。為了保持參考圖像中複雜外觀特徵的一致性,我們設計了ReferenceNet來通過空間注意力合併詳細特徵。為了確保可控性和連續性,我們引入了一個高效的姿勢指導器來指導角色的動作,並採用了一種有效的時間建模方法,以確保視頻幀之間的平滑跨幀過渡。通過擴展訓練數據,我們的方法可以為任意角色製作動畫,與其他圖像到視頻方法相比,在角色動畫方面取得了出色的結果。此外,我們在時尚視頻和人類舞蹈合成的基準上評估了我們的方法,取得了最先進的結果。

AI視頻生成

11.8M