使用場景

時尚設計師使用TryOnDiffusion預覽新款服裝在模特身上的效果

服裝零售商利用該技術為客戶提供個性化的試穿體驗

消費者通過TryOnDiffusion在線試穿服裝,做出購買決策

產品特色

基於擴散架構的服裝試穿可視化生成

通過交叉注意力機制隱式變形服裝

統一過程中實現服裝變形和人物融合,而非兩個獨立任務

在128×128和256×256分辨率下分別進行圖像處理

使用線性層和注意力機制融合人物和服裝的姿態嵌入

通過FiLM在所有尺度上調節兩個UNets的特徵

支持多人試穿同一服裝和同一人試穿不同服裝的場景

使用教程

步驟1: 準備一張目標人物的圖片和一張服裝圖片

步驟2: 對人物圖片進行分割,創建“服裝無關的RGB”圖像

步驟3: 對服裝圖片進行分割,並計算人物和服裝的姿態

步驟4: 將處理好的輸入數據送入128×128 Parallel-UNet進行初步圖像生成

步驟5: 將生成的128x128試穿圖像與條件輸入一起送入256×256 Parallel-UNet

步驟6: 從256×256 Parallel-UNet獲取輸出,並進行標準超分辨率擴散處理,生成1024×1024的圖像

步驟7: 根據需要調整和優化生成的試穿效果

精選AI產品推薦

中文精選

剪映dreamina

剪映Dreamina是抖音旗下的AIGC工具,用戶可以根據文本內容生成由AI生成的創意圖,支持修整圖片大小比例和模板類型。未來會用於抖音的圖文或短視頻的內容創作,豐富抖音在AI創造方面的內容庫。

AI圖像生成

9.1M

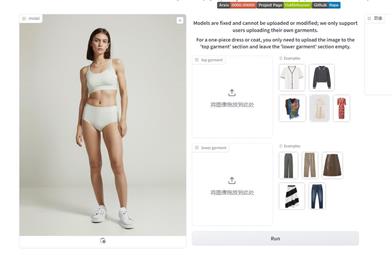

Outfit Anyone

Outfit Anyone 是一款超高質量虛擬試穿產品,使用戶能夠在不真實試穿衣物的情況下嘗試不同的時尚款式。通過採用兩個流的條件擴散模型,Outfit Anyone 能夠靈活處理衣物變形,生成更逼真的效果。它具備可擴展性,可以調整姿勢和身體形狀等因素,適用於動漫角色到真實人物的圖像。Outfit Anyone 在各種場景下的表現突出了其實用性和準備好投入實際應用的程度。

AI圖像生成

5.7M