中国語精選

混元T1

混元T1はテンセントが発表した超大規模推論モデルであり、強化学習技術に基づいており、大量の後訓練によって推論能力を大幅に向上させています。長文処理とコンテキストの把握において優れた性能を発揮し、計算資源の消費も最適化されており、効率的な推論能力を備えています。あらゆる種類の推論タスクに適用でき、特に数学、論理推論などの分野で優れた性能を発揮します。本製品は深層学習をベースとしており、実際のフィードバックを参考に継続的に最適化されており、研究、教育など複数の分野での応用に向いています。

AIモデル

42.0K

中国語精選

混元T1

混元T1は、テンセントが開発した強化学習に基づく深層推論大規模モデルです。大規模な事後学習と人間の好みの調整により、推論能力と効率が大幅に向上しています。大規模なHybrid-Transformer-Mamba MoEアーキテクチャに基づいており、長文の処理において優れたパフォーマンスを発揮します。複雑な推論と論理的な解決策を必要とするあらゆるユーザーに適しており、科学研究や技術開発を支援します。

AIモデル

47.2K

混元T1

混元T1は、強化学習に基づく超大規模推論モデルであり、事後学習によって推論能力を大幅に向上させ、人間の好みと整合性をとっています。本モデルは長文の処理と複雑な推論タスクに特化しており、顕著な性能上の優位性を示しています。

人工知能

41.4K

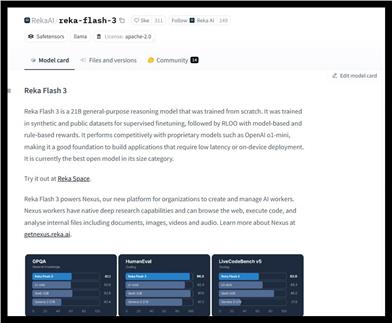

Reka Flash 3

Reka Flash 3は、ゼロからトレーニングされた21億パラメーターの汎用推論モデルです。合成データセットと公開データセットを使用して教師ありファインチューニングを行い、モデルベースとルールベースの報酬を組み合わせて強化学習を行います。このモデルは、低遅延とデバイスエンドの展開アプリケーションにおいて優れたパフォーマンスを発揮し、強力な研究能力を備えています。現在、同種のオープンソースモデルの中で最良の選択肢であり、様々な自然言語処理タスクやアプリケーションシナリオに適しています。

AIモデル

43.9K

EXAONE Deep

EXAONE Deepは、LG AI Researchが発表した高度な推論AIモデルであり、韓国のグローバルAI市場における競争力を示すものです。32億個のパラメーターを備え、卓越した性能を発揮し、特に数学や科学の問題解決において優れた成果を示します。このモデルの発表により、LGはAI分野において自律的な意思決定の時代に入りました。オープンソースであるため、より多くの開発者がこの技術を利用して研究開発を行うことができます。EXAONE Deepは軽量でオンデバイスモデル設計であるため、教育、科学研究、プログラミングなど、複数の業界で使用できます。

AIモデル

48.9K

Steiner 32b Preview

Steinerは、Yichao 'Peak' Jiによって開発された推論モデルシリーズであり、強化学習による合成データ上でのトレーニングに焦点を当てており、推論時に複数の経路を探索し、自律的に検証または遡ることができます。このモデルの目標は、OpenAI o1の推論能力を再現し、推論時の拡張曲線を検証することです。Steiner-previewは進行中のプロジェクトであり、オープンソースとする目的は知識を共有し、より多くのリアルユーザーからのフィードバックを得ることです。このモデルはいくつかのベンチマークテストで優れたパフォーマンスを示していますが、OpenAI o1の推論拡張能力を完全に実現しているわけではなく、開発段階にあります。

AIモデル

45.5K

UIGEN T1 Qwen 7b

UIGEN-T1-Qwen-7bは、UI推論生成に特化した大規模言語モデルです。複雑な推論チェーン手法を用いてHTMLとCSSベースのUIコンポーネントを生成し、フロントエンド開発において迅速なレイアウト生成ソリューションを提供します。Qwen2.5-Coder-7B-Instructをファインチューニングしたモデルであり、ダッシュボード、ログインページ、登録フォームなどの基本的なフロントエンドアプリケーションの生成に特化しています。主な利点は、構造化されたHTML/CSSコードを迅速に生成し、推論を通じてデザイン原則に沿ったUIレイアウトを生成できる点です。主な用途は、フロントエンド開発プロセスの簡素化、開発効率の向上、ローコード/ノーコードツールへのサポートです。

AI設計ツール

49.4K

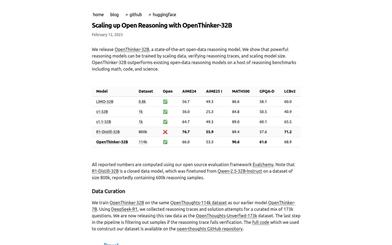

Openthinker 32B

OpenThinker-32Bは、Open Thoughtsチームによって開発されたオープンソース推論モデルです。データ規模の拡大、推論パスの検証、モデルサイズの拡大を通じて、強力な推論能力を実現しています。このモデルは、数学、コード、科学などの推論ベンチマークテストで優れた性能を示し、既存のオープンデータ推論モデルを凌駕しています。主な利点としては、オープンソースデータ、高性能、拡張性などが挙げられます。このモデルはQwen2.5-32B-Instructをファインチューニングし、大規模データセットでトレーニングされており、研究者や開発者に強力な推論ツールを提供することを目的としています。

AIモデル

51.1K

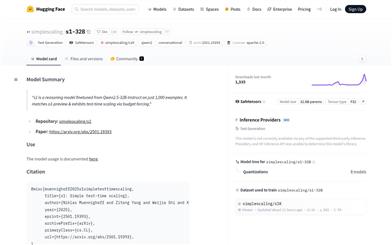

S1 32B

s1は、少量のサンプルで効率的なテキスト生成能力を実現することに重点を置いた推論モデルです。予算強制技術を用いてテスト時に拡張することで、o1-previewと同等の性能を達成します。このモデルはNiklas Muennighoff氏らによって開発され、関連研究はarXivに掲載されています。Safetensors技術を採用しており、328億パラメータを備え、テキスト生成タスクに対応します。主な利点は、少量のサンプルで高品質な推論を実現できることであり、効率的なテキスト生成が必要なシナリオに適しています。

ライティングアシスタント

61.5K

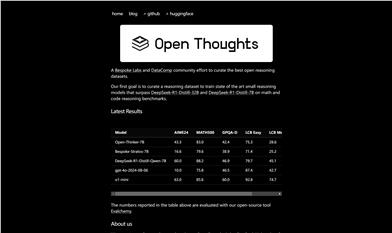

Open Thoughts

Open Thoughtsは、Bespoke LabsとDataCompコミュニティが主導するプロジェクトであり、高度な小規模モデルのトレーニングに使用される、高品質のオープンソース推論データセットを整理することを目的としています。スタンフォード大学、カリフォルニア大学バークレー校、ワシントン大学など、多くの大学や研究機関の研究者やエンジニアが集まり、質の高いデータセットを通じて推論モデルの発展を促進することに取り組んでいます。その背景には、数学やコード推論などにおける推論モデルの需要の高まりがあり、高品質なデータセットはモデル性能向上のための鍵となります。現在、このプロジェクトは無料で公開されており、主に研究者、開発者、そして推論モデルに関心のある専門家を対象としています。データセットとツールのオープンソース性により、人工知能教育と研究を推進するための重要なリソースとなっています。

AIモデル

46.1K

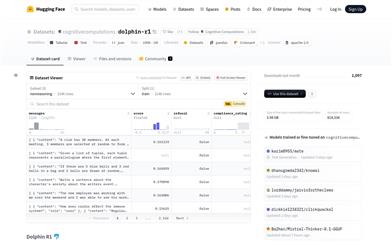

Dolphin R1

Dolphin R1は、Cognitive Computationsチームによって作成されたデータセットであり、DeepSeek-R1 Distillモデルのような推論モデルのトレーニングを目的としています。このデータセットには、DeepSeek-R1からの30万件の推論サンプル、Gemini 2.0 flash thinkingからの30万件の推論サンプル、そしてDolphinチャットからの20万件のサンプルが含まれています。これらのデータセットの組み合わせにより、研究者や開発者は豊富なトレーニングリソースを取得し、モデルの推論能力と対話能力の向上に役立ちます。このデータセットの作成は、Dria、Chutes、Crusoe Cloudなどの複数企業の支援を受けており、これらのスポンサーはデータセットの開発に計算リソースと資金を提供しています。Dolphin R1データセットの公開は、自然言語処理分野の研究開発に重要な基盤を提供し、関連技術の発展を促進します。

AIモデル

48.6K

海外精選

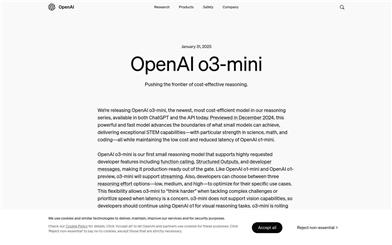

Openai O3 Mini

OpenAI o3-miniは、OpenAIが発表した最新の推論モデルであり、科学、技術、工学、数学(STEM)分野向けに最適化されています。低コストと低遅延を維持しながら、強力な推論能力を提供し、特に数学、科学、プログラミングにおいて優れた性能を発揮します。関数呼び出し、構造化出力などの多様な開発者向け機能をサポートしており、必要に応じて異なる推論強度を選択できます。o3-miniの登場により、推論モデルの使用コストがさらに低減され、幅広い用途に適しています。

AIモデル

71.5K

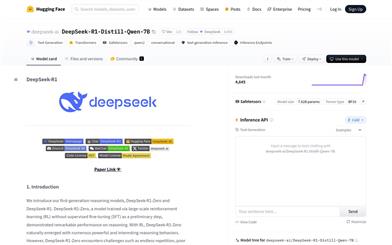

Deepseek R1 Distill Qwen 7B

DeepSeek-R1-Distill-Qwen-7Bは、Qwen-7Bを蒸留最適化し、強化学習によって最適化された推論モデルです。数学、コード、推論タスクにおいて優れた性能を発揮し、高品質な推論チェーンと解決策を生成できます。大規模な強化学習とデータ蒸留技術により、推論能力と効率性が大幅に向上しており、複雑な推論と論理分析が必要なシナリオに適しています。

モデルトレーニングとデプロイメント

137.2K

中国語精選

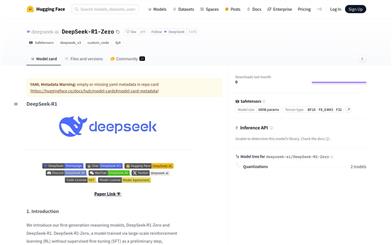

Deepseek R1 Zero

DeepSeek-R1-Zeroは、DeepSeekチームが開発した推論モデルであり、強化学習を通じてモデルの推論能力向上に焦点を当てています。このモデルは、教師なし微調整なしで、自己検証、熟考、長鎖推論生成などの強力な推論行動を示します。主な利点としては、効率的な推論能力、事前学習なしで使用できること、数学、コード、推論タスクにおける卓越した性能が挙げられます。DeepSeek-V3アーキテクチャに基づいて開発されており、大規模な推論タスクに対応し、研究および商業用途に適しています。

AIモデル

89.7K

中国語精選

Deepseek R1

DeepSeek-R1は、DeepSeekチームが開発した第1世代の推論モデルです。大規模な強化学習によって訓練されており、教師なし微調整なしで優れた推論能力を発揮します。数学、コード、推論タスクにおいて優れた性能を示し、OpenAI-o1モデルと同等の能力を有しています。DeepSeek-R1は、様々な規模と性能要件に対応する複数の蒸留モデルも提供しています。オープンソースであるため、研究コミュニティに強力なツールを提供し、商用利用と二次開発をサポートします。

AIモデル

449.3K

海外精選

Openai O3

OpenAI o3モデルは、o1に続く次世代推論モデルであり、o3とo3-miniの2つのバージョンがあります。o3は特定の条件下において汎用人工知能(AGI)に近づいており、ARC-AGIベンチマークテストで87.5%という高得点を記録し、人間の平均を大きく上回っています。数学とプログラミングのタスクにおいて卓越した性能を発揮し、2024年アメリカ数学コンテスト(AIME)で96.7%、Codeforcesランキングで2727点を達成しました。o3は自己ファクトチェック機能を備え、「プライベート思考チェーン」を用いた推論により、回答の正確性を向上させています。o3は安全原則を遵守するために「審議的アライメント」技術を用いてトレーニングされた最初のモデルです。現在、o3モデルは広く利用可能ではありませんが、セキュリティ研究者はo3-miniモデルのプレビューに登録できます。o3 mini版は1月末にリリースされ、その後すぐにo3完全版がリリースされる予定です。

AIモデル

70.7K

中国語精選

Internthinker

InternThinkerは、上海人工知能研究所(上海AI研究所)が開発した高推論AIモデルです。「通専融合」アプローチを通じて、開放的、制御可能、信頼性の高い汎用人工知能(AGI)の探求を目指しています。本モデルは、長期的な思考能力を備え、推論プロセスにおいて自己省察と修正を行うことで、数学、コード、推論パズルなど、様々な複雑な推論タスクにおいてより優れた結果を得ることができます。InternThinkerの革新的な点は、メタアクション思考能力です。高知的密度データを自律的に生成し、大規模なサンドボックス環境からフィードバックを得ることで、高品質な思考連鎖を独立して構築し、モデルの複雑なタスク処理性能を大幅に向上させます。

AIモデル

50.8K

Marco O1

Marco-o1は、Chain-of-Thought (CoT)ファインチューニング、モンテカルロ木探索 (MCTS)、反射機構、そして革新的な推論戦略などの高度な技術を用いて、複雑な現実世界の課題解決を最適化する、オープンな大規模推論モデルです。標準的な解答を持つ数学、物理、プログラミングなどの分野だけでなく、開放的な問題解決にも重点を置いています。アリババ国際デジタルビジネスのMarcoPoloチームによって開発されたMarco-o1は、強力な推論能力を備え、複数の分野で卓越した性能を示しています。

機械学習

59.1K

おすすめAI製品

海外精選

Jules AI

Jules は、自動で煩雑なコーディングタスクを処理し、あなたに核心的なコーディングに時間をかけることを可能にする異步コーディングエージェントです。その主な強みは GitHub との統合で、Pull Request(PR) を自動化し、テストを実行し、クラウド仮想マシン上でコードを検証することで、開発効率を大幅に向上させています。Jules はさまざまな開発者に適しており、特に忙しいチームには効果的にプロジェクトとコードの品質を管理する支援を行います。

開発プログラミング

39.2K

Nocode

NoCode はプログラミング経験を必要としないプラットフォームで、ユーザーが自然言語でアイデアを表現し、迅速にアプリケーションを生成することが可能です。これにより、開発の障壁を下げ、より多くの人が自身のアイデアを実現できるようになります。このプラットフォームはリアルタイムプレビュー機能とワンクリックデプロイ機能を提供しており、技術的な知識がないユーザーにも非常に使いやすい設計となっています。

開発プラットフォーム

38.9K

Listenhub

ListenHub は軽量級の AI ポッドキャストジェネレーターであり、中国語と英語に対応しています。最先端の AI 技術を使用し、ユーザーが興味を持つポッドキャストコンテンツを迅速に生成できます。その主な利点には、自然な会話と超高品質な音声効果が含まれており、いつでもどこでも高品質な聴覚体験を楽しむことができます。ListenHub はコンテンツ生成速度を改善するだけでなく、モバイルデバイスにも対応しており、さまざまな場面で使いやすいです。情報取得の高効率なツールとして位置づけられており、幅広いリスナーのニーズに応えています。

AI

38.1K

中国語精選

腾讯混元画像 2.0

腾讯混元画像 2.0 は腾讯が最新に発表したAI画像生成モデルで、生成スピードと画質が大幅に向上しました。超高圧縮倍率のエンコード?デコーダーと新しい拡散アーキテクチャを採用しており、画像生成速度はミリ秒級まで到達し、従来の時間のかかる生成を回避することが可能です。また、強化学習アルゴリズムと人間の美的知識の統合により、画像のリアリズムと詳細表現力を向上させ、デザイナー、クリエーターなどの専門ユーザーに適しています。

画像生成

38.1K

Openmemory MCP

OpenMemoryはオープンソースの個人向けメモリレイヤーで、大規模言語モデル(LLM)に私密でポータブルなメモリ管理を提供します。ユーザーはデータに対する完全な制御権を持ち、AIアプリケーションを作成する際も安全性を保つことができます。このプロジェクトはDocker、Python、Node.jsをサポートしており、開発者が個別化されたAI体験を行うのに適しています。また、個人情報を漏らすことなくAIを利用したいユーザーにお勧めします。

オープンソース

38.9K

Fastvlm

FastVLM は、視覚言語モデル向けに設計された効果的な視覚符号化モデルです。イノベーティブな FastViTHD ミックスドビジュアル符号化エンジンを使用することで、高解像度画像の符号化時間と出力されるトークンの数を削減し、モデルのスループットと精度を向上させました。FastVLM の主な位置付けは、開発者が強力な視覚言語処理機能を得られるように支援し、特に迅速なレスポンスが必要なモバイルデバイス上で優れたパフォーマンスを発揮します。

画像処理

38.1K

海外精選

ピカ

ピカは、ユーザーが自身の創造的なアイデアをアップロードすると、AIがそれに基づいた動画を自動生成する動画制作プラットフォームです。主な機能は、多様なアイデアからの動画生成、プロフェッショナルな動画効果、シンプルで使いやすい操作性です。無料トライアル方式を採用しており、クリエイターや動画愛好家をターゲットとしています。

映像制作

17.6M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M