MILS

MILSは、Facebook Researchが公開したオープンソースプロジェクトです。事前学習済みのモデルと最適化アルゴリズムを活用することで、画像、音声、動画の自動記述生成能力を、いかなる訓練も受けていない大規模言語モデル(LLM)が有することを示すことを目的としています。この技術は、マルチモーダルAIの発展に新たな視点をもたらし、LLMのクロスモーダルタスクにおける潜在能力を示しています。このモデルは主に研究者や開発者を対象としており、マルチモーダルアプリケーションを探求するための強力なツールを提供します。現在、このプロジェクトは無料でオープンソースとして公開されており、学術研究と技術開発の促進を目指しています。

AIモデル

46.6K

Timesfm 2.0 500m Pytorch

TimesFMは、Google Researchが開発した、時系列予測タスク向けの事前学習済み時系列予測モデルです。複数のデータセットで事前学習されており、様々な頻度と長さの時系列データを処理できます。主な利点として、高性能、高い拡張性、使いやすさが挙げられます。金融、気象、エネルギーなど、時系列データの正確な予測が必要な様々な用途に適しています。Hugging Faceプラットフォームで無料で提供されており、ユーザーは簡単にダウンロードして使用できます。

AIモデル

59.3K

Openemma

OpenEMMAは、WaymoのEMMAモデルを再現したオープンソースプロジェクトです。自動運転車両のモーションプランニングのためのエンドツーエンドフレームワークを提供します。このモデルは、GPT-4やLLaVAなどの事前学習済みの視覚言語モデル(VLMs)を利用し、テキストと前方のカメラ入力を取り込むことで、車両自身の将来の経路点の正確な予測を実現し、その意思決定の根拠も提示します。OpenEMMAの目標は、研究者や開発者が自動運転研究と応用を推進するための使いやすいツールを提供することです。

モデルトレーニングとデプロイメント

48.6K

Syncammaster

SynCamMasterは、多様な視点からマルチカメラ動画を同期して生成できる、高度な動画生成技術です。この技術は、事前学習済みのテキストから動画へのモデルを用いて、異なる視点における動画コンテンツの動的な整合性を向上させます。バーチャル撮影などのアプリケーションシナリオにおいて重要な意味を持ちます。主な利点としては、オープンワールド動画の任意の視点からの生成、6自由度カメラ姿勢の統合、そして多カメラ画像と単眼動画を補完的に利用する漸進的トレーニングスキームの設計によるモデル性能の顕著な向上などが挙げられます。

映像制作

51.3K

Internvl2 5 26B

InternVL2_5-26Bは、InternVL 2.0をベースに、大幅なトレーニングとテスト戦略の強化、データ品質の向上によって発展させた、高度なマルチモーダル大規模言語モデル(MLLM)です。本モデルは、前身の「ViT-MLP-LLM」の中核モデルアーキテクチャを保持しており、新たに増量プレトレーニングされたInternViTと、InternLM 2.5やQwen 2.5などの様々なプレトレーニング済み大規模言語モデル(LLM)を、ランダム初期化されたMLPプロジェクタを用いて統合しています。InternVL2 2.5シリーズのモデルは、マルチモーダルタスク、特に視覚認識とマルチモーダル能力において優れた性能を発揮しています。

AIモデル

53.3K

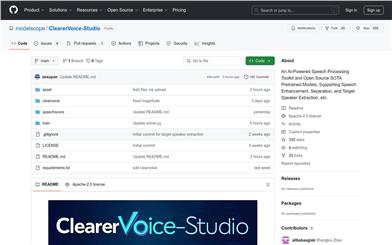

Clearervoice Studio

ClearerVoice-Studioは、研究者、開発者、エンドユーザー向けに設計された、オープンソースのAI駆動型音声処理ツールキットです。音声強調、音声分離、ターゲットスピーカー抽出などの機能を提供し、最新の事前学習済みモデル、トレーニングおよび推論スクリプトを提供しています。これらはすべて、このリポジトリからアクセスできます。このツールキットは、事前学習済みモデル、使いやすさ、包括的な機能、コミュニティ主導型の特性により人気があります。

開発とツール

109.8K

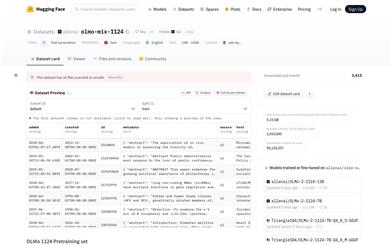

Olmo Mix 1124

allenai/olmo-mix-1124データセットは、Hugging Faceが提供する大規模なマルチモーダル事前学習済みデータセットであり、自然言語処理モデルの訓練と最適化を主な目的としています。本データセットは多言語に対応した膨大なテキスト情報を網羅しており、様々なテキスト生成タスクに使用可能です。その重要性は、研究者や開発者がより正確で効率的な言語モデルを訓練できる豊富なリソースを提供し、自然言語処理技術の発展を促進することにあります。

AIモデル

47.2K

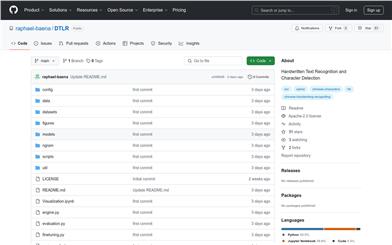

DTLR

DTLRは、DINO-DETRを改良した検出ベースの手書きテキスト行認識モデルであり、テキスト認識と文字検出に使用されます。このモデルは合成データで事前学習され、その後、実データセットで微調整されます。OCR(光学文字認識)分野、特に手書きテキストの処理において、認識精度と効率の向上に大きく貢献します。

AIモデル

57.4K

高品質新製品

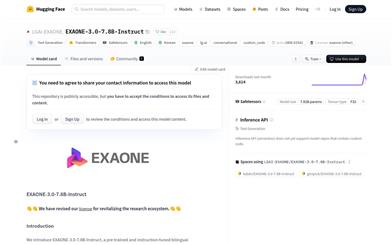

EXAONE 3.0 7.8B Instruct

EXAONE-3.0-7.8B-Instructは、LG AI Researchが開発した7.8億パラメータを持つバイリンガル(英語と韓国語)の事前学習済み生成モデルです。8Tの厳選されたトークンで事前学習され、教師あり微調整と直接的選好最適化によって事後学習が行われています。同規模のオープンモデルと比較して、非常に競争力のあるベンチマーク性能を示しています。

AIモデル

48.6K

高品質新製品

Llama 3

Meta Llama 3は、Metaがリリースした最新の超大規模言語モデルです。個人、クリエイター、研究者、あらゆる企業に対し、大規模言語モデルの可能性を開放することを目指しています。8Bから70Bパラメータまでの様々な規模のバージョンがあり、事前学習済みモデルと指示微調整済みモデルの両方が提供されています。GitHubリポジトリを通じて提供されており、ユーザーはモデルの重みとトークナイザをダウンロードしてローカル環境で推論を実行できます。Meta Llama 3の公開は、大規模言語モデル技術の普及と応用をさらに進めるものであり、広範な研究と商業的な可能性を秘めています。

AIモデル

47.7K

Metaclip

MetaCLIPは、画像とテキストの連合表現学習のためのオープンソース機械学習モデルです。既存モデルによるフィルタリングに依存せず、シンプルなアルゴリズムでCLIPデータをスクリーニングすることで、データの品質と透明性を向上させます。MetaCLIPの主な貢献は、フィルタリング不要のデータスクリーニング、透明な訓練データの分布、拡張性の高いアルゴリズム、そして標準化されたCLIP訓練設定です。本モデルはデータ品質の重要性を強調し、研究者や開発者がコントロール実験や公平な比較を行うための事前学習済みモデルを提供しています。

AIモデル

54.6K

Mixtral 8x22B

Mixtral-8x22Bは、事前学習済みの生成系スパース専門家言語モデルです。Mistral AIチームによって開発され、人工知能のオープンな発展を促進することを目的としています。このモデルは1410億個のパラメータを持ち、半精度、量子化など、様々な最適化された展開方法をサポートすることで、異なるハードウェアやアプリケーションシナリオのニーズに対応します。Mixtral-8x22Bは、テキスト生成、Q&A、翻訳などの自然言語処理タスクに使用できます。

AIモデル

80.6K

Qwen1.5 32B

Qwen1.5は、Transformerアーキテクチャに基づくデコーダ言語モデルシリーズであり、様々な規模のモデルが含まれています。SwiGLU活性化関数、Attention QKVバイアス、グループクエリAttentionなどの特徴を備えています。複数の自然言語とコードをサポートしています。SFT、RLHFなどの後続の学習を行うことを推奨します。価格は無料です。

AIモデル

57.4K

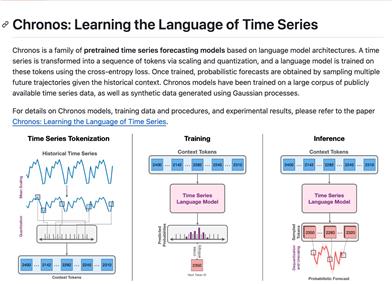

Chronos

Chronosは、言語モデルアーキテクチャに基づく一連の事前学習済み時系列予測モデルです。時系列データは、スケーリングと量子化によってトークン列に変換され、クロスエントロピー損失を用いて言語モデルが学習されます。学習後、過去のコンテキストを与えて複数の将来の軌跡をサンプリングすることで、確率的予測を得ることができます。Chronosモデルは、多数の公開利用可能な時系列データと、ガウス過程を用いて生成された合成データで学習されています。

AIモデル

78.4K

Gemma 7B

Gemma-7Bは、Googleが開発した70億パラメータを持つ大規模な事前学習済み言語モデルです。強力な自然言語処理能力を提供し、テキストの理解と生成、複数言語への対応、幅広い用途への適用が可能です。

AIモデル

173.1K

Gemma 2b

Gemma-2bは、Googleが公開したオープンソースの事前学習済み言語モデルシリーズの一つで、様々な規模のバリエーションを提供しています。高品質なテキスト生成が可能であり、質問応答、要約、推論などの幅広い分野で活用できます。他の同等のモデルと比較して、モデル規模が小さいため、様々なハードウェア環境への展開が容易です。Gemmaシリーズは、安全で効率的なAI技術を目指しており、より多くの研究者や開発者が最先端の言語モデル技術に触れることを可能にします。

AIモデル

165.6K

Google T5

Google T5は、大規模なテキストコーパスを用いて事前学習された、統一的なテキストツーテキスト変換器です。複数のNLPタスクにおいて最先端の結果を実現します。データセットの読み込み、前処理、混合、評価のためのコードを提供しており、公開済みの事前学習済みモデルのファインチューニングにも利用できます。

AIモデル

48.3K

Energeticai

EnergeticAIは、サーバーレス環境向けに最適化されたTensorFlow.jsです。高速なコールドスタート、小さいモジュールサイズ、および事前学習済みモデルを備えています。レコメンデーションなどの機能に使用できる事前学習済み埋め込みを提供しています。npmでインストールでき、商業的に利用可能なライセンスです。EnergeticAIは、コールドスタートのパフォーマンスを最大化しながら、モジュールサイズを最小限に抑えます。

開発とツール

45.0K

中国語精選

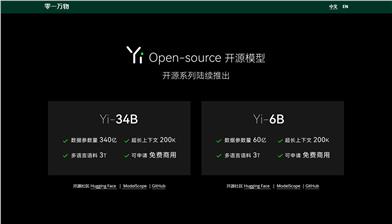

零一万物

Yiは、世界をリードする事前学習済みモデルであり、複数の評価においてSOTA(最先端)の国際最高性能を達成しています。軽量なモデルサイズでありながら、大規模なオープンソースモデルを凌駕し、開発者コミュニティにとってより使いやすくなっています。零一万物は個人および研究用途に適しており、大規模モデルの創発能力を備え、多様なシーンに対応し、オープンソースコミュニティの切実なニーズに応えます。Yiオープンソースモデルは学術研究に完全に公開されており、商用利用申請も無料で同時公開されています。

AIモデル

97.7K

Cargoship

Cargoshipは、事前学習済みのモデルと使いやすいAPIを提供するAIモデルのコレクションです。機械学習の知識がなくても、AIをソフトウェアに統合できます。Cargoshipが提供するモデルには、テキスト処理、テキスト生成、画像認識、画像生成、音声書き起こしなど、複数の分野が含まれており、ユーザーは必要なモデルを選択できます。Cargoshipのモデルコレクションは継続的に拡大し、AI分野の発展にも対応しています。ユーザーは、モデルを自己ホストするか、個人APIキーを取得するかを選択できます。

開発プラットフォーム

50.8K

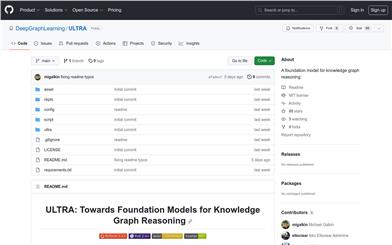

ULTRA

ULTRAは知識グラフ推論の基礎モデルです。単一の事前学習済みULTRAモデルは、いかなる多関係グラフ上でもリンク予測タスクを実行でき、任意のエンティティ/リレーション語彙をサポートします。各グラフに対して個別に訓練された多くのSOTAモデルよりも優れた性能を示します。基礎モデルの事前学習-微調整パラダイムに従い、事前学習済みのULTRAチェックポイントを用いて、いかなるグラフ上でも即座にゼロショット推論を行うことができ、さらに微調整することも可能です。ULTRAは、いかなる知識グラフにも統一的で、学習可能で、転移可能な表現を提供します。ULTRAはグラフニューラルネットワークとNBFNetの修正版を使用しています。下流グラフに特化したエンティティとリレーションの埋め込みを学習するのではなく、リレーション間の相互作用に基づいて相対的なリレーション表現を獲得します。

AIモデル

59.1K

おすすめAI製品

海外精選

Jules AI

Jules は、自動で煩雑なコーディングタスクを処理し、あなたに核心的なコーディングに時間をかけることを可能にする異步コーディングエージェントです。その主な強みは GitHub との統合で、Pull Request(PR) を自動化し、テストを実行し、クラウド仮想マシン上でコードを検証することで、開発効率を大幅に向上させています。Jules はさまざまな開発者に適しており、特に忙しいチームには効果的にプロジェクトとコードの品質を管理する支援を行います。

開発プログラミング

42.0K

Nocode

NoCode はプログラミング経験を必要としないプラットフォームで、ユーザーが自然言語でアイデアを表現し、迅速にアプリケーションを生成することが可能です。これにより、開発の障壁を下げ、より多くの人が自身のアイデアを実現できるようになります。このプラットフォームはリアルタイムプレビュー機能とワンクリックデプロイ機能を提供しており、技術的な知識がないユーザーにも非常に使いやすい設計となっています。

開発プラットフォーム

41.1K

Listenhub

ListenHub は軽量級の AI ポッドキャストジェネレーターであり、中国語と英語に対応しています。最先端の AI 技術を使用し、ユーザーが興味を持つポッドキャストコンテンツを迅速に生成できます。その主な利点には、自然な会話と超高品質な音声効果が含まれており、いつでもどこでも高品質な聴覚体験を楽しむことができます。ListenHub はコンテンツ生成速度を改善するだけでなく、モバイルデバイスにも対応しており、さまざまな場面で使いやすいです。情報取得の高効率なツールとして位置づけられており、幅広いリスナーのニーズに応えています。

AI

40.3K

中国語精選

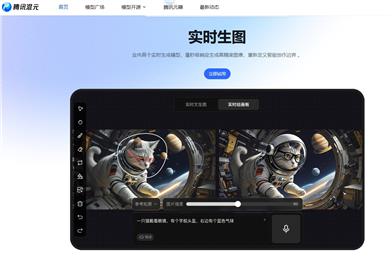

腾讯混元画像 2.0

腾讯混元画像 2.0 は腾讯が最新に発表したAI画像生成モデルで、生成スピードと画質が大幅に向上しました。超高圧縮倍率のエンコード?デコーダーと新しい拡散アーキテクチャを採用しており、画像生成速度はミリ秒級まで到達し、従来の時間のかかる生成を回避することが可能です。また、強化学習アルゴリズムと人間の美的知識の統合により、画像のリアリズムと詳細表現力を向上させ、デザイナー、クリエーターなどの専門ユーザーに適しています。

画像生成

39.7K

Openmemory MCP

OpenMemoryはオープンソースの個人向けメモリレイヤーで、大規模言語モデル(LLM)に私密でポータブルなメモリ管理を提供します。ユーザーはデータに対する完全な制御権を持ち、AIアプリケーションを作成する際も安全性を保つことができます。このプロジェクトはDocker、Python、Node.jsをサポートしており、開発者が個別化されたAI体験を行うのに適しています。また、個人情報を漏らすことなくAIを利用したいユーザーにお勧めします。

オープンソース

40.8K

Fastvlm

FastVLM は、視覚言語モデル向けに設計された効果的な視覚符号化モデルです。イノベーティブな FastViTHD ミックスドビジュアル符号化エンジンを使用することで、高解像度画像の符号化時間と出力されるトークンの数を削減し、モデルのスループットと精度を向上させました。FastVLM の主な位置付けは、開発者が強力な視覚言語処理機能を得られるように支援し、特に迅速なレスポンスが必要なモバイルデバイス上で優れたパフォーマンスを発揮します。

画像処理

39.7K

海外精選

ピカ

ピカは、ユーザーが自身の創造的なアイデアをアップロードすると、AIがそれに基づいた動画を自動生成する動画制作プラットフォームです。主な機能は、多様なアイデアからの動画生成、プロフェッショナルな動画効果、シンプルで使いやすい操作性です。無料トライアル方式を採用しており、クリエイターや動画愛好家をターゲットとしています。

映像制作

17.6M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M