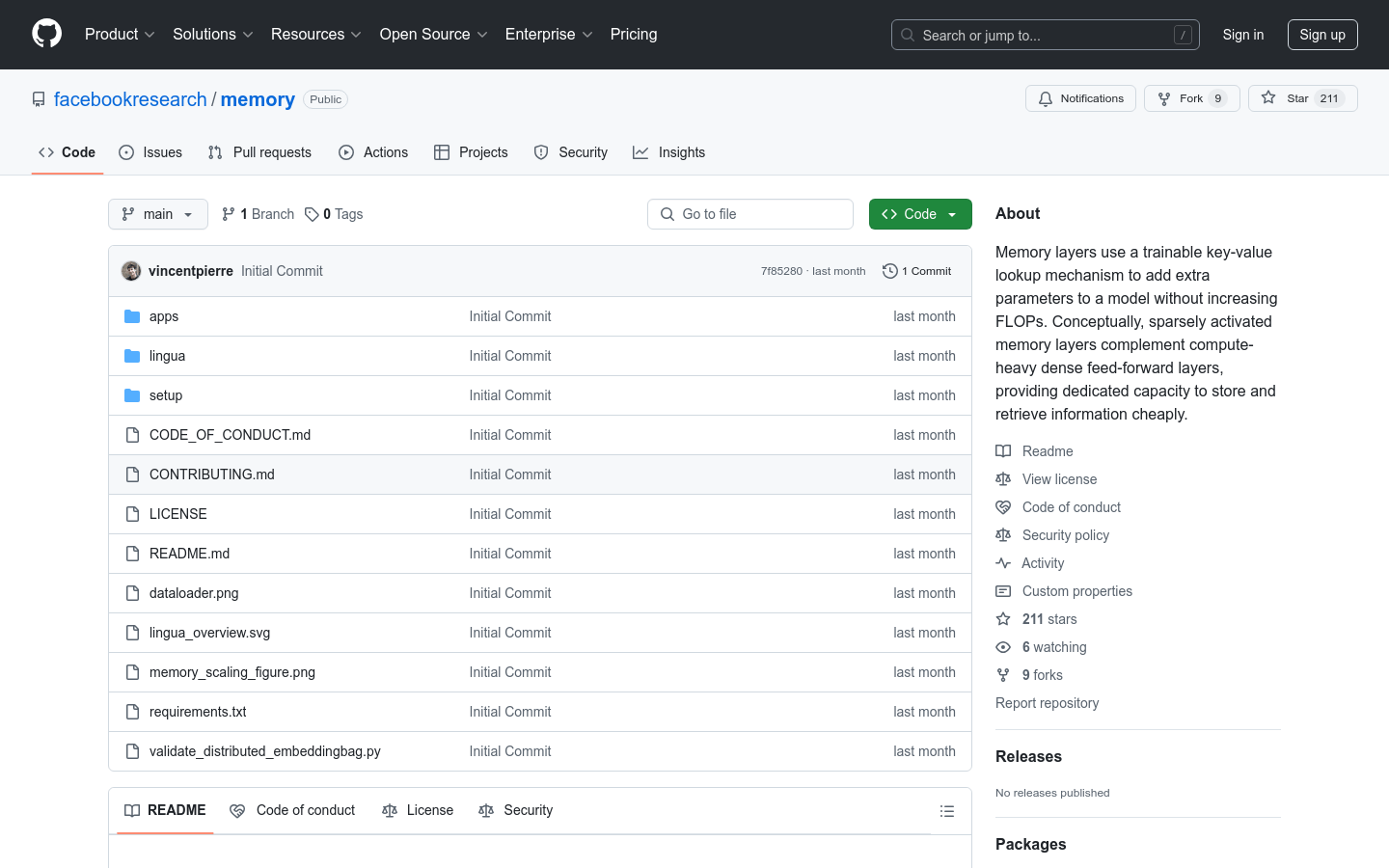

Memory

紹介 :

Memory Layers at Scaleは、学習可能なキーバリュー検索メカニズムを通じて、浮動小数点演算回数を増やすことなくモデルに追加パラメータを追加する革新的なメモリ層の実装方法です。この方法は、計算効率を維持しながらモデルの記憶容量と検索能力を大幅に向上させることができるため、大規模言語モデルにおいて特に重要です。この技術の主な利点としては、モデル容量の効率的な拡張、計算資源消費の削減、モデルの柔軟性と拡張性の向上などが挙げられます。このプロジェクトはMeta Linguaチームによって開発され、大規模データや複雑なモデルの処理が必要なシナリオに適しています。

ターゲットユーザー :

計算量を増やすことなくモデル容量を拡張する必要がある開発者や研究者にとって有用です。特に大規模言語モデルや複雑なデータ処理のシナリオにおいて有効です。

使用シナリオ

計算負荷を増やすことなく、大規模言語モデルにおける語彙とパラメータ容量を拡張する。

自然言語処理タスクにおける情報検索とストレージの最適化に使用する。

分散型トレーニング環境で、大規模モデルを効率的に実行する。

製品特徴

大規模データ処理のサポート

キーバリュー検索メカニズムによるモデルパラメータの拡張

計算効率の維持

分散型トレーニングへの対応

様々なデータセットと設定への対応

詳細な設定と起動スクリプトの提供

ローカルおよびSLURMクラスタでの展開をサポート

柔軟なモデル評価機能

使用チュートリアル

リポジトリのクローン:`git clone https://github.com/facebookresearch/memory`

環境の作成:`bash setup/create_env.sh` またはSLURMクラスタを使用

環境の有効化:`conda activate lingua_<date>`

データのダウンロードと準備:`python setup/download_prepare_hf_data.py fineweb_edu <MEMORY>`

トークナイザのダウンロード:`python setup/download_tokenizer.py llama3 <SAVE_PATH>`

トレーニングタスクの開始:`python -m lingua.stool script=apps.main.train config=apps/main/configs/pkplus_373m_1024k.yaml`

モデルの評価:`srun -n 8 python -u -m apps.main.eval config=apps/main/configs/eval.yaml`

おすすめAI製品

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

AIモデル

11.4M

中国語精選

Liblibai

LiblibAIは、中国をリードするAI創作プラットフォームです。強力なAI創作能力を提供し、クリエイターの創造性を支援します。プラットフォームは膨大な数の無料AI創作モデルを提供しており、ユーザーは検索してモデルを使用し、画像、テキスト、音声などの創作を行うことができます。また、ユーザーによる独自のAIモデルのトレーニングもサポートしています。幅広いクリエイターユーザーを対象としたプラットフォームとして、創作の機会を平等に提供し、クリエイティブ産業に貢献することで、誰もが創作の喜びを享受できるようにすることを目指しています。

AIモデル

6.9M