Dispose

紹介 :

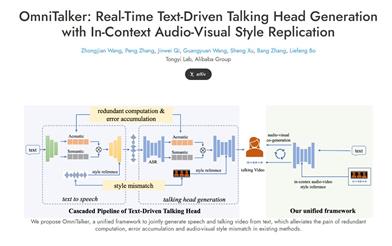

DisPoseは、モーションフィールド誘導とキーポイント対応によってビデオ生成の質を向上させる、人物画像アニメーション制御手法です。この技術は、参照画像と駆動ビデオからビデオを生成し、モーションの整合性とアイデンティティ情報を維持します。DisPoseは、疎なモーションフィールドと参照画像から稠密なモーションフィールドを生成することで、局所的な稠密な誘導を提供しながら、疎なポーズ制御の汎化能力を維持します。さらに、参照画像からポーズキーポイントに対応する拡散特徴を抽出し、これらの点特徴をターゲットポーズに転送することで、独自のアイデンティティ情報を提供します。DisPoseの主な利点としては、追加の稠密な入力なしでより汎用的かつ効果的な制御信号を抽出できること、また、既存のモデルパラメータを凍結することなく、プラグアンドプレイ式の混合ControlNetによって生成ビデオの質と一貫性を向上させることが挙げられます。

ターゲットユーザー :

DisPoseのターゲットユーザーは、コンピュータビジョンと画像アニメーション分野の研究者や開発者、特に高品質で高度な制御性を持つ人物アニメーションビデオを生成する必要がある専門家です。複雑な入力なしでリアルなアニメーションを生成し、生成コンテンツの多様性と個性化を維持できるため、この技術は彼らに適しています。

使用シナリオ

1. DisPose技術を使用して、静止画から人物が歩くビデオを生成します。

2. DisPoseを使用して、ある人物のアクションを別の人物モデルに転送し、アクションのシームレスな変換を実現します。

3. 映画制作において、DisPoseは複雑な人物アクションシーンの生成に使用でき、実際の撮影コストと時間を削減できます。

製品特徴

- モーションフィールド誘導:疎なモーションフィールドと参照画像から稠密なモーションフィールドを生成し、局所的な稠密な誘導を提供します。

- キーポイント対応:ポーズキーポイントに対応する拡散特徴を抽出し、ターゲットポーズに転送します。

- 混合ControlNet:プラグアンドプレイ式のモジュールで、既存のモデルパラメータを変更することなくビデオ生成の質を向上させます。

- ビデオ生成:参照画像と駆動ビデオを使用して新しいビデオを生成し、モーションの整合性とアイデンティティ情報の一貫性を維持します。

- 質と一貫性の向上:DisPose技術により、生成されるビデオの質と一貫性が既存の手法よりも向上します。

- 追加の稠密な入力不要:深度マップなどの追加の稠密な入力への依存を減らし、モデルの汎化能力を向上させます。

- プラグイン式統合:既存の画像アニメーション手法に容易に統合して、性能を向上させることができます。

使用チュートリアル

1. DisPoseの公式ウェブサイトにアクセスし、関連コードをダウンロードします。

2. ドキュメントを読んで、環境と依存関係の構成方法を理解します。

3. 参照画像と駆動ビデオを用意し、DisPoseの入力要件を満たしていることを確認します。

4. DisPoseコードを実行し、参照画像と駆動ビデオを入力します。

5. 生成されたビデオを観察し、モーションの整合性とアイデンティティ情報の一貫性を確認します。

6. 必要に応じて、DisPoseのパラメータを調整してビデオ生成効果を最適化します。

7. 生成されたビデオをさらなる研究または商業用途に使用します。

おすすめAI製品

海外精選

ピカ

ピカは、ユーザーが自身の創造的なアイデアをアップロードすると、AIがそれに基づいた動画を自動生成する動画制作プラットフォームです。主な機能は、多様なアイデアからの動画生成、プロフェッショナルな動画効果、シンプルで使いやすい操作性です。無料トライアル方式を採用しており、クリエイターや動画愛好家をターゲットとしています。

映像制作

17.6M

Deepmind Gemini

Geminiは、Google DeepMindが開発した次世代人工知能システムです。テキスト、画像、ビデオ、音声、コード間のシームレスな相互作用をサポートし、マルチモーダル推論を実行できます。言語理解、推論、数学、プログラミングなど、複数の分野において従来のシステムを凌駕し、現在までに開発された最も強力なAIシステムの一つとなっています。エッジコンピューティングからクラウドコンピューティングまで、様々なニーズに対応できる3つの異なる規模のバージョンがあります。Geminiは、クリエイティブデザイン、ライティングアシスタント、質問応答、コード生成など、幅広い分野で活用できます。

AIモデル

11.4M